Если вы разработчик и хотите добавить в свой проект мощный языковой ассистент, Claude API от Anthropic — один из лучших вариантов.

В этой статье я проведу вас по всем этапам интеграции: от получения ключа до создания продвинутых ассистентов. Вы узнаете, как отправлять запросы, обрабатывать ответы, работать с потоковой передачей и оптимизировать стоимость.

Материал рассчитан на тех, кто уже знаком с HTTP и JSON, но не боится погрузиться в детали. Поехали!

Введение в Claude API

Claude — это семейство языковых моделей, созданных компанией Anthropic с фокусом на безопасность и полезность.

С помощью API вы можете интегрировать возможности Claude в свои приложения: от простых чат-ботов до сложных систем анализа данных и генерации кода. API предоставляет доступ к моделям Claude 3: Opus (максимальная точность для сложных задач), Sonnet (баланс скорости и качества) и Haiku (быстрые ответы для простых запросов).

Важно: Claude API предоставляет доступ к самым современным моделям, включая Claude 3 Opus, Sonnet и Haiku, с разным балансом скорости и качества.

Что такое Claude API?

Claude API — это RESTful интерфейс, который позволяет отправлять текстовые запросы модели и получать сгенерированные ответы.

Основные характеристики:

- Модели Claude 3: Opus, Sonnet, Haiku — выбирайте под задачу: Opus для аналитики, Sonnet для диалогов, Haiku для быстрых ответов.

- Контекстное окно до 200K токенов — можно обрабатывать целые книги или длинные документы.

- Поддержка потоковой передачи и асинхронных запросов — для реального времени и высокой нагрузки.

Для кого предназначен этот гайд?

Этот гайд написан для backend-разработчиков, full-stack инженеров, DevOps и AI/ML специалистов, которые хотят внедрить Claude в свои проекты.

Предполагается, что вы знакомы с HTTP, JSON и основами REST API. Примеры кода будут на Python и JavaScript, но принципы универсальны.

Требуемые знания: HTTP, JSON, базовое понимание REST API

Если вы умеете отправлять POST-запросы и парсить JSON, этого достаточно. Остальному научитесь по ходу.

Примеры на Python и JavaScript

Я покажу код на Python с библиотеками requests и anthropic, а также на Node.js с axios и официальным SDK. Вы сможете адаптировать примеры под свой стек.

Подготовка к интеграции: получение API-ключа и настройка окружения

Прежде чем писать код, нужно зарегистрироваться в Anthropic, получить ключ и настроить среду. Это займёт 10–15 минут, но сэкономит часы отладки.

Частая ошибка: API-ключ — чувствительные данные. Никогда не храните его в коде или публичных репозиториях. Используйте переменные окружения.

Регистрация и получение API-ключа

Зарегистрируйтесь на console.anthropic.com. После входа перейдите в раздел API Keys и создайте новый ключ.

Сразу настройте биллинг: Anthropic работает по предоплате, нужно пополнить баланс. Рекомендую установить лимиты расходов и уведомления, чтобы избежать неожиданных списаний.

Переход в консоль Anthropic

Откройте console.anthropic.com, войдите через GitHub или email.

Создание нового API-ключа

Нажмите «Create Key», дайте ему имя (например, «dev-project») и скопируйте ключ. Он показывается только один раз.

Настройка лимитов и уведомлений

В разделе Billing установите бюджет и email для оповещений. Это спасёт от перерасхода.

Настройка окружения разработчика

Установите необходимые библиотеки. Для Python: pip install requests anthropic. Для Node.js: npm install axios @anthropic-ai/sdk. Создайте файл .env в корне проекта и добавьте туда ключ:

ANTHROPIC_API_KEY=ваш_ключ_здесьЗагружайте переменные окружения в коде с помощью python-dotenv или dotenv для Node.js.

Установка зависимостей через pip / npm

Выполните команды в терминале. Для Python: pip install python-dotenv requests anthropic. Для Node.js: npm install dotenv axios @anthropic-ai/sdk.

Создание .env файла

Файл .env должен быть в .gitignore, чтобы случайно не закоммитить ключ.

Загрузка переменных окружения

В Python: from dotenv import load_dotenv; load_dotenv(); import os; api_key = os.getenv('ANTHROPIC_API_KEY'). В Node.js: require('dotenv').config(); const apiKey = process.env.ANTHROPIC_API_KEY;.

Базовые примеры аутентификации

Аутентификация происходит через заголовок x-api-key. Также требуется заголовок anthropic-version (например, 2023-06-01).

Пример с curl

curl https://api.anthropic.com/v1/messages

-H "x-api-key: $ANTHROPIC_API_KEY"

-H "anthropic-version: 2023-06-01"

-H "content-type: application/json"

-d '{

"model": "claude-3-sonnet-20240229",

"max_tokens": 100,

"messages": [{"role": "user", "content": "Привет, Claude!"}]

}'Пример на Python с requests

import requests

import os

api_key = os.getenv('ANTHROPIC_API_KEY')

headers = {

'x-api-key': api_key,

'anthropic-version': '2023-06-01',

'content-type': 'application/json'

}

data = {

'model': 'claude-3-sonnet-20240229',

'max_tokens': 100,

'messages': [{'role': 'user', 'content': 'Привет, Claude!'}]

}

response = requests.post('https://api.anthropic.com/v1/messages', headers=headers, json=data)

print(response.json())Пример на Node.js с axios

const axios = require('axios');

require('dotenv').config();

const apiKey = process.env.ANTHROPIC_API_KEY;

const response = await axios.post('https://api.anthropic.com/v1/messages', {

model: 'claude-3-sonnet-20240229',

max_tokens: 100,

messages: [{ role: 'user', content: 'Привет, Claude!' }]

}, {

headers: {

'x-api-key': apiKey,

'anthropic-version': '2023-06-01',

'content-type': 'application/json'

}

});

console.log(response.data);Основы работы с Claude API: отправка запросов и обработка ответов

Теперь, когда окружение настроено, разберём структуру запроса и ответа. Это база, на которой строятся все интеграции.

Важно: Параметр ‘max_tokens’ обязателен. Если не указать, запрос может упасть с ошибкой.

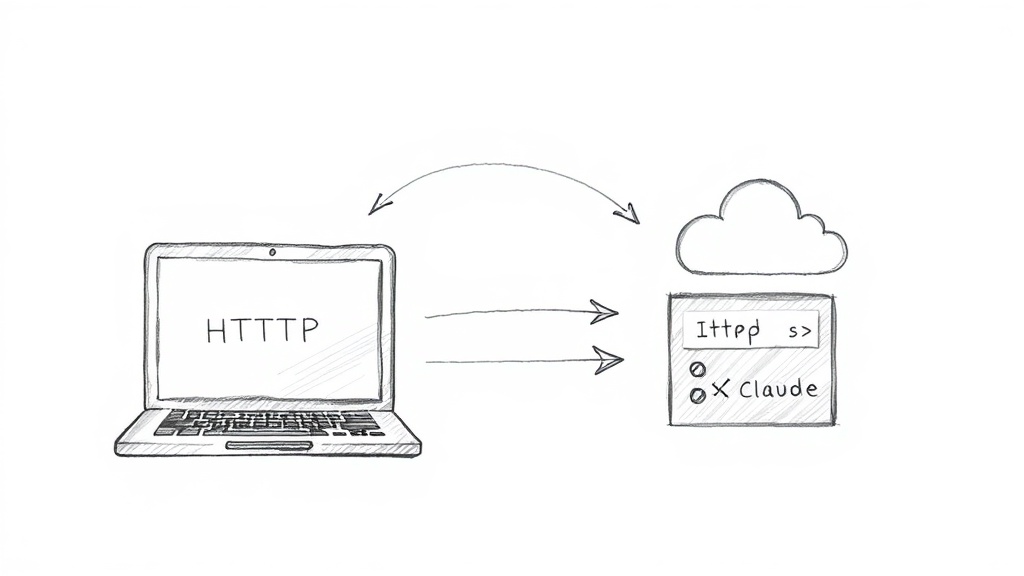

Структура HTTP-запроса

Endpoint: POST https://api.anthropic.com/v1/messages. Заголовки: x-api-key, anthropic-version, content-type: application/json. Тело запроса содержит модель, массив сообщений и параметры генерации.

Endpoint: https://api.anthropic.com/v1/messages

Это основной эндпоинт для отправки сообщений. Другие эндпоинты (например, для streaming) описаны в документации.

Метод: POST

Все запросы к messages — POST. GET-запросы используются только для получения информации о моделях.

Заголовки: x-api-key, anthropic-version, content-type

Без корректных заголовков API вернёт 401 или 400.

Формат сообщений и ролей

Массив messages содержит объекты с ролями user и assistant. Системный промпт задаётся отдельным параметром system (строка).

Пример простого запроса: одно сообщение

{

"model": "claude-3-sonnet-20240229",

"max_tokens": 150,

"messages": [{"role": "user", "content": "Напиши короткое стихотворение о программировании."}]

}Многосообщений: диалог

Чтобы поддержать контекст, передавайте всю историю диалога. Например:

{

"model": "claude-3-sonnet-20240229",

"max_tokens": 200,

"messages": [

{"role": "user", "content": "Какая столица Франции?"},

{"role": "assistant", "content": "Париж."},

{"role": "user", "content": "А какой там самый известный музей?"}

]

}Системный промпт для задания контекста

Системный промпт задаёт поведение модели. Например: "system": "Ты — опытный Python-разработчик. Отвечай кратко и с примерами кода."

Параметры генерации

Параметры управляют креативностью и структурой ответа.

Temperature: контроль случайности

Значение от 0 до 1. Чем выше, тем более случайные ответы. Для фактологических задач ставьте 0–0.3, для творческих — 0.7–1.

Top_p: nucleus sampling

Альтернатива temperature. Ограничивает выбор токенов с суммарной вероятностью top_p. Обычно используют один из двух параметров.

Stop_sequences: завершение генерации

Массив строк, при появлении которых модель остановит генерацию. Полезно для структурированных ответов.

Обработка ответа

Ответ приходит в формате JSON. Основные поля: id, type, role, content (массив блоков), stop_reason, usage (статистика токенов).

Извлечение текста из ответа

Текст находится в response['content'][0]['text']. Пример на Python: text = response.json()['content'][0]['text'].

Обработка ошибок: статус-коды и сообщения

API возвращает стандартные HTTP-коды. 400 — неверный запрос, 401 — неверный ключ, 429 — превышение лимита, 500 — внутренняя ошибка. Всегда проверяйте статус.

Логирование и отладка

Логируйте request_id (поле id в ответе) — он поможет в поддержке. Также логируйте количество токенов из usage для контроля расходов.

Продвинутые сценарии использования API

Когда основы освоены, переходим к продвинутым техникам: потоковая передача, асинхронность, работа с большими контекстами и оптимизация.

Совет: Потоковая передача (streaming) позволяет получать ответ по частям, улучшая UX в чат-ботах.

Потоковая передача (Streaming)

Streaming возвращает ответ по частям через Server-Sent Events (SSE). Включите параметр stream: true в теле запроса.

Установка параметра stream: true

Добавьте "stream": true в JSON запроса. Ответ будет состоять из нескольких событий.

Обработка событий: message_start, content_block_delta, message_stop

События: message_start — начало, content_block_delta — часть текста, message_stop — завершение. В delta.text содержится фрагмент.

Пример на Python с SSE

import requests

import json

api_key = os.getenv('ANTHROPIC_API_KEY')

headers = {'x-api-key': api_key, 'anthropic-version': '2023-06-01', 'content-type': 'application/json'}

data = {

'model': 'claude-3-sonnet-20240229',

'max_tokens': 200,

'stream': True,

'messages': [{'role': 'user', 'content': 'Расскажи историю про робота.'}]

}

with requests.post('https://api.anthropic.com/v1/messages', headers=headers, json=data, stream=True) as r:

for line in r.iter_lines():

if line:

line = line.decode('utf-8')

if line.startswith('data: '):

event = json.loads(line[6:])

if event['type'] == 'content_block_delta':

print(event['delta']['text'], end='')Асинхронные запросы и обработка очередей

Для высоконагруженных систем используйте асинхронные вызовы. В Python — asyncio с aiohttp, в Node.js — async/await.

Создание пула запросов

Ограничьте число одновременных запросов (например, 5), чтобы не превысить rate limit. Используйте asyncio.Semaphore.

Обработка результатов

Собирайте результаты по мере завершения. Логируйте ошибки и время выполнения.

Управление rate limit

Если получаете 429, увеличьте задержку между запросами. Храните очередь задач и обрабатывайте их с паузами.

Работа с большими контекстами (200K токенов)

Claude 3 поддерживает до 200K токенов — это около 150 000 слов. Но передавать всё сразу неэффективно.

Сжатие промптов

Удаляйте лишние пробелы, используйте короткие формулировки. Для длинных документов разбивайте на части и отправляйте по одной.

Использование системного промпта для контекста

Поместите основные инструкции в system, а не в сообщения. Это экономит токены.

Пример: анализ длинного документа

Загрузите документ, выберите ключевые разделы, отправьте их с запросом на суммаризацию.

Оптимизация стоимости и производительности

Стоимость зависит от модели и количества токенов. Haiku — самая дешёвая, Opus — самая дорогая. Выбирайте модель под задачу.

Сравнение стоимости моделей

| Модель | Входные токены (за 1K) | Выходные токены (за 1K) | Скорость |

|---|---|---|---|

| Haiku | $0.00025 | $0.00125 | Быстрая |

| Sonnet | $0.003 | $0.015 | Средняя |

| Opus | $0.015 | $0.075 | Медленная |

Кэширование ответов для повторяющихся запросов

Если пользователи задают одни и те же вопросы, кэшируйте ответы в Redis или файлах. Это снизит расходы и ускорит ответ.

Батчинг запросов

Объединяйте несколько запросов в один, если это возможно. Например, вместо 10 отдельных запросов на перевод отправьте один с 10 предложениями.

Примеры интеграций: от простого чат-бота до сложного ассистента

Перейдём к практике. Ниже — готовые примеры, которые можно скопировать и запустить после замены API-ключа.

Совет: Примеры кода готовы к копированию и запуску после замены API-ключа.

Создание простого чат-бота

Бот запоминает историю диалога и отвечает в реальном времени.

Структура диалога: массив сообщений

Храните историю в списке и передавайте её в каждый запрос. Не забывайте про лимит токенов — при длинных диалогах обрезайте старые сообщения.

Обработка ввода пользователя

Получайте текст от пользователя, добавляйте в массив, отправляйте запрос, выводите ответ.

Вывод ответа

Используйте streaming для плавного вывода. Пример на Python с потоком уже был выше.

Генерация и рефакторинг кода

Claude отлично справляется с написанием и улучшением кода.

Промпт для генерации функции

"Напиши функцию на Python, которая сортирует список чисел по убыванию."

Промпт для рефакторинга

"Улучши этот код: [вставьте код]. Сделай его более читаемым и добавь комментарии."

Обработка кода в ответе

Извлекайте код из ответа, оборачивайте в markdown-блоки для отображения.

Суммаризация документов

Отличный сценарий для обработки больших объёмов текста.

Промпт для суммаризации

"Суммируй следующий текст в 3–5 предложений:"

Работа с большими текстами (разбиение на части)

Если текст длиннее 200K токенов, разбейте на части и суммаризируйте каждую, затем объедините результаты.

Извлечение ключевых пунктов

Попросите модель выделить основные пункты в виде списка.

Перевод текста с сохранением контекста

Системный промпт помогает задать стиль перевода.

Промпт для перевода

"Переведи следующий текст с английского на русский, сохрани деловой стиль:"

Обработка многоязычного ввода

Модель сама определяет язык, но лучше указать в промпте.

Сохранение терминологии

Дайте глоссарий в системном промпте: "Используй следующие термины: API — интерфейс программирования приложений."

Обработка ошибок, лимиты и лучшие практики

Интеграция с любым API не обходится без ошибок. Научитесь их обрабатывать и проектировать отказоустойчивую систему.

Важно: Ошибка 429 (Too Many Requests) — сигнал к внедрению экспоненциальной задержки (exponential backoff).

Типичные HTTP-ошибки и их обработка

- 400 Bad Request: неверные параметры. Проверьте JSON и обязательные поля.

- 401 Unauthorized: неверный ключ. Проверьте переменную окружения.

- 429 Rate Limit: превышение лимита. Внедрите повторные попытки с задержкой.

Рекомендации по ретраям

Используйте exponential backoff: после первой ошибки подождите 1 секунду, после второй — 2, после третьей — 4 и так далее. Максимум 5 попыток.

Управление лимитами (Rate Limiting)

У Anthropic есть лимиты на количество запросов в минуту (RPM) и токенов в минуту (TPM). Следите за ними в консоли.

Мониторинг использования в консоли

Вкладка Usage показывает текущее потребление. Настройте алерты.

Реализация очереди запросов

Используйте очередь (например, Redis или RabbitMQ) для буферизации запросов и равномерной нагрузки.

Выбор модели с меньшим потреблением

Если лимиты часто превышаются, переключитесь на Haiku для простых задач.

Безопасность и конфиденциальность

Не передавайте в промптах личные данные пользователей (PII). Используйте шифрование при передаче (HTTPS).

Избегать PII в запросах

Анонимизируйте данные перед отправкой. Не логируйте содержимое промптов.

Использовать переменные окружения

Ключи и секреты храните в .env или в секретном хранилище (Vault, AWS Secrets Manager).

Логирование без чувствительных данных

Логируйте только идентификаторы запросов и количество токенов, не текст.

Тестирование интеграции

Покрывайте код тестами, чтобы избежать регрессий.

Мокирование HTTP-запросов

Используйте библиотеки вроде pytest-mock или nock для Node.js, чтобы не отправлять реальные запросы в тестах.

Тестирование обработки ошибок

Проверьте, как система реагирует на 429, 500 и другие ошибки.

Нагрузочное тестирование

Запустите тесты с большим количеством параллельных запросов, чтобы убедиться, что ваша очередь и ретраи работают.

Заключение и дальнейшие шаги

Мы прошли полный путь от получения API-ключа до создания сложных ассистентов. Claude API открывает широкие возможности для автоматизации, генерации контента и анализа данных.

Не останавливайтесь на достигнутом — изучайте документацию, экспериментируйте с промптами и интегрируйте Claude в свои проекты.

Совет: Регулярно проверяйте документацию Anthropic — API активно развивается, появляются новые возможности.

«Лучший способ научиться — делать. Начните с простого чат-бота, а затем усложняйте.»

Полезные ресурсы

- Официальная документация Anthropic — docs.anthropic.com

- GitHub репозиторий с примерами — github.com/anthropics

- Сообщество разработчиков — Discord Anthropic

Также рекомендую прочитать нашу статью об автоматизации тестирования с помощью плагинов и CI/CD-интеграций — это поможет вам выстроить надёжный пайплайн для вашего AI-проекта.

Что дальше?

- Изучение продвинутых промптов — техники few-shot, chain-of-thought.

- Интеграция с LangChain — создание цепочек вызовов.

- Мониторинг и аналитика использования — сбор метрик, оптимизация.

Часто задаваемые вопросы

Как получить API-ключ Claude?

Зарегистрируйтесь на console.anthropic.com, перейдите в раздел API Keys и создайте новый ключ. Не забудьте настроить биллинг.

Какие модели доступны через API?

Claude 3 Opus, Sonnet и Haiku. Каждая модель имеет свои характеристики по скорости, качеству и стоимости.

Как обрабатывать ошибку 429?

Внедрите exponential backoff: после получения 429 подождите 1 секунду, затем 2, 4 и т.д. Максимум 5 повторных попыток.

Можно ли использовать Claude API бесплатно?

У Anthropic есть бесплатный лимит для тестирования (обычно $5 на аккаунт), но для продакшена требуется платный тариф.

Как уменьшить стоимость запросов?

Используйте модель Haiku для простых задач, кэшируйте ответы, сокращайте промпты и объединяйте запросы.

Поддерживает ли Claude API потоковую передачу?

Да, установите параметр stream: true и обрабатывайте SSE-события.

Какой максимальный размер контекста?

До 200 000 токенов для Claude 3. Этого достаточно для обработки целых книг.

Безопасно ли передавать конфиденциальные данные в API?

Anthropic не использует данные для обучения, но рекомендуется избегать передачи PII. Всегда шифруйте данные при передаче.