Искусственный интеллект перестал быть фантастикой — сегодня он помогает писать код, отвечать на письма и даже поддерживать беседу. Но путь от простых скриптов до мультимодальных ассистентов вроде Claude был долгим и тернистым.

В этой статье мы проследим, как менялись технологии, почему одни подходы устарели, а другие стали стандартом, и как выбрать ассистента под свою задачу.

Введение: от простых скриптов к интеллектуальным собеседникам

Первый чат-бот появился в 1966 году. ELIZA имитировала психотерапевта, перефразируя вопросы пользователя. Это была игра с шаблонами, а не понимание. С тех пор прошло почти 60 лет, и сегодня мы имеем системы, способные анализировать контекст, писать эссе и даже шутить.

Эволюция шла через три ключевых этапа: эпоха правил, эпоха статистики и эпоха глубокого обучения. Каждый этап приносил свои прорывы и разочарования. Понимание этой истории помогает трезво оценивать возможности современных ассистентов и избегать иллюзий.

Важно: Несмотря на впечатляющий прогресс, понимание истории помогает избежать повторения ошибок и трезво оценивать текущие возможности ИИ.

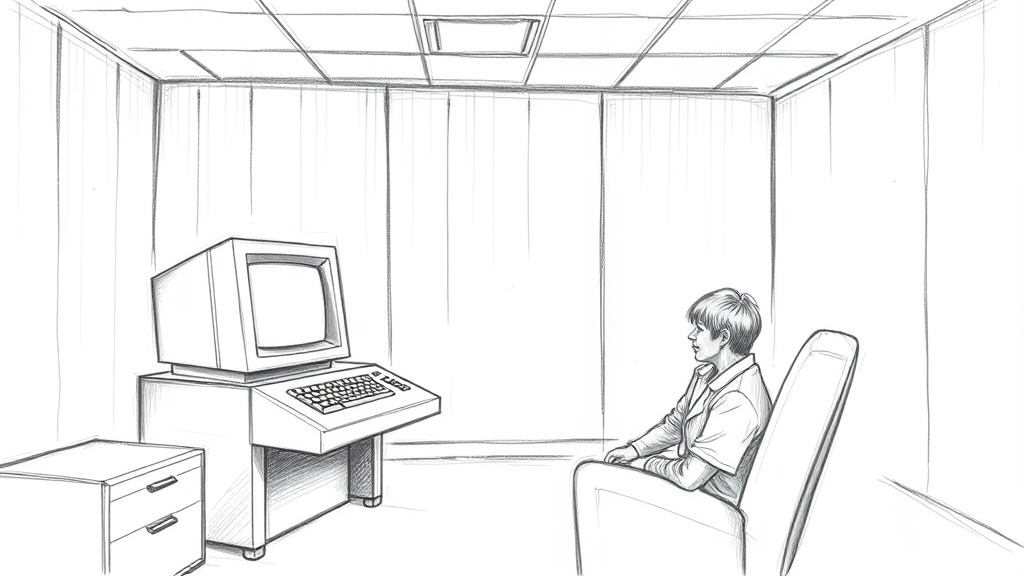

Эпоха 1: Правила и скрипты (1960-е – 2000-е)

Первые диалоговые системы работали по принципу «если-то». ELIZA, PARRY, ALICE и Jabberwacky — все они использовали шаблоны и регулярные выражения. Пользователь вводил фразу, система искала совпадение в базе правил и выдавала заранее заготовленный ответ.

Например, если пользователь писал «Я грущу», бот мог ответить «Почему вы грустите?» — и это казалось чудом. Но стоило отойти от шаблона, и диалог рушился. Контекст не сохранялся, память отсутствовала.

Частая ошибка: Эти системы не «понимали» смысл, а лишь имитировали диалог. Однако они заложили основу для более сложных подходов.

Ключевые технологии того времени

Для создания таких ботов использовались специализированные языки разметки и скриптовые платформы. Вот три главных инструмента той эпохи:

- AIML и его роль — Artificial Intelligence Markup Language. Позволял описывать шаблоны вопросов и ответов. Популярен в ALICE. Ограничен: каждую фразу нужно прописывать вручную.

- RiveScript для игр — язык для интерактивных текстовых квестов. Поддерживал переменные и простую логику. Использовался в развлекательных ботах.

- ChatScript как коммерческая платформа — более мощный движок, способный обрабатывать сложные диалоги. Применялся в корпоративной поддержке.

Примеры и ограничения

Представьте диалог с ботом на AIML:

- Пользователь: «Какой сегодня день?»

- Бот: «Сегодня прекрасный день, чтобы поговорить!»

- Пользователь: «Нет, я серьезно, какое число?»

- Бот: «Я не знаю. Может, расскажешь о себе?»

Бот не мог определить намерение, не имел доступа к календарю и не запоминал историю. Такие системы годились только для простых скриптовых сценариев: техподдержка с меню из трёх пунктов, развлекательные чаты, сбор анкетных данных.

| Технология | Год | Принцип | Ограничения |

|---|---|---|---|

| ELIZA | 1966 | Шаблоны + подстановка | Нет контекста |

| ALICE | 1995 | AIML | Ручные правила |

| Jabberwacky | 1997 | Поиск по базе диалогов | Нет обобщения |

Эпоха 2: Статистические методы и машинное обучение (2000-е – 2015)

В начале 2000-х стало ясно: правила не работают для сложных диалогов. На смену пришли вероятностные модели. Вместо жёстких шаблонов — N-граммы, скрытые марковские модели (HMM), условные случайные поля (CRF). Системы научились распознавать намерения (intent detection) и извлекать сущности (entity extraction).

Это время расцвета голосовых ассистентов: Siri (2011), Google Now (2012), Amazon Alexa (2014). Они могли заказать пиццу, найти ресторан или напомнить о встрече. Но глубина понимания оставалась ограниченной.

Совет: Именно в этот период компании начали массово инвестировать в ИИ-ассистентов, но качество оставалось низким для сложных запросов. Если вам нужен ассистент для глубокой аналитики, лучше смотреть на современные модели.

«Siri, найди итальянский ресторан рядом» — «Вот три ресторана. Какой вас интересует?» — «Первый» — «Забронировать столик на двоих?» — «Да» — «Готово». Это работало, но стоило спросить «А какой из них дешевле?», и ассистент терялся.

Взлет голосовых ассистентов

Голосовые ассистенты стали первым массовым продуктом на базе ИИ. Сравним трёх лидеров:

- Siri и ее закрытая экосистема — интеграция с Apple-сервисами, хорошая конфиденциальность, но слабая гибкость. Не поддерживала сторонние навыки до 2016 года.

- Alexa: навыки и умный дом — открытая платформа для разработчиков, тысячи навыков. Сильная сторона — управление устройствами. Слабая — контекстный диалог.

- Google Assistant: сила поиска — использовала поисковый индекс Google, поэтому могла отвечать на фактологические вопросы. Но длинные беседы вели к путанице.

Ограничения статистических моделей

Статистические методы требовали огромных размеченных датасетов. Если в обучающей выборке не было примера «забронировать столик на веранде», модель не справлялась. Редкие запросы (long-tail) обрабатывались плохо. Кроме того, такие системы не умели обобщать: выучив одно намерение, они не могли применить знание к похожей задаче.

| Ассистент | Год | Архитектура | Главная слабость |

|---|---|---|---|

| Siri | 2011 | HMM + CRF | Закрытость, плохая кастомизация |

| Google Now | 2012 | N-граммы + поиск | Нет диалога, только карточки |

| Alexa | 2014 | CRF + навыки | Короткий контекст (одна фраза) |

Эпоха 3: Революция трансформеров (2017 – 2022)

В 2017 году вышла статья «Attention is All You Need». Она предложила механизм внимания (attention), который позволил моделям учитывать все слова в последовательности одновременно. Это изменило всё. BERT, GPT-2, GPT-3 — каждое новое поколение трансформеров делало шаг вперёд.

BERT (2018) научился понимать контекст слева и справа — это улучшило поиск и ответы на вопросы. GPT-3 (2020) показал, что масштабирование даёт эмерджентные способности: модель может писать стихи, переводить, программировать без дообучения. А ChatGPT (2022) объединил генерацию с диалоговым форматом и RLHF (обучение с подкреплением на основе обратной связи).

Важно: Трансформеры не просто улучшили качество, они изменили парадигму: теперь модель может выполнять множество задач без дообучения (few-shot, zero-shot learning).

«Напиши письмо клиенту с извинениями за задержку» — ChatGPT генерирует вежливый текст за секунду. «А теперь перепиши в деловом стиле» — мгновенно адаптирует. Это стало возможным благодаря глубокому обучению на триллионах токенов.

BERT и его влияние

BERT (Bidirectional Encoder Representations from Transformers) от Google стал прорывом в понимании естественного языка. Он читал текст целиком, а не слева направо. Это позволило точнее определять смысл слов в контексте. BERT внедрили в поиск Google — качество ответов на сложные запросы выросло на 10%.

Однако BERT не умел генерировать текст — он был только энкодером. Для генерации требовались другие архитектуры.

GPT-3 и ChatGPT: генеративный прорыв

GPT-3 (Generative Pre-trained Transformer 3) от OpenAI содержал 175 миллиардов параметров. Он мог дописывать код, сочинять рассказы, отвечать на вопросы. Но в сыром виде он был неуправляем: мог оскорбить или выдать ложь. Решение пришло с RLHF — обучением с подкреплением на основе человеческой обратной связи.

ChatGPT стал первым массовым продуктом, где RLHF дал контроль над поведением. Модель научилась отказываться от вредных запросов, признавать ошибки и поддерживать диалог. API ChatGPT открыл доступ к генерации для тысяч стартапов.

- RLHF: обучение с подкреплением на основе обратной связи — люди оценивали ответы, модель училась давать более полезные и безопасные варианты.

- Диалоговый формат и контекстное окно — ChatGPT помнил историю беседы (до 4096 токенов), что позволяло вести длинные обсуждения.

- API и интеграции — разработчики получили возможность встраивать ChatGPT в свои приложения, от чатов поддержки до редакторов кода.

Другие значимые модели

OpenAI не была единственной. Google выпустила PaLM (540 млрд параметров), LaMDA (специализирована на диалоге), а Meta — открытую LLaMA, которую дообучали сообщества.

- PaLM: масштабирование до 540 млрд параметров — показал способность к логическим рассуждениям (chain-of-thought).

- LaMDA: фокус на диалоге — обучалась на беседах, умела поддерживать тему, но была менее универсальна.

- LLaMA: открытая альтернатива — доступна для скачивания, что породило волну кастомных моделей.

Эпоха 4: Безопасность, контроль и мультимодальность (2023 – настоящее время)

К 2023 году стало ясно: мощные модели опасны без контроля. Галлюцинации (выдуманные факты), предвзятость, уязвимость к взлому — всё это требовало решений. Anthropic предложила конституционный ИИ (Constitutional AI), а OpenAI и Google сделали ставку на мультимодальность.

Claude, Gemini, GPT-4V — эти ассистенты не только говорят, но и видят, слышат, анализируют изображения. Они могут описать фотографию, прочитать график, перевести видео в текст. Появились агенты — системы, которые планируют задачи и используют внешние инструменты.

Совет: Ключевой вызов современности: как сделать мощные модели безопасными и полезными, не ограничивая их потенциал. При выборе ассистента для бизнеса обязательно проверяйте его политику безопасности.

Claude и конституционный ИИ

Claude от Anthropic — результат многолетних исследований в области безопасности. В основе лежит конституционный ИИ: модель обучается на принципах (конституции), а не только на человеческих оценках. Это снижает предвзятость и делает отказы более предсказуемыми.

- Конституционный ИИ vs RLHF — RLHF требует тысячи оценок людей, что дорого и субъективно. Конституционный ИИ использует набор правил (например, «не дискриминируй», «будь полезен»), и модель сама оценивает свои ответы на соответствие этим правилам.

- Работа с длинным контекстом — Claude поддерживает контекст до 100 тысяч токенов (около 75 тысяч слов). Это позволяет анализировать целые книги или код проекта.

- Безопасность по умолчанию — Claude отказывается от вредных запросов, не генерирует оскорбительный контент и честно говорит, если не знает ответа.

Мультимодальные ассистенты

GPT-4V (Vision) и Gemini от Google умеют обрабатывать изображения, аудио и видео. Это расширяет сценарии использования:

- GPT-4V: зрение и текст — загрузите фотографию холодильника, и ассистент предложит рецепт из имеющихся продуктов. Проанализирует график продаж и напишет выводы.

- Gemini: нативная мультимодальность — обучался на тексте, картинках, аудио и видео одновременно. Может понять жест на видео или интонацию голоса.

Агенты и автономность

Современные ассистенты становятся агентами — они не просто отвечают, а выполняют действия. AutoGPT, AgentGPT, плагины ChatGPT — это попытка делегировать многошаговые задачи: «Найди отель в Париже с бассейном, сравни цены на Booking и Expedia, забронируй лучший вариант».

- Планирование и декомпозиция задач — агент разбивает задачу на подзадачи: поиск → сравнение → бронирование.

- Использование внешних инструментов — агент вызывает API Booking, Expedia, калькулятор, поиск.

- Проблемы: надежность, безопасность — агент может ошибиться, выбрать неверный отель или потратить деньги без подтверждения. Пока такие системы требуют контроля.

Сравнительная таблица поколений ИИ-ассистентов

Чтобы быстро оценить, какой ассистент подходит для вашей задачи, вот сводка по поколениям:

| Поколение | Период | Технологии | Примеры | Сильные стороны | Слабые стороны | Сценарии |

|---|---|---|---|---|---|---|

| Правила | 1960-2000 | AIML, шаблоны | ELIZA, ALICE | Простота, предсказуемость | Нет контекста, хрупкость | Техподдержка, игры |

| Статистика | 2000-2015 | HMM, CRF, N-граммы | Siri, Alexa | Распознавание намерений | Зависимость от данных, короткий контекст | Голосовые команды, заказ |

| Трансформеры | 2017-2022 | Attention, RLHF | GPT-3, ChatGPT, BERT | Универсальность, few-shot | Галлюцинации, стоимость | Генерация, перевод, код |

| Безопасность+ | 2023+ | Конституционный ИИ, мультимодальность | Claude, Gemini, GPT-4V | Безопасность, длинный контекст, зрение | Высокая стоимость, задержка | Анализ, агенты, творчество |

Практические рекомендации по выбору ассистента

Не существует универсального ассистента. Лучший выбор зависит от ваших приоритетов: безопасность, стоимость, возможности. Вот сценарии для разных аудиторий.

Частая ошибка: Выбирать ассистента только по популярности. Например, ChatGPT отлично генерирует код, но для анализа конфиденциальных данных лучше Claude с его конституционными гарантиями.

Для разработчиков

- Claude для анализа кода и документации — длинный контекст позволяет загрузить весь проект и задать вопросы по архитектуре.

- ChatGPT для генерации кода — быстрее пишет функции, но может содержать ошибки. Требует проверки.

- GitHub Copilot для интеграции в IDE — работает прямо в редакторе, подсказывает автодополнения. Лучше всего подходит для повседневной разработки.

Подробнее о том, как ИИ-ассистенты меняют подход к работе с кодом, читайте в статье про Copilot.

Для бизнеса

- Поддержка клиентов — Zendesk AI, Intercom Fin на базе GPT. Автоматизируют ответы на частые вопросы, экономят время операторов.

- Анализ отзывов — Claude может проанализировать тысячи отзывов и выделить ключевые проблемы.

- Генерация отчетов — GPT-4V анализирует графики и пишет резюме.

Для творчества

Для написания текстов, сценариев, маркетинговых материалов выбирайте между Claude (безопасность, стиль) и ChatGPT (креативность). Gemini хорош для работы с изображениями. Если вы работаете с базами данных, вам может пригодиться Cursor для работы с базами данных.

Будущее ИИ-ассистентов: тренды и прогнозы

Главный тренд: ассистенты станут проактивными советниками, а не просто реактивными инструментами. Вместо «Напиши письмо» вы скажете «Управляй моей почтой», и ассистент сам будет сортировать, отвечать, напоминать.

Совет: Главный тренд: ассистенты станут проактивными советниками, а не просто реактивными инструментами. Уже сейчас можно попробовать агентов, но с осторожностью.

Технологические направления

- Долговременная память — ассистент будет помнить ваши предпочтения, историю общения, контекст недельной давности. Уже сейчас есть прототипы с векторными базами данных.

- Эмоциональный ИИ — распознавание тона голоса, мимики, настроения. Ассистент сможет подстроить стиль общения: шутить, если вы веселы, или быть деликатным, если вы расстроены.

- Специализированные модели — вместо универсальных ассистентов появятся узкопрофильные: для юристов, врачей, финансистов. Они будут обучены на отраслевых данных и давать более точные ответы.

Этические и социальные вызовы

С ростом возможностей растут и риски. Приватность: ассистент знает о вас всё — от списка покупок до медицинских диагнозов. Предвзятость: модели могут усиливать стереотипы, если их не контролировать.

Влияние на рынок труда: автоматизация коснётся не только физической работы, но и интеллектуальной. Регулирование: правительства пытаются создать законы, но технологии развиваются быстрее.

Заключение: от имитации к сотрудничеству

Эволюция ИИ-ассистентов — это путь от примитивных скриптов, которые не понимали ни слова, до интеллектуальных партнёров, способных анализировать, творить и планировать. Claude, ChatGPT, Gemini — это не просто чат-боты, а инструменты, которые меняют способ работы миллионов людей.

Но важно помнить: ИИ-ассистенты — это инструменты, а не замена человеческому интеллекту. Лучшие результаты достигаются в коллаборации. Экспериментируйте, пробуйте разные модели, но всегда проверяйте факты и сохраняйте критическое мышление.

«Лучший ассистент — тот, который усиливает ваши возможности, а не заменяет ваш мозг»

Часто задаваемые вопросы

Чем Claude отличается от ChatGPT?

Claude от Anthropic фокусируется на безопасности и длинном контексте. ChatGPT от OpenAI более креативен и имеет больше плагинов. Выбор зависит от задачи: для анализа документов — Claude, для генерации идей — ChatGPT.

Можно ли использовать ИИ-ассистентов для работы с конфиденциальными данными?

Да, но с осторожностью. Claude обещает не использовать данные для обучения, ChatGPT предлагает корпоративные планы с защитой. Лучше проверять политику конфиденциальности и не загружать чувствительные данные без шифрования.

Какой ассистент лучше всего подходит для написания кода?

GitHub Copilot — для интеграции в IDE, ChatGPT — для быстрой генерации, Claude — для анализа и рефакторинга. Для вайб-кодинга (стиль программирования) есть отдельные рекомендации — читайте статью про особенности вайб-кодинга.

Что такое конституционный ИИ?

Это метод обучения, при котором модель руководствуется набором принципов (конституцией), а не только оценками людей. Это снижает предвзятость и делает поведение модели более предсказуемым. Используется в Claude.

Когда появятся полностью автономные агенты?

Уже есть прототипы (AutoGPT, AgentGPT), но они ненадёжны. Полная автономность требует решения проблем безопасности, планирования и контроля. Ожидается, что к 2027-2028 годам агенты станут коммерчески пригодными для простых задач.