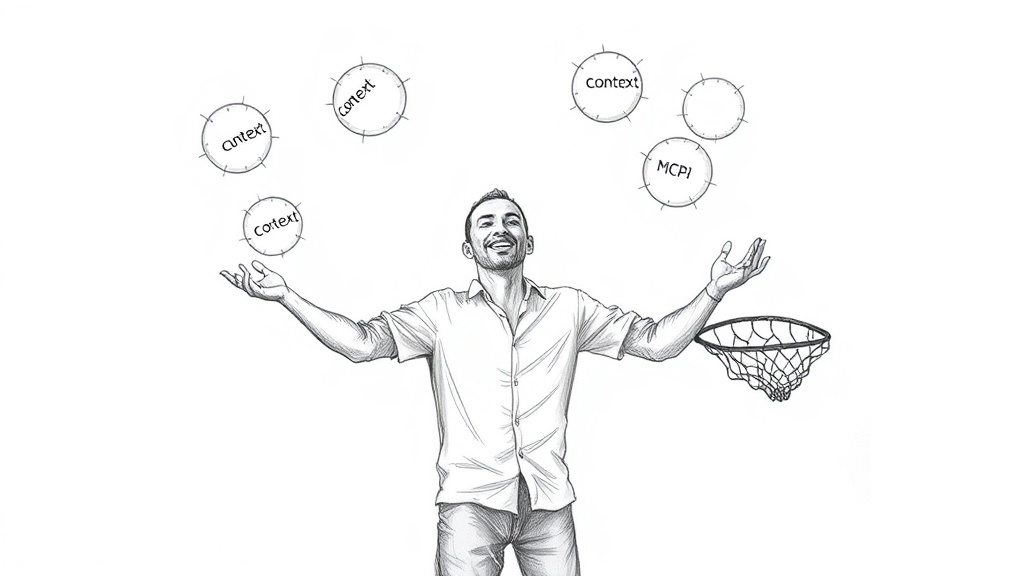

MCP-сервер (Model Context Protocol) — это ключевой компонент современных AI-систем, который решает проблему управления контекстом.

В этой статье мы разберем, как устроен MCP-сервер, из каких компонентов он состоит, какие возможности предоставляет и как его внедрить в production. Вы узнаете, чем MCP отличается от REST, gRPC и WebSocket, и получите практические рекомендации по развертыванию и масштабированию.

Введение: что такое MCP-сервер и зачем он нужен

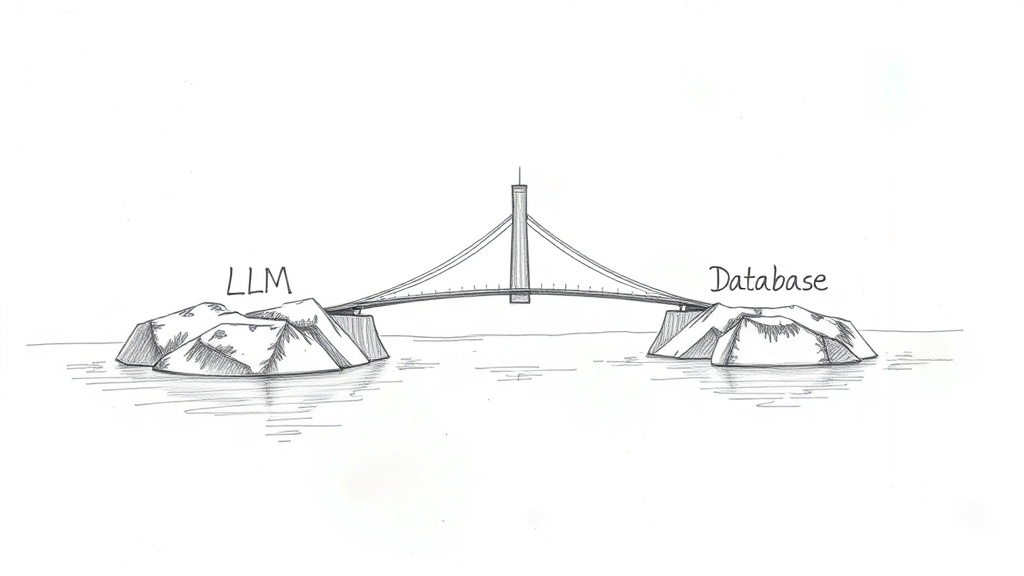

MCP-сервер — это специализированный сервер, реализующий протокол Model Context Protocol. Он служит центральным узлом для хранения, передачи и синхронизации контекста между компонентами AI-системы.

В отличие от обычной базы данных, MCP-сервер оптимизирован для работы с динамическим контекстом LLM и поддерживает подписки на изменения, версионирование и потоковую передачу.

Важно: MCP — это не база данных, а протокол для обмена контекстом между компонентами AI-системы.

Основная проблема, которую решает MCP, — ограниченное контекстное окно LLM. Даже самые современные модели могут обрабатывать лишь ограниченный объем данных за раз. MCP-сервер позволяет хранить историю диалогов, результаты RAG-поиска и состояние сессии, а затем предоставлять их модели по мере необходимости.

Проблема управления контекстом в AI-системах

Современные AI-системы сталкиваются с несколькими сложностями при работе с контекстом. Во-первых, это ограничения контекстного окна LLM — модель может «забыть» предыдущие части диалога. Во-вторых, в микросервисной архитектуре разные сервисы могут иметь разный контекст, что приводит к несогласованности. В-третьих, требуется различать долговременную и кратковременную память.

Ограничения контекстного окна

LLM имеют фиксированный размер контекстного окна — например, 4K, 8K или 128K токенов. Если диалог длится долго, модель может потерять нить беседы. MCP-сервер решает эту проблему, предоставляя только релевантный контекст по запросу.

Синхронизация между микросервисами

В распределенных AI-системах каждый микросервис может иметь свой собственный контекст. Например, сервис анализа тональности и сервис генерации ответа могут работать с разными данными. MCP-сервер обеспечивает единую точку истины для всех компонентов.

Долговременная vs кратковременная память

Кратковременная память (контекст текущей сессии) и долговременная память (история диалогов пользователя) требуют разных механизмов хранения. MCP-сервер поддерживает оба режима с помощью гибридных стратегий.

Роль MCP в современных архитектурах AI

MCP-сервер становится центральным узлом в архитектурах, где требуется синхронизация контекста. Он используется в чат-ботах с памятью, мультиагентных системах и RAG-пайплайнах.

Чат-боты с долговременной памятью

Пример: чат-бот для поддержки клиентов, который помнит предыдущие обращения пользователя. MCP-сервер хранит историю диалогов и предоставляет ее модели для персонализации ответов.

Мультиагентные системы

В системах с несколькими AI-агентами (например, для автоматизации бизнес-процессов) MCP-сервер синхронизирует контекст между агентами, чтобы они не дублировали действия.

RAG и контекстная релевантность

В RAG-пайплайнах MCP-сервер хранит результаты поиска по векторной базе данных и предоставляет их модели для генерации ответа с учетом актуального контекста.

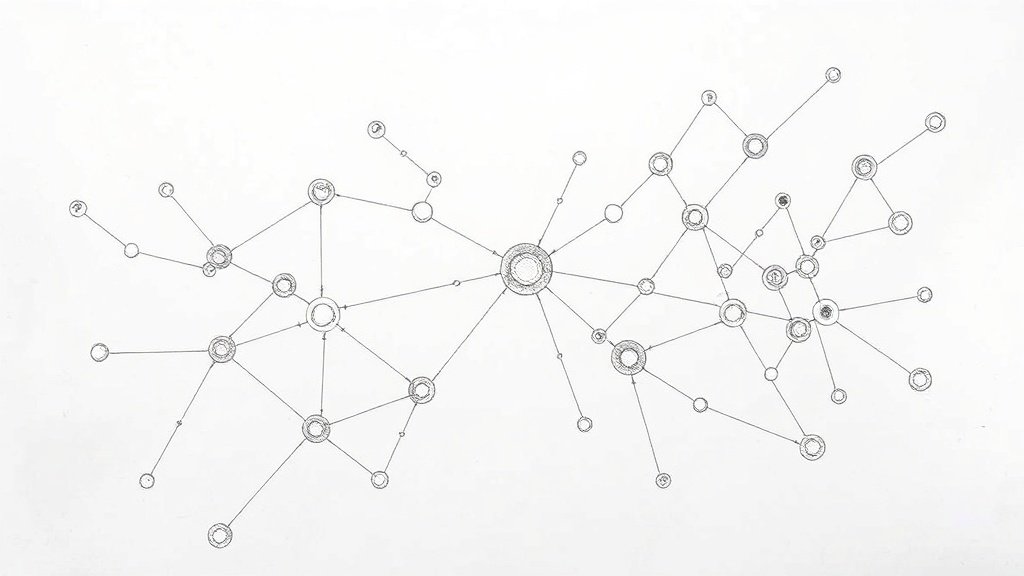

Архитектура MCP-сервера: основные компоненты

MCP-сервер состоит из нескольких модулей: ядро, менеджер контекста, транспортный слой, API-шлюз и хранилище. Каждый компонент отвечает за свою часть работы, что обеспечивает модульность и гибкость масштабирования.

Важно: Архитектура MCP-сервера должна быть модульной для гибкого масштабирования.

Ядро MCP-сервера

Ядро — центральный модуль, который обрабатывает запросы, валидирует контекст и маршрутизирует их. Жизненный цикл запроса включает прием, проверку, обработку и отправку ответа.

Обработчик запросов

Принимает входящие запросы от клиентов (LLM, микросервисов) и передает их валидатору.

Валидатор контекста

Проверяет корректность переданного контекста: формат, размер, наличие обязательных полей. Если контекст невалиден, возвращает ошибку.

Маршрутизатор

Определяет, какой компонент должен обработать запрос: менеджер контекста, хранилище или внешний сервис.

Менеджер контекста

Менеджер контекста управляет состоянием: создает, обновляет, удаляет и версионирует контекст. Он поддерживает три режима работы: in-memory (для быстрого доступа), persistent (для долговременного хранения) и hybrid (комбинация).

In-memory cache

Использует оперативную память для хранения часто используемого контекста. Обеспечивает низкую задержку, но требует резервирования.

Persistent storage (PostgreSQL, Redis, S3)

Для долговременного хранения используются базы данных (PostgreSQL), кэши (Redis) или объектные хранилища (S3). Выбор зависит от требований к надежности и скорости.

Hybrid-стратегии

Сочетание in-memory и persistent: горячий контекст хранится в памяти, холодный — на диске. Это балансирует производительность и стоимость.

Транспортный слой и API

Транспортный слой отвечает за передачу данных между клиентом и сервером. Поддерживаются протоколы HTTP/2, gRPC и WebSocket. Форматы сериализации: JSON, Protobuf, MessagePack.

HTTP/2 vs gRPC

HTTP/2 обеспечивает мультиплексирование и сжатие заголовков, что снижает задержки. gRPC быстрее за счет бинарного протокола и поддержки streaming, но сложнее в настройке.

WebSocket для real-time

WebSocket позволяет устанавливать постоянное соединение для потоковой передачи контекста. Это критично для real-time приложений, таких как чат-боты.

Сериализация: JSON vs Protobuf

JSON удобен для отладки, но медленнее. Protobuf компактнее и быстрее, но требует генерации кода. Выбор зависит от требований к производительности.

Основные возможности MCP-сервера

MCP-сервер предоставляет набор функций, которые напрямую влияют на производительность и безопасность AI-системы. Рассмотрим ключевые из них.

Важно: Возможности MCP-сервера напрямую влияют на производительность и безопасность AI-системы.

Контекстная память и версионирование

MCP-сервер хранит историю контекста, поддерживает версии и позволяет откатывать изменения. Например, чат-бот может восстановить предыдущий диалог, если пользователь вернулся к нему.

Хранение истории

Каждый запрос и ответ сохраняются с меткой времени. История может быть использована для анализа или обучения моделей.

Версионирование контекста

Поддерживаются версии контекста, что позволяет откатывать изменения в случае ошибок. Например, если LLM сгенерировала некорректный ответ, можно вернуться к предыдущей версии.

Откат изменений

Механизм отката позволяет восстановить контекст до определенного состояния. Это полезно при тестировании или отладке.

Подписки на изменения контекста

Клиенты могут подписываться на изменения контекста через WebSocket или Server-Sent Events. При изменении контекста сервер отправляет уведомление всем подписчикам.

WebSocket-подписки

Устанавливается постоянное соединение, по которому сервер отправляет обновления. Подходит для real-time систем.

Server-Sent Events

Более легковесный механизм, чем WebSocket, но поддерживает только однонаправленную передачу от сервера к клиенту.

Фильтрация событий

Клиенты могут фильтровать события по типу контекста, чтобы получать только релевантные обновления.

Кэширование и сжатие

Для ускорения доступа к часто используемому контексту применяются стратегии кэширования, такие как LRU (Least Recently Used). Сжатие данных (gzip, brotli) уменьшает сетевую нагрузку.

LRU-кэш

Хранит последние использованные контексты в памяти. При переполнении удаляются наименее используемые.

Сжатие gzip/brotli

Сжимает данные перед передачей, что снижает время передачи. Особенно эффективно для больших контекстов.

Инвалидация кэша

При обновлении контекста старые версии должны быть удалены из кэша. Используются механизмы TTL (Time To Live) или явная инвалидация.

Сравнение MCP с альтернативными протоколами

Выбор протокола зависит от требований к real-time, объему данных и сложности системы. Рассмотрим сравнение MCP с REST, gRPC и WebSocket.

Важно: Выбор протокола зависит от требований к real-time, объему данных и сложности системы.

| Критерий | MCP | REST | gRPC | WebSocket |

|---|---|---|---|---|

| Latency | Низкая (подписки) | Высокая (polling) | Очень низкая | Низкая (постоянное соединение) |

| Throughput | Высокий (streaming) | Средний | Очень высокий | Высокий |

| Сложность реализации | Средняя | Низкая | Высокая | Средняя |

| Поддержка контекста | Полная (версионирование, подписки) | Отсутствует | Частичная (streaming) | Только передача |

| Streaming | Да | Нет (только polling) | Да | Да |

MCP vs REST

REST — статичный протокол запрос-ответ, который требует polling для получения обновлений. MCP поддерживает подписки, что снижает нагрузку на сеть. REST проще в реализации, но MCP лучше подходит для динамических систем.

Polling vs push

REST требует периодических запросов для проверки изменений (polling), что увеличивает задержку и нагрузку. MCP использует push-уведомления, что снижает задержку до минимума.

Статичность vs динамика

REST предполагает статичные ресурсы, тогда как MCP динамически управляет контекстом.

Простота реализации

REST проще в реализации за счет широкой поддержки HTTP, но MCP предоставляет более высокоуровневые абстракции.

MCP vs gRPC

gRPC быстрее за счет бинарного протокола, но сложнее в настройке. MCP ориентирован на управление контекстом, а gRPC — на удаленные вызовы процедур.

Производительность

gRPC обеспечивает более высокую производительность за счет Protobuf и HTTP/2. MCP также использует HTTP/2, но с дополнительными накладными расходами на управление контекстом.

Сложность настройки

gRPC требует определения .proto файлов и генерации клиентов. MCP проще в настройке, но менее гибкий.

Поддержка контекста

MCP предоставляет встроенные механизмы для работы с контекстом (версионирование, подписки), тогда как в gRPC их нужно реализовывать самостоятельно.

MCP vs WebSocket

WebSocket — низкоуровневый протокол для двунаправленной связи. MCP — высокоуровневый протокол с управлением контекстом. WebSocket лучше использовать, когда нужна только передача данных без управления состоянием.

Уровень абстракции

WebSocket предоставляет только канал связи, MCP — готовые механизмы для работы с контекстом.

Управление состоянием

MCP управляет состоянием контекста, WebSocket — нет. В WebSocket нужно реализовывать собственную логику.

Безопасность

MCP включает встроенные механизмы аутентификации и авторизации, WebSocket требует отдельной настройки.

Практические сценарии использования MCP-серверов

MCP-серверы применяются в различных сценариях, где требуется синхронизация контекста между компонентами AI-системы. Рассмотрим три основных: чат-боты, RAG-пайплайны и мультиагентные системы.

Важно: MCP-сервер незаменим в системах, где требуется синхронизация контекста между множеством AI-агентов.

Чат-боты с долговременной памятью

MCP-сервер хранит историю диалогов, позволяет боту помнить пользователя и контекст сессии. Например, в сценарии поддержки клиентов бот может восстановить предыдущее обращение.

Сценарий: поддержка клиентов

Пользователь обращается в поддержку несколько раз. MCP-сервер хранит историю обращений, и бот может предложить решение на основе предыдущих диалогов.

Сценарий: персональный ассистент

Персональный ассистент запоминает предпочтения пользователя (например, любимые рестораны) и использует их в дальнейшем.

RAG-пайплайны с динамическим контекстом

MCP-сервер выступает как источник релевантного контекста для генерации ответов. Он интегрируется с векторными базами данных для извлечения контекста в реальном времени.

Извлечение контекста

При запросе пользователя MCP-сервер извлекает релевантный контекст из векторной базы данных и передает его LLM.

Обновление контекста в реальном времени

Если контекст меняется (например, появляется новая информация), MCP-сервер обновляет его и уведомляет подписчиков.

Мультиагентные системы

В системах с несколькими AI-агентами MCP-сервер координирует их действия через общий контекст. Например, в системе автоматизации бизнес-процессов один агент собирает данные, другой их анализирует, третий генерирует отчет.

Общий контекст агентов

Все агенты имеют доступ к единому контексту, что исключает дублирование и конфликты.

Синхронизация действий

MCP-сервер гарантирует, что действия агентов выполняются в правильном порядке, и контекст обновляется после каждого шага.

Развертывание и конфигурация MCP-сервера

Развертывание MCP-сервера включает установку, настройку безопасности и мониторинг. Рассмотрим пошаговое руководство.

Совет: При развертывании обязательно настройте TLS и ограничьте доступ по API-ключам.

Установка и запуск

MCP-сервер можно установить через Docker, на bare-metal или в Kubernetes. Минимальная конфигурация для старта включает настройку хранилища и API.

Docker-образ

Самый простой способ — использовать готовый Docker-образ. Пример команды: docker run -p 8080:8080 mcp-server.

Helm-чарт для Kubernetes

Для продакшена рекомендуется использовать Helm-чарт, который автоматизирует развертывание в Kubernetes.

Сборка из исходников

Если нужна кастомизация, можно собрать сервер из исходного кода. Это требует настройки окружения и зависимостей.

Настройка безопасности

Безопасность включает TLS для шифрования трафика, аутентификацию через API-ключи или JWT, авторизацию на основе RBAC и шифрование данных at rest.

TLS-сертификаты

Настройте TLS для защиты данных в пути. Используйте сертификаты от Let’s Encrypt или внутреннего CA.

JWT-токены

Для аутентификации клиентов используйте JWT-токены, которые проверяются на стороне сервера.

RBAC-роли

Определите роли (администратор, пользователь, гость) и ограничьте доступ к контексту на основе ролей.

Мониторинг и логирование

Интеграция с Prometheus и Grafana позволяет отслеживать метрики производительности: latency, throughput, количество контекстов. Логирование запросов в ELK помогает в отладке.

Метрики производительности

Собирайте метрики: время ответа, количество запросов в секунду, размер контекста.

Логирование ошибок

Логируйте все ошибки и предупреждения для анализа инцидентов.

Алерты

Настройте алерты на превышение пороговых значений latency или ошибок.

Производительность и масштабирование MCP-сервера

Производительность MCP-сервера зависит от размера контекста, количества клиентов и типа хранилища. Для масштабирования применяются горизонтальное и вертикальное масштабирование, а также шардирование.

Важно: Горизонтальное масштабирование MCP-сервера требует согласования контекста между инстансами.

Бенчмарки и узкие места

Типичные бенчмарки показывают, что latency растет пропорционально размеру контекста, а throughput падает при увеличении числа клиентов. Основные узкие места — I/O (дисковая подсистема) и CPU (сериализация/десериализация).

Latency vs размер контекста

При размере контекста 1 МБ latency составляет около 10 мс, при 10 МБ — до 100 мс. Рекомендуется ограничивать размер контекста.

Throughput vs число клиентов

При 100 клиентах throughput составляет около 1000 запросов в секунду, при 1000 — падает до 500. Для повышения используйте балансировку нагрузки.

Узкие места: I/O, CPU, сеть

I/O — узкое место при использовании дисковых хранилищ. CPU — при частой сериализации. Сеть — при большом количестве клиентов.

Стратегии масштабирования

Горизонтальное масштабирование с распределенным кэшем (Redis Cluster) позволяет увеличить throughput. Шардирование по ID контекста распределяет нагрузку. Вертикальное масштабирование (увеличение RAM) подходит для in-memory решений.

Горизонтальное: Redis Cluster

Используйте Redis Cluster для распределенного кэширования контекста между инстансами.

Шардирование контекста

Разделите контексты по ID на разные шарды, чтобы каждый инстанс обрабатывал только свою часть.

Вертикальное: увеличение RAM

Если контексты небольшие, можно увеличить RAM на одном сервере, что проще, но менее отказоустойчиво.

Оптимизация конфигурации

Настройте пулы соединений, тайм-ауты, размер кэша и буферизацию для повышения производительности.

Пул соединений

Увеличьте размер пула соединений к базе данных, чтобы избежать ожидания.

Тайм-ауты

Установите разумные тайм-ауты (например, 5 секунд для запроса), чтобы не блокировать сервер.

Размер кэша

Настройте размер LRU-кэша в зависимости от доступной памяти. Слишком большой кэш может привести к переполнению памяти.

Заключение: будущее MCP-серверов

MCP-серверы становятся стандартом для управления контекстом в AI-системах. Они решают ключевые проблемы: ограниченное контекстное окно LLM, синхронизацию между сервисами и управление памятью. В будущем ожидается интеграция с edge-вычислениями, поддержка федеративного контекста и улучшение безопасности.

Важно: MCP-серверы становятся стандартом для управления контекстом в AI-системах.

«MCP-серверы — это мост между LLM и реальными данными, который делает AI-системы умнее и быстрее.» — из опыта архитекторов распределенных систем.

Основные выводы

MCP-сервер имеет модульную архитектуру, поддерживает версионирование контекста, подписки на изменения и кэширование. Он превосходит REST, gRPC и WebSocket в задачах управления контекстом. Рекомендуется для чат-ботов, RAG-пайплайнов и мультиагентных систем. При развертывании важно настроить безопасность и мониторинг.

Тренды и развитие

Тренды включают edge-вычисления, федеративный контекст и serverless-развертывание. Улучшенная безопасность (например, сквозное шифрование) станет ключевым направлением.

Edge-вычисления

MCP-серверы на edge-устройствах позволят обрабатывать контекст локально, снижая задержки.

Федеративный контекст

Поддержка федеративного контекста позволит объединять данные из разных источников без централизации.

Serverless-развертывание

Serverless-архитектура упростит развертывание и масштабирование MCP-серверов, снижая затраты.

Попробуйте MCP-сервер в своем проекте — это может значительно упростить управление контекстом и повысить производительность AI-системы. Для более глубокого понимания сравнения AI-ассистентов рекомендуем статью Claude против ChatGPT: сравнение ИИ-ассистентов 2026, а также обзор Cursor: возможности ИИ-ассистента для разработчиков с примерами. Если вы рассматриваете различные подходы к разработке, обратите внимание на Вайб-кодинг и традиционная разработка: сравнение подходов и эффективности.

Часто задаваемые вопросы

Что такое MCP-сервер простыми словами?

MCP-сервер — это сервер, который хранит и синхронизирует контекст (историю диалогов, данные сессии) между компонентами AI-системы, такими как LLM и микросервисы.

Чем MCP отличается от REST API?

REST — это статичный протокол запрос-ответ, который требует polling для обновлений. MCP поддерживает подписки на изменения, версионирование и потоковую передачу, что лучше подходит для динамических AI-систем.

Какие протоколы поддерживает MCP?

MCP поддерживает HTTP/2, gRPC и WebSocket для передачи данных, а также форматы сериализации JSON, Protobuf и MessagePack.

Как обеспечить безопасность MCP-сервера?

Настройте TLS для шифрования трафика, используйте аутентификацию через JWT или API-ключи, авторизацию на основе RBAC и шифрование данных at rest.

Можно ли масштабировать MCP-сервер горизонтально?

Да, горизонтальное масштабирование возможно с использованием распределенного кэша (например, Redis Cluster) и шардирования контекста по ID.

Какие сценарии использования MCP-сервера наиболее популярны?

Наиболее популярные сценарии: чат-боты с долговременной памятью, RAG-пайплайны с динамическим контекстом и мультиагентные системы.