MCP Server — это программное обеспечение, реализующее протокол Model Context Protocol (MCP). Если проще, это универсальный шлюз, который позволяет AI-моделям (например, GPT, Claude, Llama) безопасно и эффективно подключаться к вашим данным: базам данных, API, файлам и другим сервисам.

В этой статье разберем, как работает MCP Server, зачем он нужен, как его установить и настроить, а также сравним с альтернативами.

Введение в MCP Server

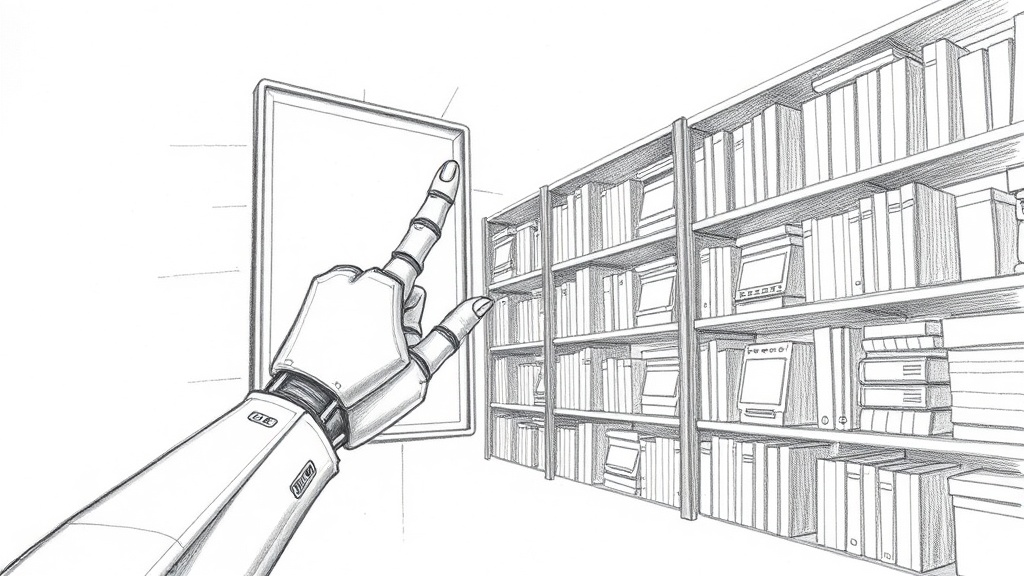

Современные языковые модели (LLM) хороши в генерации текста, но у них есть ограничение: они не имеют доступа к актуальным данным за пределами своего обучающего корпуса.

Именно здесь на помощь приходит MCP Server. Он выступает в роли посредника: модель отправляет запрос на сервер, сервер находит нужную информацию во внешнем источнике и возвращает ее модели в структурированном виде.

Примеры использования:

- Чат-боты, которые могут отвечать на вопросы, используя данные из корпоративной базы знаний.

- AI-агенты, выполняющие действия в CRM или ERP-системах по текстовой команде.

- Автоматизация рутинных задач: обработка документов, генерация отчетов, мониторинг систем.

Важно: MCP Server — это не просто сервер, а универсальный шлюз для подключения AI-моделей к любым источникам данных и инструментам.

«Model Context Protocol (MCP) — это открытый стандарт, который определяет, как AI-модели взаимодействуют с внешними данными и сервисами. Он призван заменить разрозненные интеграции единым протоколом».

Что такое Model Context Protocol?

Model Context Protocol (MCP) — это протокол прикладного уровня, который стандартизирует обмен данными между AI-моделями и внешними источниками. Он определяет формат запросов, ответов, механизмы аутентификации и управления контекстом. По сути, это аналог REST или gRPC, но заточенный под потребности LLM.

История создания MCP

Протокол был разработан как ответ на растущую потребность в унифицированном способе подключения моделей к разнородным данным. До появления MCP разработчикам приходилось писать отдельные адаптеры для каждого источника, что усложняло поддержку и масштабирование.

Ключевые особенности протокола

- Асинхронность: запросы от модели могут обрабатываться параллельно.

- Безопасность: встроенная поддержка аутентификации и авторизации.

- Гибкость: поддержка различных типов данных: текст, JSON, бинарные файлы.

MCP vs другие протоколы

В отличие от REST, MCP оптимизирован для работы с контекстом модели: он умеет передавать не только результат запроса, но и метаданные (например, источник данных, время запроса, уровень доступа). gRPC обеспечивает высокую производительность, но требует бинарной сериализации, что усложняет отладку. MCP использует JSON, что делает его более простым для интеграции.

Зачем нужен MCP Server?

Основная задача MCP Server — решить три ключевые проблемы, возникающие при интеграции AI-моделей с внешними системами:

Изоляция контекста модели

Каждая модель работает в своем контексте (например, сессия диалога). MCP Server позволяет изолировать эти контексты, чтобы данные одного пользователя не смешивались с данными другого.

Управление доступом к данным

Сервер выступает в роли шлюза безопасности: он проверяет, имеет ли модель (или пользователь, от имени которого она работает) право на доступ к конкретному источнику данных.

Гибкость интеграции

MCP Server поддерживает подключение различных источников через адаптеры. Это значит, что вы можете легко добавить новую базу данных или API, не меняя код самой модели.

Архитектура MCP Server

Чтобы понять, как работает MCP Server, полезно разобрать его внутреннее устройство. Архитектура обычно модульная, что позволяет легко заменять или добавлять компоненты.

Важно: Архитектура MCP Server должна быть модульной, чтобы легко добавлять новые источники данных без изменения ядра.

Основные компоненты

Типичный MCP Server состоит из следующих модулей:

| Компонент | Функция | Пример |

|---|---|---|

| Request Handler | Принимает запросы от модели, валидирует их и маршрутизирует | Проверка формата JSON, определение типа запроса |

| Context Manager | Управляет сессиями и контекстом каждого запроса | Хранение истории диалога, параметров аутентификации |

| Source Adapters | Адаптеры для подключения к внешним источникам | PostgreSQL Adapter, REST API Adapter |

| Cache | Кэширует часто запрашиваемые данные для ускорения ответа | Redis, in-memory cache |

| Logger | Логирует все запросы и ошибки для мониторинга и отладки | Запись в файл, отправка в ELK Stack |

Request Handler: маршрутизация и валидация

Этот компонент — точка входа. Он проверяет, что запрос соответствует протоколу MCP: правильные поля, корректные типы данных. Затем он определяет, к какому источнику данных нужно обратиться, и передает управление Context Manager.

Context Manager: управление сессиями

Context Manager хранит состояние сессии: идентификатор пользователя, уровень доступа, историю запросов. Это важно для поддержания диалога и обеспечения безопасности.

Source Adapters: подключение к БД, API, файлам

Адаптеры — это плагины, которые реализуют взаимодействие с конкретным источником. Например, адаптер для PostgreSQL знает, как выполнить SQL-запрос и вернуть результат в формате, понятном модели.

Поток данных в MCP Server

Рассмотрим типичный путь запроса от модели до источника данных и обратно:

- Шаг 1: Получение запроса от модели. Модель отправляет JSON-запрос на endpoint MCP Server. Запрос содержит тип действия (например, ‘get_data’), идентификатор сессии и параметры.

- Шаг 2: Аутентификация и авторизация. Request Handler проверяет токен доступа. Если токен недействителен, запрос отклоняется.

- Шаг 3: Поиск и агрегация контекста. Context Manager определяет, какие источники данных разрешены для данной сессии. Затем Source Adapter выполняет запрос к источнику (например, SELECT * FROM users WHERE id = ?).

- Шаг 4: Формирование ответа. Результат преобразуется в формат MCP (JSON) и отправляется обратно модели. В ответе также могут быть метаданные: время выполнения, количество записей, предупреждения.

Установка и настройка MCP Server

Перейдем к практике. Рассмотрим, как установить MCP Server на примере популярного стека Python.

Совет: При установке обязательно используйте изолированное окружение (Docker, venv) для избежания конфликтов зависимостей.

Системные требования

MCP Server написан на Python и требует Python 3.9 или выше. Рекомендуемые характеристики сервера: от 2 ядер CPU, 4 ГБ RAM, 20 ГБ свободного дискового пространства. Для продакшен-нагрузок лучше использовать Linux (Ubuntu 22.04 LTS).

| Зависимость | Версия | Примечание |

|---|---|---|

| Python | >=3.9 | Основной язык |

| Redis | >=6.0 | Для кэширования и очередей |

| PostgreSQL | >=13 | Для хранения конфигураций и логов |

Пошаговая установка

Установка через pip

Создайте виртуальное окружение и установите пакет:

python3 -m venv venv

source venv/bin/activate

pip install mcp-serverУстановка через Docker

Самый простой способ — использовать готовый образ:

docker run -d --name mcp-server -p 8080:8080 -e MCP_CONFIG=/etc/mcp/config.yaml mcp/server:latestКонфигурация и переменные окружения

Основные параметры задаются через файл конфигурации (YAML или JSON) или переменные окружения. Пример файла .env:

MCP_PORT=8080

MCP_LOG_LEVEL=info

MCP_REDIS_URL=redis://localhost:6379

MCP_DATABASE_URL=postgresql://user:pass@localhost:5432/mcpdb

Настройка порта и хоста

По умолчанию сервер слушает порт 8080 на всех интерфейсах. Для продакшена рекомендуется использовать reverse proxy (Nginx) и настроить HTTPS.

Подключение к PostgreSQL

Укажите строку подключения к базе данных, где будут храниться конфигурации и логи. Сервер сам создаст необходимые таблицы при первом запуске.

Настройка Redis для кэша

Redis используется для кэширования часто запрашиваемых данных. Укажите URL Redis в переменной MCP_REDIS_URL.

Подключение источников данных

Одна из сильных сторон MCP Server — возможность легко подключать различные источники данных через адаптеры.

Частая ошибка: Для каждого источника данных необходимо настроить отдельный адаптер с учетом его протокола и прав доступа.

Подключение SQL-баз данных

Адаптеры для реляционных баз данных поддерживают SQL-запросы. Пример для PostgreSQL:

sources:

- name: my_postgres

type: postgresql

connection_string: postgresql://user:pass@localhost:5432/mydb

pool_size: 10

PostgreSQL адаптер

Поддерживает параметризованные запросы, транзакции и пул соединений. Рекомендуется использовать для транзакционных данных.

MySQL адаптер

Аналогичен PostgreSQL, но с учетом особенностей MySQL (например, поддержка FULLTEXT индексов).

SQLite адаптер

Подходит для локальных тестов и небольших проектов. Не требует отдельного сервера.

Подключение NoSQL-баз данных

Для документо-ориентированных и ключ-значение хранилищ.

MongoDB адаптер

Позволяет выполнять запросы к коллекциям, используя синтаксис MQL (MongoDB Query Language).

Redis адаптер

Используется для быстрого доступа к данным по ключу. Часто применяется для кэширования и хранения сессий.

Elasticsearch адаптер

Предназначен для полнотекстового поиска и аналитики. Поддерживает запросы в формате Query DSL.

Подключение внешних API

Адаптеры для REST, GraphQL и gRPC API позволяют модели взаимодействовать с любыми веб-сервисами.

REST API адаптер

Настраивается через указание базового URL, метода (GET, POST) и схемы аутентификации (API key, Bearer token).

GraphQL адаптер

Позволяет отправлять запросы к GraphQL-эндпоинтам. Указывается URL и, при необходимости, заголовки.

gRPC адаптер

Для высокопроизводительных микросервисов. Требуется файл .proto для описания сервиса.

Безопасность MCP Server

Безопасность — критически важный аспект, так как MCP Server имеет доступ к вашим данным.

Важно: Никогда не храните секреты в коде — используйте переменные окружения или секрет-менеджеры.

Аутентификация и авторизация

Сервер поддерживает несколько механизмов аутентификации:

API ключи

Простой способ: каждый клиент (модель) получает уникальный ключ, который передается в заголовке запроса.

JWT токены

Более безопасный вариант: токен содержит информацию о пользователе и сроке действия. Сервер проверяет подпись токена.

OAuth2 интеграция

Для корпоративных систем можно подключить внешнего провайдера (например, Keycloak).

Шифрование данных

Все данные, передаваемые между моделью и сервером, должны шифроваться с помощью TLS/SSL. Контекст в памяти также может быть зашифрован для защиты от утечек.

TLS/SSL настройка

Укажите пути к сертификату и ключу в конфигурации. Для тестов можно использовать самоподписанные сертификаты.

Шифрование контекста

Включите опцию encrypt_context: true, чтобы сервер шифровал содержимое сессий при хранении в Redis.

Управление сертификатами

Для продакшена используйте Let’s Encrypt или корпоративный CA.

Защита от атак

Сервер включает встроенные механизмы защиты:

Валидация входных данных

Все запросы проверяются на соответствие схеме. SQL-инъекции блокируются благодаря параметризованным запросам.

Лимиты запросов

Настройте rate limiting, чтобы предотвратить DoS-атаки. Например, не более 100 запросов в минуту с одного IP.

Мониторинг подозрительной активности

Логирование всех попыток доступа и ошибок аутентификации. Можно интегрировать с SIEM-системами.

Производительность и масштабирование

Для продакшен-систем важны задержка (latency) и пропускная способность (throughput).

Совет: Для высоконагруженных систем обязательно используйте кэширование и асинхронную обработку запросов.

Оптимизация latency

Снизить задержку помогут следующие техники:

Кэширование в Redis

Настройте TTL для часто запрашиваемых данных. Например, результаты запросов к справочникам можно кэшировать на час.

Пул соединений к БД

Используйте пул соединений, чтобы не создавать новое подключение на каждый запрос. Размер пула зависит от нагрузки.

Асинхронная обработка

Включите асинхронный режим для адаптеров, чтобы сервер мог обрабатывать несколько запросов одновременно, не блокируя друг друга.

Горизонтальное масштабирование

Когда одного инстанса MCP Server недостаточно, можно запустить несколько реплик.

Балансировка с Nginx

Настройте upstream в Nginx для распределения запросов между инстансами:

upstream mcp_servers {

server 192.168.1.10:8080;

server 192.168.1.11:8080;

}

Кластер Redis

Для общего кэша используйте кластер Redis, чтобы данные были доступны всем инстансам.

Оркестрация Kubernetes

Разверните MCP Server в виде Deployment с Horizontal Pod Autoscaler на основе CPU/memory.

Мониторинг и логирование

Без мониторинга вы не узнаете о проблемах, пока не станет поздно.

Настройка Prometheus

MCP Server экспортирует метрики в формате Prometheus: количество запросов, ошибки, время ответа. Настройте сбор метрик.

Дашборды Grafana

Создайте дашборд с ключевыми метриками: latency p95, количество активных сессий, частота ошибок.

Логирование в ELK

Отправляйте логи в Elasticsearch для централизованного анализа. Используйте Filebeat для сбора логов.

Примеры использования MCP Server

Рассмотрим три реальных сценария, которые помогут понять, как применить MCP Server на практике.

Чат-бот с динамическим контекстом

Представьте чат-бота для техподдержки, который может обращаться к базе знаний и API биллинга.

Настройка источников данных

Подключите PostgreSQL с таблицами users и tickets, а также REST API для проверки статуса заказа.

Интеграция с Telegram

Чат-бот получает сообщение от пользователя, отправляет его в LLM, модель формирует запрос к MCP Server, сервер возвращает данные, и бот отправляет ответ.

Обработка диалогов

Context Manager хранит историю диалога, чтобы модель могла отвечать на уточняющие вопросы.

AI-агент для аналитики

Агент, который по текстовой команде выполняет SQL-запросы и строит отчеты.

Выполнение SQL запросов

Пользователь пишет: «Покажи продажи за последний месяц по регионам». Модель преобразует это в SQL, MCP Server выполняет запрос к БД и возвращает результат.

Генерация отчетов

Результат можно передать в BI-инструмент (например, Metabase) через API для визуализации.

Интеграция с Slack

Агент может отправлять готовые отчеты в канал Slack по команде.

Автоматизация документооборота

Обработка входящих документов: распознавание, классификация и сохранение.

Распознавание документов

Используйте OCR (Tesseract) для извлечения текста из PDF или изображений. MCP Server может вызвать внешний сервис OCR.

Классификация по типу

Модель определяет тип документа (счет, договор, акт) и отправляет запрос на сохранение в соответствующую таблицу БД.

Сохранение в БД

Адаптер PostgreSQL сохраняет извлеченные поля (номер, дата, сумма) в структурированном виде.

Сравнение MCP Server с альтернативами

На рынке есть несколько инструментов для интеграции LLM с данными. Сравним их по ключевым критериям.

Важно: Выбор инструмента зависит от конкретных задач: MCP Server подходит для сложных интеграций, а LangChain — для быстрого прототипирования.

| Критерий | MCP Server | LangChain | OpenAI Functions | RAG-системы |

|---|---|---|---|---|

| Сложность настройки | Средняя | Низкая | Низкая | Высокая |

| Гибкость | Высокая | Высокая | Низкая | Средняя |

| Производительность | Высокая | Средняя | Высокая | Средняя |

| Стоимость | Бесплатно (open source) | Бесплатно (open source) | Плата за API | Зависит от инфраструктуры |

MCP Server vs LangChain

LangChain — это фреймворк для построения цепочек LLM. Он проще в настройке для типовых задач (RAG, суммаризация). MCP Server выигрывает в масштабируемости и безопасности, так как является отдельным сервисом, а не библиотекой.

Архитектура

LangChain работает внутри приложения, MCP Server — как отдельный микросервис. Это дает изоляцию и возможность независимого масштабирования.

Поддержка протоколов

MCP Server поддерживает MCP из коробки, LangChain требует дополнительных адаптеров.

Масштабируемость

MCP Server легко масштабируется горизонтально, LangChain сложнее.

MCP Server vs OpenAI Functions

OpenAI Functions — это встроенная возможность вызывать внешние функции из модели. Она проста, но привязывает к экосистеме OpenAI и не дает контроля над данными.

Гибкость

MCP Server позволяет подключать любые источники, а не только те, что поддерживает OpenAI.

Контроль данных

С MCP Server данные не покидают вашу инфраструктуру, что важно для компаний с требованиями к конфиденциальности.

Стоимость

OpenAI Functions взимает плату за каждый вызов функции, MCP Server бесплатен (кроме затрат на инфраструктуру).

MCP Server vs RAG-системы

RAG (Retrieval-Augmented Generation) — это подход, при котором модель дополняется релевантными документами из векторной базы. MCP Server может использоваться как часть RAG-пайплайна, но также поддерживает и другие сценарии (например, выполнение действий).

Подход к контексту

RAG фокусируется на поиске документов, MCP Server — на произвольных запросах к данным.

Производительность

MCP Server с кэшированием может быть быстрее, чем RAG с векторным поиском.

Сложность

RAG требует настройки векторной базы и эмбеддингов, MCP Server — только подключения адаптеров.

Частые ошибки и как их избежать

Даже опытные разработчики допускают ошибки при настройке MCP Server. Разберем типичные проблемы.

Частая ошибка: Большинство ошибок связано с неправильной настройкой безопасности и кэширования.

Ошибки конфигурации

Проблемы с портами

Убедитесь, что порт не занят другим процессом. Используйте команду lsof -i :8080 для проверки.

Отсутствие переменных

Сервер не запустится, если не указаны обязательные переменные (например, MCP_DATABASE_URL). Проверьте файл .env.

Неверные пути

Пути к сертификатам или файлам конфигурации должны быть абсолютными или относительными от корня проекта.

Проблемы безопасности

Открытые эндпоинты

Не выставляйте MCP Server напрямую в интернет без аутентификации. Используйте VPN или reverse proxy с авторизацией.

Секреты в коде

Никогда не хардкодьте пароли и ключи. Используйте переменные окружения или vault.

Отсутствие HTTPS

Без шифрования данные передаются в открытом виде. Настройте HTTPS через Nginx или встроенный TLS.

Проблемы производительности

Отсутствие кэша

Без кэша каждый запрос будет обращаться к источнику данных, что увеличивает latency. Включите кэширование для статичных данных.

Медленные запросы к БД

Оптимизируйте SQL-запросы: используйте индексы, избегайте SELECT *.

Неоптимальные адаптеры

Некоторые адаптеры могут быть медленными из-за неэффективной реализации. Выбирайте проверенные адаптеры из официального репозитория.

Заключение и дальнейшие шаги

MCP Server — это мощный и гибкий инструмент для интеграции AI-моделей с вашими данными. Он решает проблемы безопасности, масштабируемости и изоляции контекста, которые возникают при прямом подключении моделей к источникам.

Совет: MCP Server — это мощный инструмент, который может значительно упростить интеграцию AI в вашу инфраструктуру.

«Начните с малого: установите MCP Server, подключите один источник данных и создайте простого AI-агента. Постепенно вы сможете расширять функциональность, добавляя новые адаптеры и сценарии».

Полезные ресурсы

Для дальнейшего изучения рекомендуем:

- Cursor: что это такое и как работает инструмент для работы с базами данных

- Особенности вайб-кодинга: от рабочего настроя до стиля программирования

- Как ИИ-ассистенты Copilot меняют подход к работе с кодом и документацией

Официальная документация

Посетите сайт протокола MCP для изучения спецификаций и примеров.

GitHub репозиторий

Исходный код MCP Server доступен на GitHub. Вы можете внести свой вклад или сообщить об ошибках.

Сообщество

Присоединяйтесь к форумам и Discord-каналам, посвященным MCP, чтобы обмениваться опытом.

Следующие шаги

Вот план действий после прочтения статьи:

- Установка: Установите MCP Server через Docker или pip.

- Подключение данных: Настройте первый адаптер, например, для PostgreSQL или REST API.

- Создание агента: Напишите простого AI-агента, который использует MCP Server для получения данных.

Часто задаваемые вопросы

Что такое MCP Server простыми словами?

Это сервер, который позволяет AI-моделям (как ChatGPT) безопасно обращаться к вашим базам данных, API и файлам, чтобы отвечать на вопросы или выполнять действия.

Чем MCP Server отличается от обычного API?

MCP Server специально спроектирован для работы с AI-моделями: он управляет контекстом сессии, поддерживает асинхронные запросы и встроенную безопасность. Обычный API требует ручной реализации этих функций.

Нужен ли MCP Server, если я использую LangChain?

Да, MCP Server может заменить или дополнить LangChain в части интеграции с внешними источниками данных, особенно если вам нужна изоляция и масштабируемость.

Какие языки программирования поддерживает MCP Server?

Официально поддерживается Python, но сообщество разрабатывает адаптеры для Node.js, Go и Java.

Как обеспечить безопасность MCP Server?

Используйте HTTPS, JWT или API ключи для аутентификации, настройте лимиты запросов и никогда не храните секреты в коде.