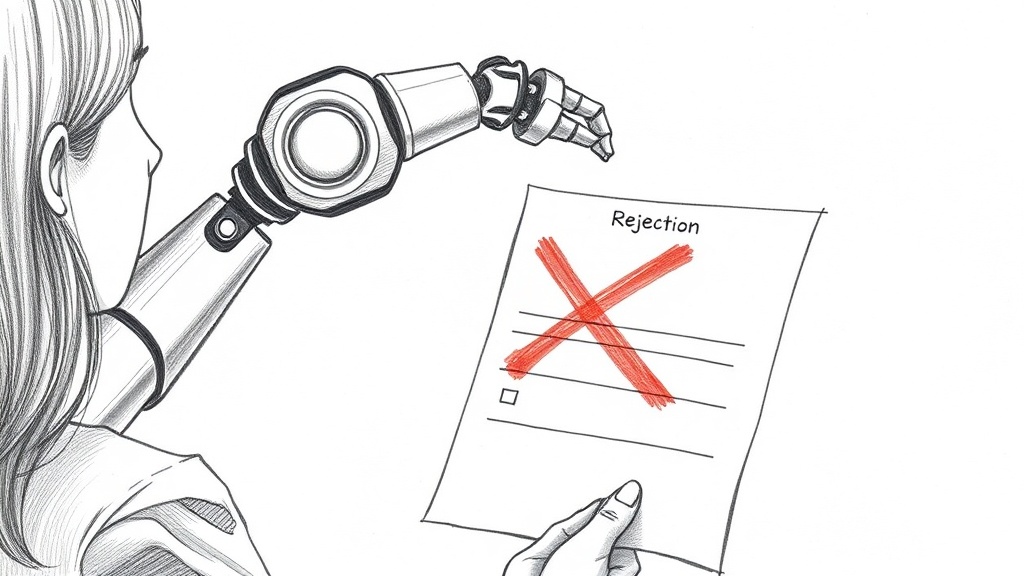

Как практик, который последние несколько лет занимается внедрением машинного обучения в продуктовые команды, я часто сталкиваюсь с ситуацией, когда за фасадом крутой метрики скрывается потенциально опасное поведение модели. Мы привыкли гнаться за accuracy, но забываем, что каждое решение ИИ — это чья-то судьба: отказ в кредите, неверный диагноз, дискриминация при найме.

В этой статье я разберу три столпа, без которых любой ИИ-продукт рано или поздно станет проблемой: этику, безопасность и честное признание ограничений. Вы получите не абстрактные рассуждения, а конкретные инструменты и чек-листы, которые можно применить уже завтра.

Введение: почему этика, безопасность и ограничения стали критическими для ИИ-кода

Искусственный интеллект перестал быть игрушкой для лабораторий. Он решает, кого взять на работу, какой кредит одобрить, а кого отправить в тюрьму. И каждый такой случай — потенциальный репутационный и финансовый удар. Вспомните историю с Amazon: их рекрутинговый алгоритм, обученный на исторических данных, начал дискриминировать женщин. Или инцидент с автопилотом Tesla, который не распознал боковую часть грузовика. Это не сбои, это системные проблемы, которые закладываются на этапе написания кода.

Игнорирование этих аспектов может привести к юридическим, репутационным и финансовым потерям.

Я не буду пугать вас апокалипсисом. Но как человек, который видел, как «безобидная» модель рекомендаций приводит к судебным искам из-за нарушения GDPR, скажу: лучше потратить время на профилактику сейчас, чем разгребать последствия потом. Цель статьи — дать вам целостное понимание и практические инструменты, чтобы вы могли создавать не только точные, но и ответственные системы.

Что такое ответственный ИИ?

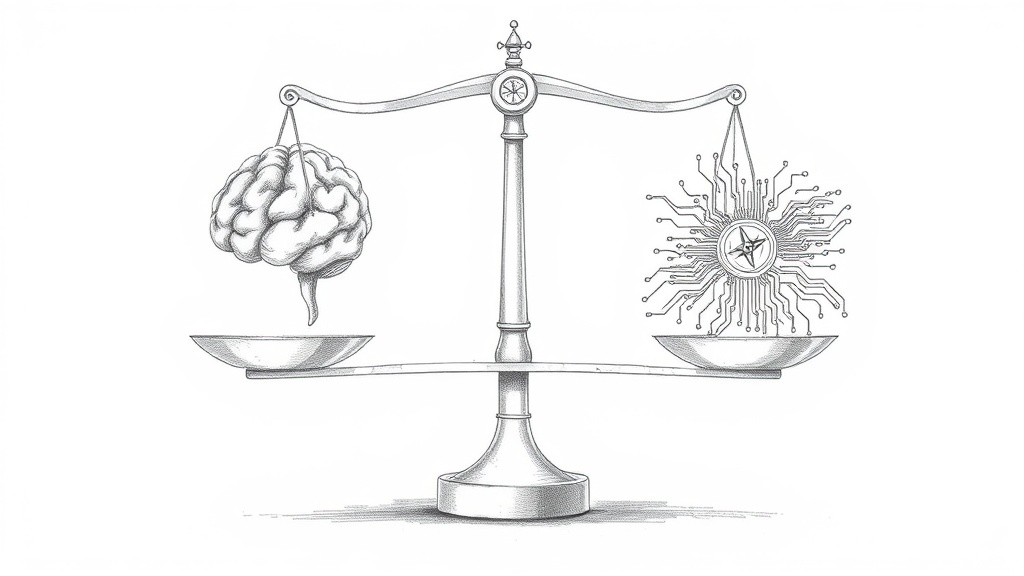

Ответственный ИИ (Responsible AI) — это не модный термин, а набор принципов, которые превращают разработку из хаотичного процесса в управляемую практику. Если упростить, то это четыре столпа: этичность, безопасность, прозрачность и подотчетность. Давайте разберем каждый.

Этичность

Модель не должна дискриминировать по полу, расе, возрасту или другим признакам. Это не только моральный, но и юридический вопрос. В Европе уже действует EU AI Act, который штрафует за предвзятость. В СНГ пока нет жестких законов, но рано или поздно они появятся — лучше готовиться заранее.

Безопасность

ИИ-система должна быть устойчива к атакам. Злоумышленники могут подменить данные, отравить модель или украсть приватную информацию через инференс. Это не теория заговора, а реальные угрозы, которые мы разберем ниже.

Прозрачность

Вы должны понимать, почему модель приняла то или иное решение. Без объяснимости вы не сможете доверять системе, особенно в критических областях вроде медицины или финансов.

Подотчетность

Кто отвечает, если ИИ ошибся? Разработчик? Компания? Алгоритм? Четкое распределение ответственности — основа доверия. Без этого любой инцидент превращается в юридический кошмар.

Этические аспекты разработки ИИ-кода

Этика в ИИ — это не про «хорошо» или «плохо». Это про системные риски, которые могут обрушить бизнес. Я не раз видел, как стартапы, сэкономившие на этических проверках, теряли контракты и репутацию. Давайте разберем ключевые болевые точки.

| Аспект | Проблема | Последствия |

|---|---|---|

| Предвзятость данных | Исторические данные содержат стереотипы | Дискриминация, суды, отзыв лицензий |

| Отсутствие объяснимости | Модель — черный ящик | Недоверие пользователей, регуляторные штрафы |

| Автономные решения | ИИ принимает решения без контроля | Аварии, ошибки в диагностике |

Проблема предвзятости (bias) в данных и моделях

Предвзятость — это не баг, а фича, которая достается нам по наследству. Данные, которые мы собираем, уже содержат исторические предубеждения. Например, если вы обучаете модель найма на данных успешных сотрудников прошлых лет, она может «решить», что мужчины-программисты лучше, просто потому что их было больше. Это не злой умысел, это математика.

Важно: Даже нейтральные данные могут содержать исторические предубеждения — необходима активная проверка.

Источников bias несколько: данные (нерепрезентативная выборка), разметка (субъективность асессоров) и алгоритмы (неправильная функция потерь). Как с этим бороться? Во-первых, использовать метрики справедливости, такие как demographic parity (равная вероятность положительного исхода для всех групп) или equal opportunity (равная точность для всех групп). Во-вторых, применять инструменты обнаружения. Лично я рекомендую IBM AI Fairness 360 — он умеет не только детектить bias, но и смягчать его через reweighting или adversarial debiasing.

Источники предвзятости

- Смещение выборки: если в данных преобладает одна группа, модель будет на нее «заточена».

- Смещение разметки: субъективное мнение асессора может исказить истину.

- Алгоритмическое смещение: неправильный выбор функции потерь или метрики.

Метрики справедливости (demographic parity, equal opportunity)

Demographic parity требует, чтобы процент положительных решений был одинаков для всех групп. Equal opportunity — чтобы точность (TPR) была одинакова. Выбор метрики зависит от контекста. Например, в кредитовании лучше использовать equal opportunity, чтобы не отказывать добросовестным заемщикам из меньшинств.

Инструменты обнаружения: IBM AI Fairness 360, Google What-If Tool

Кроме AI Fairness 360, стоит посмотреть на Google What-If Tool. Он позволяет визуально исследовать поведение модели, менять признаки и смотреть, как меняется предсказание. Очень удобно для быстрого анализа.

Прозрачность и объяснимость (XAI)

Чем сложнее модель, тем меньше мы ей доверяем. Это парадокс: нейросеть с 99% accuracy может ошибаться в системных случаях, и мы об этом не узнаем. XAI (Explainable AI) решает эту проблему. Есть два популярных подхода: SHAP и LIME. SHAP вычисляет вклад каждого признака в предсказание, используя теорию игр. LIME аппроксимирует модель локально, чтобы понять, почему она приняла решение.

В медицине это критично: врач не доверится диагнозу, если не поймет, почему ИИ поставил «рак». В финансах — регулятор требует объяснить отказ в кредите. Без XAI вы не пройдете аудит.

SHAP для регрессии

SHAP дает глобальную и локальную интерпретацию. Например, вы можете увидеть, что для конкретного клиента решающим фактором отказа стал его возраст, а не кредитная история. Это позволяет оспорить решение или исправить модель.

LIME для классификации

LIME работает быстрее, но менее точен. Он хорош для быстрых экспериментов, когда нужно понять, почему модель отнесла текст к спаму.

Model Cards и Data Sheets

Документирование моделей — это стандарт, который продвигает Google. Model Cards — это паспорт модели, где описаны ее характеристики, ограничения, метрики на разных группах. Data Sheets — аналогично для данных. Это помогает командам не забыть, на чем обучалась модель, и избежать сюрпризов.

Этический кодекс разработчика ИИ

Не ждите, что компания примет кодекс сверху. Начните с себя. Принципы IEEE Ethically Aligned Design или Европейские этические рекомендации — хорошая база. Они включают уважение автономии человека, предотвращение вреда, справедливость и прозрачность. Внедрить их в команде можно через чек-листы на code review и обязательные проверки на bias перед релизом.

Принципы IEEE Ethically Aligned Design

IEEE Ethically Aligned Design — это документ, который описывает, как встраивать этику в разработку автономных систем. Он не обязателен, но задает тренд.

Европейские этические рекомендации

Европейская комиссия выпустила Ethics Guidelines for Trustworthy AI, где выделены семь требований: человеческий контроль, техническая надежность, конфиденциальность, прозрачность, разнообразие, экологическое благополучие и подотчетность.

Безопасность ИИ-систем: от уязвимостей до защиты

Безопасность ИИ — это не про установку антивируса. Это про то, что вашу модель можно обмануть, украсть или отравить. Я участвовал в red teaming-сессии для одного финтех-продукта, и мы смогли заставить модель кредитного скоринга одобрить заведомо плохого заемщика, просто добавив шум в один признак. Это страшно, но лечится.

| Тип атаки | Этап | Последствия |

|---|---|---|

| Poisoning (отравление) | Обучение | Модель учится на зараженных данных |

| Evasion (обход) | Инференс | Злоумышленник изменяет вход, чтобы обмануть модель |

| Extraction (извлечение) | Инференс | Кража модели через API |

| Inversion (инверсия) | Инференс | Восстановление приватных данных из модели |

Классификация угроз безопасности ИИ

Угрозы делятся по этапам жизненного цикла. На этапе сбора данных злоумышленник может подсунуть отравленные примеры (poisoning). На этапе обучения — внедрить бэкдор. На этапе инференса — обойти модель (evasion) или украсть ее (extraction). Каждая атака требует своего метода защиты.

Атаки на этапе обучения (poisoning)

Пример: вы собираете датасет для детекции спама. Злоумышленник добавляет в него письма, которые выглядят как спам, но содержат скрытый паттерн. Модель учится игнорировать этот паттерн, и потом злоумышленник использует его для массовой рассылки. Защита: валидация данных, использование аномалий-детекторов, федеративное обучение с проверкой градиентов.

Атаки на этапе инференса (evasion, extraction, inversion)

Evasion — это когда вы меняете пиксели на изображении, и модель вместо «стоп-знак» видит «ограничение скорости». Extraction — когда через API вы отправляете тысячи запросов и восстанавливаете веса модели. Inversion — когда по выходу модели вы восстанавливаете приватные данные, например, лица людей из датасета. Защита: состязательное обучение, ограничение числа запросов, дифференциальная конфиденциальность.

Методы защиты моделей

Состязательное обучение (adversarial training) — это когда вы добавляете в обучающую выборку заведомо искаженные примеры, чтобы модель научилась их распознавать. Дифференциальная конфиденциальность (differential privacy) — это добавление шума в градиенты, чтобы нельзя было восстановить данные конкретного пользователя. Федеративное обучение (federated learning) — это когда модель обучается на устройствах пользователей, а не в центральном датацентре, что снижает риск утечки.

Adversarial training

Это базовый метод, который стоит внедрять всегда. Например, для модели классификации изображений вы генерируете состязательные примеры с помощью Fast Gradient Sign Method (FGSM) и добавляете их в тренировочный сет. Модель становится более робастной, но может немного потерять в accuracy на чистых данных.

Differential privacy

Если вы работаете с персональными данными (GDPR, CCPA), дифференциальная конфиденциальность — must have. Она гарантирует, что по выходу модели нельзя определить, был ли конкретный человек в обучающей выборке. Реализована в TensorFlow Privacy.

Federated learning

Это не только про конфиденциальность, но и про скорость. Вместо того чтобы собирать данные на сервер, вы отправляете модель на устройства, обучаете локально и агрегируете градиенты. Риск: атаки на градиенты (gradient leakage).

Безопасность данных и конфиденциальность

GDPR и CCPA — это не просто бюрократия. Это штрафы до 4% от оборота. В СНГ пока нет аналогов, но если вы работаете с европейскими пользователями, закон применяется. Техники: анонимизация (удаление идентификаторов) и псевдонимизация (замена на случайные идентификаторы). Гомоморфное шифрование позволяет вычислять на зашифрованных данных, но это пока медленно.

Анонимизация vs псевдонимизация

Анонимизация — это безвозвратное удаление идентификаторов. Псевдонимизация — замена на ключ, который можно восстановить. Для GDPR псевдонимизация не считается полной защитой, но снижает риски.

Гомоморфное шифрование

Технология, которая позволяет делать вычисления на зашифрованных данных, не расшифровывая их. Пока что это медленно и дорого, но для некоторых задач (например, медицинские данные) это единственный вариант.

Ограничения современных ИИ-систем

Самая опасная вещь в ИИ — это его переоценка. Многие думают, что нейросеть «понимает» текст или «видит» изображение. Нет, она просто находит корреляции. Я видел проекты, где модель отлично работала на тестовых данных, но в продакшне падала из-за дрейфа данных. Или где она «решала» задачу, но не могла объяснить, почему.

Переоценка возможностей ИИ — одна из главных причин провалов проектов.

Давайте честно признаем: ИИ не обладает здравым смыслом, не понимает причинно-следственные связи и может ошибаться на краевых случаях. Задача разработчика — не сделать ИИ всесильным, а правильно очертить его границы.

| Ограничение | Описание | Пример |

|---|---|---|

| Переобучение | Модель запоминает данные, а не учится | Высокая accuracy на train, низкая на test |

| Дрейф данных | Распределение данных меняется со временем | Модель прогноза погоды перестает работать после смены климата |

| Отсутствие причинности | Модель видит корреляцию, а не причину | ИИ «решает», что мороженое вызывает утопление, потому что оба растут летом |

| Чувствительность к шуму | Небольшие изменения входа сильно меняют выход | Один пиксель меняет классификацию |

Технические ограничения: переобучение, дрейф данных, нехватка данных

Переобучение — это классика. Модель выучила шум, а не сигнал. Борьба: регуляризация (L1, L2), dropout, early stopping. Дрейф данных — это когда модель училась на данных 2020 года, а сейчас 2024, и поведение пользователей изменилось. Мониторинг дрейфа — обязательная практика. Нехватка данных — это когда у вас мало примеров для обучения. Аугментация (искусственное увеличение выборки) или transfer learning (использование предобученной модели) помогают, но не всегда.

Переобучение и регуляризация

Регуляризация L1 (Lasso) и L2 (Ridge) добавляют штраф за большие веса. Dropout случайно отключает нейроны, заставляя модель учиться более робастно. Early stopping останавливает обучение, когда метрика на валидации перестает улучшаться.

Дрейф концепций и данных

Concept drift — это когда меняется само понятие (например, «спам» в 2020 и 2024 годах — это разные письма). Data drift — когда меняется распределение признаков (например, средний возраст пользователей вырос). Мониторинг через статистические тесты (KS-тест, PSI).

Проблема малых данных

Если у вас 100 примеров, никакая нейросеть не обучится. Используйте предобученные модели (BERT, ResNet) и fine-tuning. Или синтетические данные, но с осторожностью — они могут внести bias.

Когнитивные ограничения: отсутствие понимания контекста и причинности

Это самое сложное. ИИ не понимает, что такое «стул». Он просто видел много картинок со стульями и научился их распознавать. Но если стул будет сломан или необычной формы, модель может ошибиться. В NLP это еще заметнее: модель может написать связный текст, но не понимать, о чем говорит. Пример: GPT может сгенерировать рецепт, но не знает, как пахнет корица.

Проблема здравого смысла

Здравый смысл — это то, что ИИ не может выучить из данных. Он не знает, что если человек уронил стакан, он разобьется. Или что нельзя пить горячий чай через соломинку. Это ограничение не преодолено до сих пор.

Отсутствие причинно-следственных моделей

ИИ видит корреляцию, но не причину. Это приводит к парадоксам: модель может «решить», что наличие детей увеличивает риск ДТП, потому что водители с детьми чаще попадают в аварии (на самом деле они просто чаще ездят).

Как учитывать ограничения при проектировании систем

Самый надежный способ — human-in-the-loop. Человек проверяет решения модели в критических случаях. Graceful degradation — если модель не уверена, она должна сказать «не знаю», а не выдавать случайный ответ. Domain-specific validation — проверка выходов на соответствие предметной области. Например, если модель рекомендует лекарство, проверьте, что оно не взаимодействует с другими.

Human-in-the-loop

В медицине и финансах это стандарт. Модель предлагает, человек утверждает. Это снижает риск, но увеличивает время.

Graceful degradation

Если модель не может дать ответ с высокой уверенностью, она должна переключиться на резервный режим (например, вернуть дефолтное значение или запросить уточнение).

Domain-specific validation

Например, для модели, которая предсказывает цены на недвижимость, проверьте, что цена не отрицательная и не превышает разумный максимум.

Практические рекомендации по внедрению этики, безопасности и учету ограничений

Теория — это хорошо, но как это внедрить в реальную разработку? Я собрал чек-листы и инструменты, которые использую сам. Начните с малого: добавьте хотя бы базовые проверки на bias и безопасность на этапе CI/CD.

Совет: Начните с малого: внедрите хотя бы базовые проверки на bias и безопасность на этапе CI/CD.

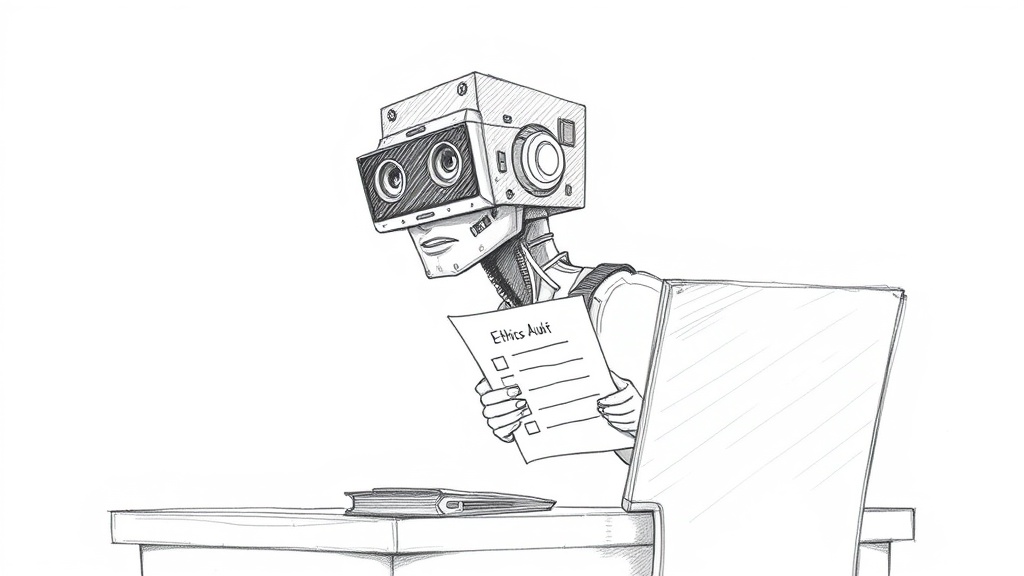

Чеклист для ответственной разработки ИИ

Этот чеклист можно использовать на каждом этапе. Он не гарантирует идеала, но снижает риски.

Этап данных

- Проверьте репрезентативность выборки (по полу, возрасту, региону).

- Удалите или анонимизируйте персональные данные.

- Проведите аудит на bias (используйте AI Fairness 360).

Этап моделирования

- Выберите метрики справедливости (demographic parity, equal opportunity).

- Используйте интерпретируемые модели или XAI (SHAP, LIME).

- Проверьте модель на состязательную устойчивость (Adversarial Robustness Toolbox).

Этап развертывания

- Внедрите мониторинг дрейфа данных и концепций.

- Настройте human-in-the-loop для критических решений.

- Проведите red teaming (имитация атак).

Этап эксплуатации

- Регулярно обновляйте модель на новых данных.

- Проводите аудит модели раз в квартал.

- Документируйте все инциденты и уроки.

Инструменты и фреймворки для аудита ИИ

Выбор инструмента зависит от вашего стека. Для Python-разработчиков — must have.

IBM AI Fairness 360

Библиотека для обнаружения и смягчения bias. Поддерживает reweighting, adversarial debiasing, и много метрик. Ссылка.

Adversarial Robustness Toolbox (ART)

Инструмент для тестирования моделей на состязательные атаки и защиты. Поддерживает TensorFlow, PyTorch, scikit-learn. Ссылка.

TensorFlow Privacy

Библиотека для дифференциальной конфиденциальности. Позволяет обучать модели с гарантиями приватности. Ссылка.

Интеграция в процессы разработки

Лучший способ — встроить проверки в MLOps pipeline. Например, на этапе CI/CD запускать тесты на bias и состязательную устойчивость. Red teaming — это отдельная практика, когда команда этичных хакеров пытается взломать модель. Этический комитет — это группа людей, которая рассматривает спорные случаи.

CI/CD для ML (MLOps)

Добавьте в пайплайн шаги: проверка качества данных, тестирование модели на bias, проверка на состязательную устойчивость. Если тесты не пройдены — модель не деплоится.

Red teaming

Проводите регулярные сессии, где команда пытается обмануть модель. Это помогает найти уязвимости до того, как их найдут злоумышленники.

Этический комитет

Если вы работаете в крупной компании, создайте комитет из юристов, разработчиков и представителей бизнеса. Они будут решать, что делать в спорных ситуациях.

Заключение: будущее ответственного ИИ

Мы стоим на пороге регуляторной волны. EU AI Act уже принят, и он будет влиять на всех, кто работает с европейскими пользователями. В СНГ тоже зреет понимание, что ИИ нужно контролировать. Но регуляция — это не ограничение, а возможность. Компании, которые уже сейчас внедряют ответственные практики, получат конкурентное преимущество.

Ответственный ИИ — не опция, а необходимость для устойчивого развития технологий.

Я призываю вас не откладывать. Начните с малого: добавьте проверку на bias в ваш пайплайн, протестируйте модель на состязательную устойчивость, задокументируйте ограничения. Это не займет много времени, но спасет от больших проблем. Помните: ИИ — это инструмент, а ответственность за него лежит на нас.

Ключевые выводы

- Этика должна быть встроена в процесс разработки с самого начала, а не добавлена в конце.

- Безопасность требует постоянного внимания: мониторинг, обновления, аудит.

- Ограничения нужно честно признавать и учитывать при проектировании систем.

Если вы хотите углубиться в тему, рекомендую почитать про ИИ-ассистенты Copilot: возможности, ограничения, внедрение | Обзор и ИИ-ассистенты Devin: как меняется разработка ПО. А для тех, кто хочет разобраться с инструментами — Windsurf: ИИ-ассистент для разработки кода — обзор и настройка.

Часто задаваемые вопросы

Что такое ответственный ИИ (Responsible AI)?

Это подход к разработке, который включает этичность, безопасность, прозрачность и подотчетность. Цель — минимизировать риски и создать доверие к системе.

Как обнаружить предвзятость в модели?

Используйте метрики справедливости (demographic parity, equal opportunity) и инструменты вроде IBM AI Fairness 360 или Google What-If Tool.

Какие основные угрозы безопасности ИИ?

Атаки на этапе обучения (poisoning), инференса (evasion, extraction, inversion) и утечка данных. Защита: состязательное обучение, дифференциальная конфиденциальность, мониторинг.

Почему ИИ не может объяснить свои решения?

Сложные модели (нейросети) — это черные ящики. XAI-методы (SHAP, LIME) помогают понять, почему модель приняла решение, но не всегда точно.

Какие регуляции влияют на разработку ИИ?

EU AI Act в Европе, GDPR для данных, CCPA в Калифорнии. В СНГ пока нет жестких законов, но тренд на регулирование растет.