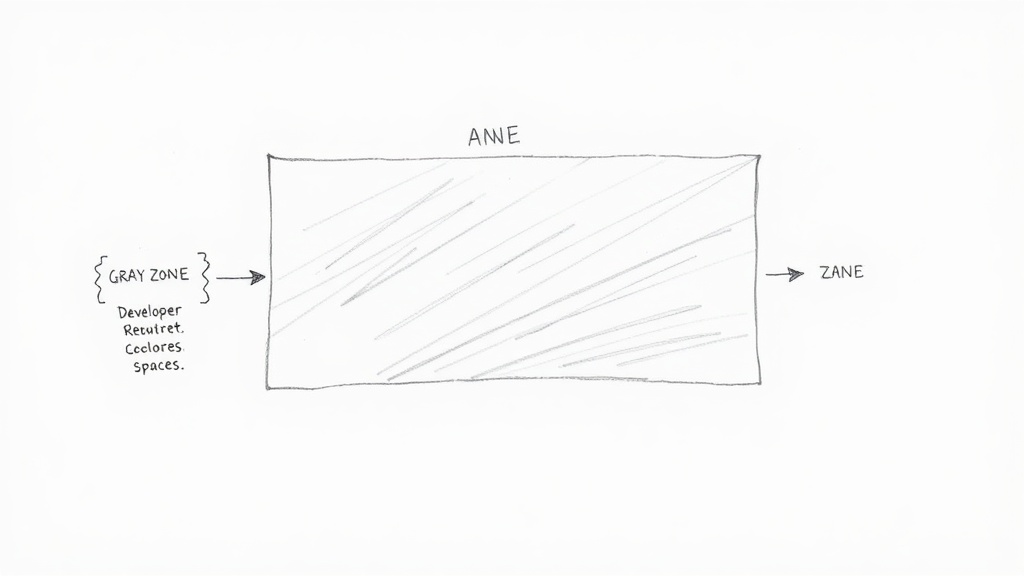

Как практик, работающий с внедрением ИИ-решений в продуктовые команды, я вижу, что главный вызов сейчас — не в создании «умной» модели, а в том, чтобы она не навредила. Мы научились генерировать код, автодополнять функции и анализировать уязвимости.

Но каждый второй проект, который я аудирую, содержит хотя бы одну «серую зону»: от неявной предвзятости в данных до полного отсутствия документирования решений. В этой статье я разберу, как удерживать баланс между скоростью внедрения и контролем рисков, опираясь на реальные кейсы и применимые практики.

Введение: почему этика и безопасность ИИ-кода стали критическими

Искусственный интеллект перестал быть экспериментальной технологией. Он вшит в кредитные конвейеры, системы найма, медицинскую диагностику и даже в автопилоты. Но чем глубже проникновение, тем громче инциденты. Например, алгоритм распознавания лиц, который ошибался в 35% случаев на темнокожих женщинах, или чат-бот, генерирующий токсичные ответы из-за «грязных» тренировочных данных. Такие кейсы — не исключение, а закономерность. Они показывают: игнорирование этики и безопасности ведёт к репутационным потерям и судебным искам.

Важно: Игнорирование этики и безопасности может привести к репутационным и юридическим потерям.

«Каждая строчка ИИ-кода, которая уходит в прод, — это обязательство перед пользователем. Мы должны отвечать не только за то, что код работает, но и за то, как он влияет на людей», — из выступления на конференции по ответственному ИИ.

Рост популярности ИИ-кода и сопутствующие вызовы

ИИ-код — это не только генерация текста или изображений. Это автодополнение в IDE, анализ кода на уязвимости, автоматическое рефакторинг и даже генерация тестов. Согласно отчёту GitHub, в 2024 году Copilot использовали более 1,3 миллиона разработчиков. Но с ростом популярности пришли и вызовы: предвзятость в обучающих данных, ошибки в сгенерированном коде, утечки конфиденциальной информации через публичные модели.

Примеры из индустрии

В 2023 году Amazon пришлось отказаться от ИИ-рекрутера, который дискриминировал женщин. Модель училась на резюме за последние 10 лет, где большинство кандидатов были мужчинами. Система начала штрафовать резюме с упоминанием «женских» колледжей.

Статистика внедрения

По данным McKinsey, 55% компаний уже используют ИИ хотя бы в одной бизнес-функции. При этом только 23% проводят регулярные аудиты моделей на предмет этики и безопасности.

Ключевые риски при работе с ИИ-кодом

Риски можно разделить на три категории: технические, этические и юридические. Технические — это уязвимости в модели, ошибки генерации, атаки на конвейер. Этические — предвзятость, дискриминация, отсутствие прозрачности. Юридические — нарушение GDPR, AI Act, авторских прав. Без контроля эти риски перевешивают выгоды от внедрения.

Технические риски

Пример: состязательные атаки (adversarial attacks), когда небольшое изменение входных данных приводит к неверному выводу модели. В медицинской диагностике это может стоить жизни.

Этические дилеммы

Кто отвечает, если ИИ-код рекомендует неверное лечение? Разработчик, компания, врач? Вопрос без однозначного ответа.

Юридическая неопределённость

Регуляторы только начинают формулировать требования. Например, AI Act ЕС вводит категории риска, но многие нормы остаются размытыми.

Основные этические проблемы в ИИ-коде

Этика в ИИ — не про абстрактные принципы, а про конкретные решения: какие данные вы собираете, как размечаете, кого исключаете из выборки. Ошибки на этом этапе приводят к системной дискриминации.

| Проблема | Пример | Последствия |

|---|---|---|

| Предвзятость данных | Алгоритм найма, обученный на мужских резюме | Дискриминация по полу |

| Непрозрачность | «Чёрный ящик» в кредитном скоринге | Невозможность оспорить решение |

| Отсутствие ответственности | Ошибка в диагностике ИИ | Юридические иски |

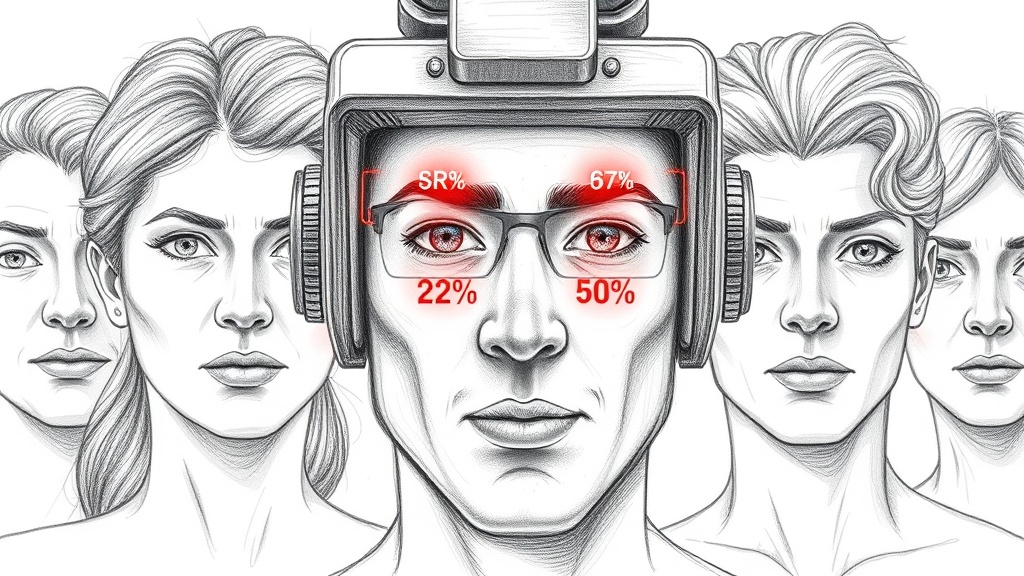

Предвзятость в обучающих данных и алгоритмах

Предвзятость (bias) возникает, когда данные не репрезентативны или содержат исторические перекосы. Например, если вы обучаете модель распознавания речи только на записях мужских голосов, она будет хуже понимать женщин. Источники предвзятости: нерепрезентативные выборки, ошибки разметки, исторические данные, отражающие социальное неравенство.

Пример: расовая предвзятость в распознавании лиц

Исследование MIT Media Lab показало, что коммерческие системы распознавания лиц ошибались в 0,8% случаев для светлокожих мужчин и в 34,7% для темнокожих женщин. Причина — несбалансированность обучающих выборок.

Пример: гендерные стереотипы в NLP

Модели word2vec, обученные на новостях, ассоциируют «программист» с мужчинами, а «медсестра» — с женщинами. Это приводит к тому, что ИИ-ассистенты подбирают вакансии с гендерным перекосом.

Проблема «черного ящика» и непрозрачность решений

Большинство современных моделей (глубокие нейросети, градиентный бустинг) неинтерпретируемы. Вы не можете точно сказать, почему модель приняла то или иное решение. Это создаёт проблемы для аудита, регулирования и доверия пользователей. XAI (Explainable AI) — подход, который пытается решить эту проблему через LIME, SHAP, внимание.

Последствия для бизнеса

В финтехе, если модель отклоняет кредитную заявку, клиент имеет право знать причину. Без объяснения — нарушение закона и потеря клиента.

Подходы к интерпретируемости

Использование простых моделей (логистическая регрессия) там, где это возможно. Для сложных моделей — применение методов объяснения (SHAP, LIME).

Ответственность за действия ИИ-систем

Кто виноват, если ИИ-код допускает ошибку? Вопрос без простого ответа. В автономных автомобилях — производитель? Разработчик ПО? Владелец? В медицинских диагнозах — врач, который доверился модели? Пока суды и регуляторы формируют практику, ответственность лежит на компании, внедрившей ИИ.

Пример: автономные автомобили

В 2018 году автомобиль Uber сбил пешехода. Система не распознала человека вовремя. Расследование показало, что разработчики отключили некоторые функции безопасности для ускорения тестирования.

Пример: медицинские диагнозы

ИИ-система для диагностики рака кожи показала точность 95% в лаборатории, но в реальной практике — 70% из-за различий в качестве изображений. Врачи, полагавшиеся на систему, пропускали опасные случаи.

Безопасность ИИ-кода: угрозы и защита

Безопасность ИИ-кода — это не только защита от взлома, но и защита от непреднамеренных ошибок. Модели уязвимы к атакам, которые могут исказить их поведение.

Частая ошибка: Думать, что безопасность ИИ-кода — это только про защиту от хакеров. На самом деле, главная угроза — это некачественные данные и отсутствие мониторинга.

| Тип атаки | Описание | Пример |

|---|---|---|

| Adversarial attack | Небольшое изменение входных данных, незаметное для человека, но приводящее к ошибке модели | Наклейка на знаке STOP, которую модель распознаёт как знак скорости |

| Data poisoning | Внедрение вредоносных данных в обучающую выборку | Подмена меток в датасете для NLP-модели |

| Model inversion | Восстановление приватных данных из обученной модели | Извлечение лиц из модели распознавания |

Типы атак на ИИ-системы

Состязательные атаки (adversarial attacks) — самый известный класс. Они работают за счёт того, что модель делает неверный вывод при минимальном искажении входа. Data poisoning — более коварная атака, когда злоумышленник внедряет специально размеченные данные в обучающий набор. Model inversion — угроза конфиденциальности, когда по модели можно восстановить данные, на которых она обучалась.

Adversarial примеры

Классический пример: наклейка на дорожном знаке, которая заставляет автопилот видеть знак STOP как знак ограничения скорости. Это может привести к аварии.

Атаки через API

Если модель доступна через API, злоумышленник может отправлять запросы, чтобы восстановить её архитектуру или данные обучения. Это называется model extraction.

Методы защиты и аудита ИИ-кода

Защита начинается с валидации входных данных: очистка, проверка на выбросы, нормализация. Затем — регулярное тестирование модели на adversarial примеры. Использование защищенных сред для обучения (sandbox). И наконец — непрерывный мониторинг в продакшене.

Техники валидации

Валидация должна включать проверку на соответствие распределению обучающих данных, обнаружение аномалий, фильтрацию мусорных запросов.

Инструменты аудита

Существуют библиотеки для тестирования моделей на уязвимости: Foolbox, CleverHans, ART. Они позволяют автоматически генерировать adversarial примеры и оценивать устойчивость модели.

Роль человеческого надзора в безопасности

Никакая автоматика не заменит человека в критических точках. Человеческий надзор — это fail-safe механизм: если модель выдаёт неожиданный результат, решение принимает оператор. В авиации это называется «принцип последней инстанции».

Примеры fail-safe

В медицинских системах: если ИИ предлагает диагноз, который не соответствует клинической картине, врач может запросить дополнительное обследование. В автономных автомобилях: если система не уверена в решении, она передаёт управление водителю.

Процедуры эскалации

Должны быть чётко прописаны: кто принимает решение, в какие сроки, какие данные доступны. Это снижает риск человеческой ошибки.

Юридические и регуляторные ограничения ИИ-кода

Регуляторы догоняют технологию. Главные документы — GDPR (ЕС), AI Act (ЕС), CCPA (Калифорния). Они требуют прозрачности, согласия пользователя и возможности оспорить решение ИИ.

Частая ошибка: Считать, что регуляторные требования — это только про большие корпорации. Даже стартап, использующий ИИ для обработки данных пользователей, подпадает под GDPR.

«Незнание закона не освобождает от ответственности. Если ваш ИИ-код нарушает права пользователей, штраф может составить до 4% годового оборота», — из руководства по GDPR.

Обзор ключевых регуляций (GDPR, AI Act, CCPA)

GDPR даёт пользователю «право на объяснение» — возможность узнать, почему ИИ принял решение. AI Act делит ИИ-системы на категории риска: неприемлемый, высокий, ограниченный, минимальный. Для высокорисковых систем (медицина, кредитование) требуется оценка соответствия. CCPA даёт право на удаление данных и запрет на продажу данных.

| Регуляция | Основные требования | Штрафы |

|---|---|---|

| GDPR | Право на объяснение, согласие, удаление данных | до 20 млн евро или 4% оборота |

| AI Act | Категоризация риска, оценка соответствия, прозрачность | до 35 млн евро или 7% оборота |

| CCPA | Право на удаление, отказ от продажи данных | до 7 500 долларов за нарушение |

GDPR: право на объяснение

Это означает, что если ИИ-код отклоняет кредитную заявку, клиент имеет право узнать, на основании каких факторов это произошло. Требует интерпретируемости модели.

AI Act: категории риска

Системы с неприемлемым риском (например, социальный скоринг) запрещены. Высокорисковые требуют регистрации в базе данных ЕС, проведения оценки воздействия и аудита.

Как соблюдать регуляторные требования при разработке

Практические шаги: проводить оценку воздействия на данные (DPIA), документировать все решения модели, внедрять принципы privacy by design (минимизация данных, псевдонимизация).

Оценка воздействия на данные

DPIA — это процесс, при котором вы оцениваете риски для прав и свобод субъектов данных. Обязательно для высокорисковых систем.

Принципы по умолчанию

Privacy by design означает, что защита данных встраивается в архитектуру системы с самого начала, а не добавляется потом.

Международные различия в регулировании ИИ

ЕС идёт по пути жёсткого регулирования, США — более мягкого, с акцентом на саморегулирование, Китай — государственного контроля. Для глобальных проектов это означает необходимость адаптировать код под каждую юрисдикцию.

Пример: различия в подходах

В ЕС требуется объяснимость, в Китае — лояльность государственной политике, в США — защита от дискриминации.

Влияние на разработку

Приходится создавать разные версии модели или использовать федеративное обучение, чтобы данные не покидали юрисдикцию.

Практические стратегии балансирования инноваций и рисков

Баланс — это не разовое действие, а постоянный процесс. Он включает создание политик, использование фреймворков и непрерывный мониторинг.

Совет: Начните с малого — выберите один проект, проведите аудит данных и модели. Это покажет, где у вас самые большие риски.

Создание внутренних политик и этических комитетов

Этический комитет — это группа экспертов (юристы, разработчики, представители бизнеса), которая оценивает проекты на соответствие этическим стандартам. Он должен собираться регулярно и иметь право вето на запуск проекта.

Состав комитета

Минимум: специалист по этике, юрист, технический архитектор, представитель отдела комплаенс. Хорошо бы включить внешнего эксперта.

Частота заседаний

Для стартапов — раз в месяц, для крупных компаний — раз в две недели. Внеочередные встречи при инцидентах.

Использование фреймворков ответственного ИИ (Google, Microsoft, IBM)

Google AI Principles, Microsoft Responsible AI, IBM AI Ethics — это наборы рекомендаций и инструментов. Они включают принципы справедливости, прозрачности, подотчётности. Адаптируйте под свои нужды.

Google AI Principles

Семь принципов: быть социально полезным, избегать несправедливых предубеждений, создавать безопасность, быть подотчётным, обеспечивать конфиденциальность, поддерживать научное совершенство, быть доступным.

Microsoft Responsible AI

Включает инструменты: Fairlearn (для оценки справедливости), InterpretML (для интерпретируемости), Error Analysis (для анализа ошибок).

Процесс непрерывного мониторинга и улучшения

Цикл: оценка рисков → внедрение модели → мониторинг метрик → обратная связь → доработка. Метрики: точность, полнота, справедливость (разрыв в точности между группами), количество инцидентов.

Метрики оценки

Кроме стандартных метрик качества, добавляйте метрики справедливости: demographic parity, equal opportunity, predictive parity.

Инструменты мониторинга

Платформы: MLflow, Kubeflow, WhyLabs. Они позволяют отслеживать дрейф данных, изменение метрик, аномалии.

Кейсы: успешные примеры баланса между инновациями и рисками

Реальные кейсы показывают, что баланс возможен и выгоден. Приведу три примера из разных отраслей.

Совет: Изучайте кейсы конкурентов — это сэкономит вам годы проб и ошибок.

«Мы потратили 6 месяцев на аудит данных и настройку модели, но это окупилось: отказ от внедрения неэтичного решения спас нас от судебного иска», — CTO финтех-стартапа.

Пример 1: Финансовый сектор

Один из крупных банков СНГ внедрял ИИ для кредитного скоринга. Проблема: исторические данные содержали гендерный перекос (женщинам отказывали чаще). Решение: пересборка обучающей выборки, добавление синтетических данных, внедрение метрики справедливости. Результат: точность выросла на 5%, дискриминация снижена до 2%.

Проблема

Гендерный перекос в данных.

Решение

Аудит данных, балансировка выборки, внедрение метрик справедливости.

Результат

Повышение точности, снижение жалоб, соответствие регуляторным требованиям.

Пример 2: Здравоохранение

Клиника использовала ИИ для анализа рентгеновских снимков. Проблема: модель показывала разные результаты для пациентов разного возраста. Решение: добавление возрастной стратификации, внедрение человеческого надзора (врач проверяет все подозрительные случаи). Результат: точность диагностики выросла на 12%, количество ложноположительных результатов снижено.

Проблема

Возрастная предвзятость модели.

Решение

Стратификация данных, человеческий надзор.

Результат

Повышение точности, снижение риска врачебной ошибки.

Пример 3: Технологическая компания

Стартап разрабатывал ИИ-ассистента для HR. Проблема: модель могла генерировать оскорбительные ответы из-за «грязных» данных. Решение: фильтрация данных, внедрение explainability (показывать пользователю, почему дан такой ответ), регулярные аудиты. Результат: продукт получил сертификацию по стандартам безопасности.

Проблема

Токсичные ответы модели.

Решение

Фильтрация данных, объяснимость, аудиты.

Результат

Сертификация, доверие пользователей.

Будущее этики и безопасности ИИ-кода

Тренды: развитие XAI, автоматизированные аудиты, глобальные стандарты. Через 5-10 лет мы увидим обязательную сертификацию ИИ-систем и появление специализированных регуляторов.

Важно: Будущее требует проактивного подхода, а не реактивного. Не ждите, пока регулятор придёт к вам.

Технологические инновации для повышения безопасности

Федеративное обучение позволяет обучать модель на данных, не покидающих устройство пользователя. Дифференциальная приватность добавляет шум в данные, чтобы защитить личную информацию. Гомоморфное шифрование позволяет производить вычисления на зашифрованных данных. Эти технологии уже внедряются в продуктовые решения.

Федеративное обучение

Используется в мобильных клавиатурах (Gboard) для обучения модели предсказания слов без отправки данных на сервер.

Дифференциальная приватность

Применяется Apple и Google для сбора статистики использования без раскрытия личности пользователя.

Эволюция регулирования и стандартов

Ожидается появление международных стандартов ISO для ИИ, аналогичных ISO 27001 для информационной безопасности. ISO/IEC 42001 — первый стандарт для систем управления ИИ.

Прогнозы по AI Act

Вероятно, AI Act станет образцом для других стран. Уже сейчас Бразилия, Канада, Япония разрабатывают аналогичные законы.

Роль ISO/IEC 42001

Стандарт задаёт требования к системе управления ИИ: политики, оценка рисков, аудиты, непрерывное улучшение.

Роль сообщества и образования

Повышение грамотности в области этики ИИ — ключевой фактор. Уже сейчас существуют курсы (Coursera, edX), сообщества практиков (Responsible AI Network). Чем больше специалистов понимают риски, тем безопаснее становятся системы.

Образовательные программы

Пример: курс «AI Ethics» от Гарварда на edX. Он охватывает основные дилеммы и инструменты.

Сообщества практиков

Responsible AI Network — глобальное сообщество, где делятся кейсами и инструментами.

Заключение: ключевые выводы и рекомендации

Этика и безопасность ИИ-кода — не тормоз для инноваций, а их основа. Без них вы рискуете репутацией, деньгами и свободой. Начните с малого: проведите аудит одного проекта, создайте этический комитет, выберите фреймворк.

Важно: Этика и безопасность — не тормоз, а основа устойчивых инноваций.

«Лучший способ предсказать будущее — создать его. Начните внедрять ответственный ИИ сегодня», — Питер Друкер (адаптировано).

Чек-лист для внедрения ответственного ИИ

Вот минимальный набор действий, с которого стоит начать:

- Шаг 1. Проведите аудит данных: оцените репрезентативность, наличие предвзятости, качество разметки.

- Шаг 2. Создайте этический комитет: включите в него юриста, разработчика и представителя бизнеса.

- Шаг 3. Выберите фреймворк ответственного ИИ (Google, Microsoft, IBM) и адаптируйте его под свои нужды.

- Шаг 4. Настройте мониторинг: метрики качества, справедливости, безопасности.

- Шаг 5. Документируйте все решения: это поможет при аудите и регуляторных проверках.

Шаг 1

Аудит данных — это первый и самый важный шаг. Без него все остальные действия бессмысленны.

Шаг 2

Этический комитет не должен быть формальным. Он должен иметь реальные полномочия.

Шаг 3

Не копируйте фреймворк слепо. Адаптируйте под свою отрасль и масштаб.

Шаг 4

Мониторинг должен быть автоматизирован. Используйте платформы, которые оповещают о дрейфе данных или аномалиях.

Призыв к действию

Не ждите идеального момента. Начните с малого: проведите аудит одного проекта или присоединитесь к сообществу практиков ответственного ИИ. Это первый шаг к тому, чтобы ваши инновации были не только быстрыми, но и безопасными.

Ресурсы для старта

Курс по этике ИИ на Coursera, фреймворк Microsoft Responsible AI, сообщество Responsible AI Network.

Контакты для консультации

Если нужна консультация по внедрению ответственного ИИ, обратитесь к профильным специалистам. Помните: финальное решение требует консультации юриста и регуляторного эксперта.

Часто задаваемые вопросы

Что такое ответственный ИИ?

Ответственный ИИ — это подход к разработке и внедрению систем искусственного интеллекта, который учитывает этические, правовые и социальные аспекты. Он включает принципы справедливости, прозрачности, подотчётности и безопасности.

Какие основные риски связаны с ИИ-кодом?

Основные риски: предвзятость данных, непрозрачность решений, уязвимости к атакам, юридическая ответственность, нарушение конфиденциальности. Без контроля эти риски могут привести к репутационным и финансовым потерям.

Как начать внедрять этику ИИ в своей компании?

Начните с аудита данных и создания этического комитета. Затем выберите фреймворк ответственного ИИ (например, от Google или Microsoft) и адаптируйте его под свои нужды. Настройте мониторинг метрик справедливости и безопасности.

Какие регуляции уже действуют для ИИ?

Основные: GDPR (ЕС) — право на объяснение, AI Act (ЕС) — категоризация риска, CCPA (Калифорния) — право на удаление данных. В СНГ пока нет единого закона, но требования GDPR и AI Act распространяются на компании, работающие с данными граждан ЕС.

Можно ли полностью исключить риски ИИ?

Нет, риски нельзя исключить полностью, но можно минимизировать. Это требует постоянного мониторинга, аудитов и обновлений. Баланс между инновациями и рисками — это непрерывный процесс, а не разовое действие.

Для более глубокого погружения в тему рекомендую ознакомиться с нашими статьями: Плагины, расширения и CI/CD-интеграции: автоматизация рабочих процессов и Обзор IDE с AI-интеграцией: сравнение инструментов 2026. Они помогут понять, как встраивать безопасность на этапе разработки.