Как практик, который последние несколько лет занимается внедрением ИИ-решений в продуктовые команды (от финтеха до логистики), я вижу одну и ту же картину: восторг от первых результатов быстро сменяется головной болью, когда модель начинает принимать спорные решения, а безопасность кода даёт течь.

В этой статье я разберу три ключевых блока — этику, безопасность и ограничения ИИ-кода — и покажу, как с ними работать на практике, не скатываясь в панику или отрицание.

Введение: почему этика и безопасность ИИ-кода стали критическими

Мы живём в мире, где ИИ-системы уже принимают решения в здравоохранении, юриспруденции, финансах — цена ошибки может быть очень высока. Инциденты, такие как скандалы с предвзятостью алгоритмов найма или атаки на автопилоты, перестали быть экзотикой. Параллельно растёт регуляторное давление: GDPR в Европе, AI Act, а в СНГ — точечные инициативы по контролю за алгоритмическими решениями. Код не нейтрален. Он несёт риски, которые разработчики часто игнорируют до первого сбоя.

ИИ-системы уже принимают решения в здравоохранении, юриспруденции, финансах — цена ошибки может быть очень высока.

Эволюция ИИ: от игрушки до инструмента влияния

Путь от экспертных систем 80-х до современных генеративных моделей — это не только рост производительности, но и смена характера угроз. Если раньше ошибка означала неправильный диагноз в узкой области, то сегодня — массовую дискриминацию или утечку приватных данных.

Этап 1: логические системы

Правила, заданные человеком. Проблемы — в неполноте базы знаний, но предсказуемость высокая. Этика сводилась к корректности правил.

Этап 2: машинное обучение

Модели учатся на данных. Появляется предвзятость, скрытая в выборке. Безопасность — пока на уровне традиционного ПО.

Этап 3: глубокое обучение и большие языковые модели

Чёрные ящики с миллиардами параметров. Невозможность полного аудита. Состязательные атаки, инверсия модели, отравление данных — новый класс угроз.

Статистика и тренды: как часто ИИ-системы дают сбой

Точной статистики по всем инцидентам нет, но исследования показывают тревожные сигналы. Например, исследование MIT Media Lab выявило, что системы распознавания лиц от ведущих вендоров ошибаются на тёмнокожих женщинах в 35% случаев против 0.8% у светлокожих мужчин. А OWASP ML Top 10 фиксирует, что атаки на пайплайны машинного обучения стали стандартным вектором в пентестах. Проблема масштабируется вместе с внедрением.

Этика ИИ-кода: как алгоритмы становятся несправедливыми

Этика в ИИ — это не абстрактная философия, а конкретные риски: репутационные, юридические, финансовые. Предвзятость может быть заложена на любом этапе — от сбора данных до выбора метрики.

Важно: даже если данные нейтральны, алгоритм может научиться дискриминации через корреляции. Например, модель найма может «выучить», что мужчины чаще получают повышение, и начать отсеивать женщин, даже если пол не указан явно.

Источники предвзятости: от данных до метрик

Разберём три основных типа смещения, с которыми я сталкивался в проектах.

Смещение в данных: нерепрезентативная выборка

Классика: если обучать модель распознавания лиц на фотографиях белых мужчин, она будет хуже работать на других группах. В одном из проектов по кредитному скорингу мы обнаружили, что данные по историческим выдачам были смещены в сторону одного региона, что приводило к завышению рисков для заёмщиков из других областей.

Смещение в метках: субъективность разметки

Разметчики могут вносить свои предубеждения. Например, при разметке тональности отзывов сотрудники одной команды оценивали негативные комментарии о начальстве как «нейтральные», боясь последствий.

Смещение в метриках: оптимизация не той цели

Выбор метрики — это этическое решение. Если модель оптимизирует точность (accuracy) на несбалансированных данных, она может просто игнорировать редкий класс (например, мошеннические транзакции).

Кейсы: когда ИИ ошибся в выборе

Реальные примеры, которые стали учебниками.

Система COMPAS и расовая предвзятость

Алгоритм оценки риска рецидивизма в США показывал, что темнокожие подсудимые имеют более высокий риск повторного преступления, даже при контроле других факторов. Расследование ProPublica показало, что модель ошибалась в 2 раза чаще для афроамериканцев.

Алгоритм найма Amazon: дискриминация женщин

Amazon разрабатывал систему для скрининга резюме, но она научилась штрафовать кандидаток, потому что исторически в технических должностях преобладали мужчины. Проект закрыли.

Распознавание лиц и ошибки идентификации

Полицейские системы неоднократно ошибочно идентифицировали людей, что приводило к ложным арестам. Проблема усугубляется, если модель обучалась на несбалансированных данных.

Ответственность и прозрачность: кто в ответе за решения ИИ

Ключевой вопрос: если модель ошиблась, кто виноват — разработчик, владелец данных или бизнес? Ответ зависит от юрисдикции, но тренд на подотчётность очевиден.

XAI: как сделать модель понятной

Объяснимый ИИ (XAI) — набор методов, позволяющих интерпретировать решения модели. Например, LIME или SHAP показывают, какие признаки повлияли на вывод. Без XAI невозможно пройти аудит.

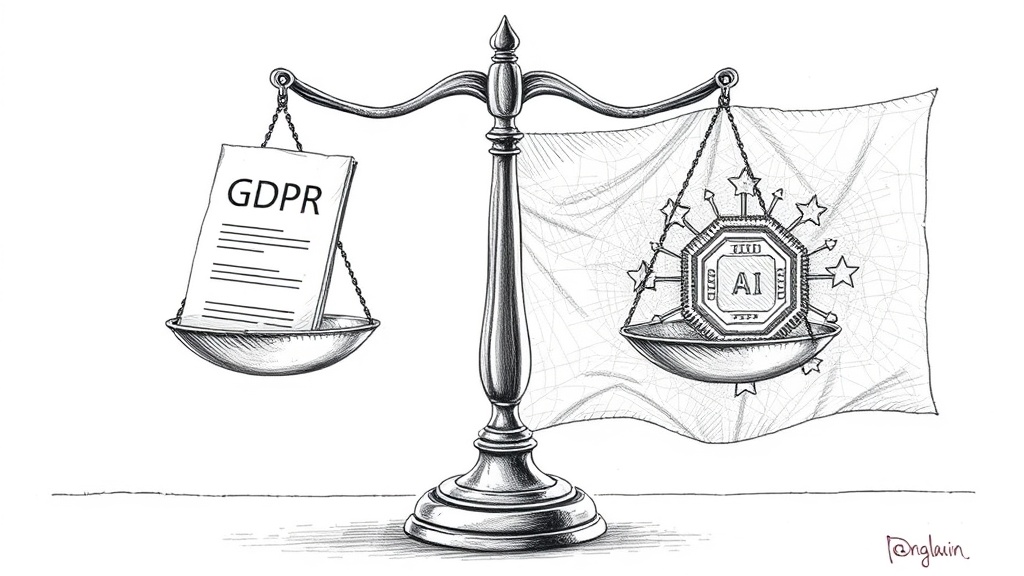

Юридические аспекты: GDPR и AI Act

GDPR даёт право на объяснение автоматизированных решений. AI Act в Европе классифицирует системы по уровню риска и требует прозрачности для высокорисковых. В СНГ пока нет аналогов, но импортные регуляции влияют на компании, работающие с ЕС.

Этический комитет в компании

Создание внутреннего комитета, который рецензирует модели перед запуском, — практика, которую я рекомендую всем, кто работает с чувствительными данными. Это не бюрократия, а защита от репутационных потерь.

Безопасность ИИ-кода: уязвимости и атаки на модели

Переходим к техническим угрозам. ИИ-код уязвим так же, как и обычный, но атаки специфичны: они эксплуатируют математическую природу моделей.

Частая ошибка: Многие атаки на ИИ незаметны для человека — модель может давать неверный ответ с высокой уверенностью. Вы не увидите разницы, а модель уже скомпрометирована.

Состязательные атаки: как обмануть нейросеть

Состязательные примеры — это малые возмущения во входных данных, незаметные для человека, но меняющие вывод модели. Классика: наклейка на стоп-знаке заставляет автопилот видеть знак «уступи дорогу».

Пример с дорожным знаком

Исследователи из OpenAI показали, что добавление небольшого паттерна на изображение стоп-знака приводит к его ошибочной классификации. Для водителя знак остаётся красным, для модели — нет.

Атака на голосовые ассистенты

Можно добавить неслышимый шум к аудиосигналу, который заставит ассистента выполнить команду (например, «открой дверь»). Человек ничего не заметит.

Защита: adversarial training

Метод, при котором модель обучается на состязательных примерах, становясь устойчивее. Это увеличивает время обучения, но снижает риск.

Отравление данных и бэкдоры

Злоумышленник внедряет вредоносные примеры в обучающую выборку. Модель учится на ложных паттернах, которые активируются только при определённом триггере.

Сценарий атаки через краудсорсинг

Если вы собираете данные через краудсорсинговые платформы, злоумышленник может загрузить размеченные примеры с бэкдором. Например, все изображения с жёлтой точкой в углу классифицировать как «безопасные», независимо от содержимого.

Бэкдоры в моделях

После внедрения бэкдора модель работает нормально, пока не встретит триггер. Это сложно обнаружить без специального аудита.

Методы защиты: валидация данных, дифференциальная приватность

Регулярная валидация данных на аномалии, использование дифференциальной приватности при обучении, а также аудит модели на наличие бэкдоров с помощью тестовых триггеров.

Инверсия модели и утечка данных

Атаки, направленные на восстановление приватных данных из модели. Например, из модели распознавания лиц можно восстановить лица, которые использовались в обучении.

Атака с помощью запросов к API

Злоумышленник отправляет множество запросов к модели и по ответам восстанавливает распределение данных. Это особенно опасно для моделей, обученных на медицинских или финансовых данных.

Защита: дифференциальная приватность

Добавление шума в градиенты или выходы модели делает атаки инверсии менее эффективными. Но это снижает точность — trade-off, который нужно учитывать.

Пример: восстановление лиц из модели

Исследователи из статьи показали, как можно восстановить изображения лиц, используя только выходы модели. Это нарушает GDPR, если данные были приватными.

Ограничения ИИ-кода: что модели не могут (и не должны) делать

Пора снять розовые очки. ИИ — мощный инструмент, но с фундаментальными ограничениями, которые не исправить увеличением данных или вычислительных мощностей.

Важно: ИИ не понимает контекст, не обладает здравым смыслом и не может объяснить свои решения — это фундаментальные ограничения, а не баги.

Отсутствие понимания и здравого смысла

Модели работают на статистике, а не на логике. Они не понимают, что такое «лошадь» — они знают, что на изображении с высокой вероятностью присутствует объект, похожий на лошадь по пикселям.

Пример: «Сколько глаз у лошади?»

LLM может ответить «два», но если вы спросите «Сколько глаз у лошади, если она стоит боком?», модель может запутаться. Она не понимает физику мира.

Проблема «стеклянного шара»

Модели не могут предсказывать события, которых не было в обучающих данных. Это ограничение особенно критично в финансах и медицине.

Отличие от человеческого мышления

Человек использует абстракции и причинно-следственные связи. Модель — корреляции. Поэтому ИИ отлично справляется с распознаванием паттернов, но плохо — с задачами, требующими понимания.

Хрупкость и переобучение

Модели могут отлично работать на тренировочных данных, но падать на новых. Это называется переобучением или сдвигом распределения (distribution shift).

Переобучение: причины и признаки

Модель запоминает шум в данных, а не сигнал. Признак: высокая точность на train, низкая на validation.

Сдвиг распределения (distribution shift)

Данные в production отличаются от тех, на которых модель обучалась. Например, модель для распознавания котиков, обученная на фотографиях из Instagram, может не справиться с изображениями из старого фотоальбома.

Методы борьбы: регуляризация, аугментация

Регуляризация (L1, L2, dropout) снижает переобучение. Аугментация данных (повороты, шум, обрезка) делает модель устойчивее к сдвигам.

Зависимость от качества и объема данных

Garbage in, garbage out. Это аксиома, которую многие игнорируют.

Требования к размеру выборки

Для глубоких моделей нужны миллионы примеров. Для простых задач хватит тысяч, но качество данных важнее количества.

Проблема длинного хвоста

Редкие события (например, редкие болезни) плохо представлены в данных. Модель будет их игнорировать или ошибаться.

Синтетические данные: плюсы и минусы

Генерация синтетических данных может решить проблему дефицита, но они могут быть нереалистичными и внести дополнительное смещение.

Практические рекомендации: как создавать этичный и безопасный ИИ-код

Теперь — к действию. Вот чек-лист, который я использую в своих проектах.

Совет: Этика и безопасность — не разовые акции, а непрерывный процесс на всех этапах жизненного цикла ИИ.

Чек-лист для разработчика: от данных до деплоя

- Шаг 1: Аудит данных. Проверьте выборку на смещение: посмотрите распределение по группам, исключите явные корреляции с защищёнными признаками.

- Шаг 2: Выбор метрик справедливости. Используйте метрики, которые контролируют предвзятость: демографический паритет, равные возможности (equal opportunity).

- Шаг 3: Тестирование на состязательные примеры. Включите в пайплайн тесты с минимальными возмущениями.

- Шаг 4: Мониторинг дрейфа. В production отслеживайте распределение предсказаний и входных данных.

Инструменты и фреймворки для безопасного ИИ

На рынке есть готовые решения, которые не изобретают велосипед.

- AI Fairness 360 (IBM) — библиотека для обнаружения и смягчения предвзятости.

- What-If Tool (Google) — визуальный инструмент для анализа модели.

- Adversarial Robustness Toolbox (IBM) — для тестирования на состязательные атаки.

Культура ответственности: обучение команды и процессы

Без культуры все инструменты бесполезны.

- Этический чек-лист для каждого спринта. Включайте вопросы: «Может ли эта модель дискриминировать?», «Какие данные мы используем?».

- Роль этического комитета. Регулярные ревью моделей с участием юристов, продактов и инженеров.

- Обучение команды основам AI safety. Курсы, воркшопы, разбор кейсов.

Для более глубокого погружения в инструменты работы с ИИ-кодом рекомендую ознакомиться с материалом «Освоение Cursor и Claude: инструменты для работы с ИИ». А для понимания архитектурных аспектов — «MCP Server: архитектура, настройка и практическое применение».

Заключение: баланс между инновациями и ответственностью

Вызовы реальны, но преодолимы. Ключ — в проактивном подходе: закладывать этику и безопасность на этапе проектирования, а не после инцидента. Будущее ИИ зависит от нашей способности сегодня заложить этические и безопасные основы.

Будущее ИИ зависит от нашей способности сегодня заложить этические и безопасные основы.

Ключевые выводы статьи

- Этика требует внимания к данным, метрикам и процессам. Без этого — репутационные и юридические риски.

- Безопасность — непрерывный процесс: аудит, тестирование, мониторинг. Атаки на ИИ становятся всё изощрённее.

- Ограничения — не повод отказываться от ИИ, а повод использовать его там, где он действительно силён, и контролировать там, где слаб.

Взгляд в будущее: что нас ждет

- Регуляторные инициативы. AI Act в ЕС, аналоги в других странах. Компаниям придётся адаптироваться.

- Технологические прорывы в безопасности. Новые методы защиты от атак, более прозрачные модели.

- Роль сообщества. Открытые стандарты, такие как ISO/IEC 42001, помогут унифицировать практики.

Для автоматизации процессов и интеграций с ИИ-инструментами также стоит изучить «Плагины, расширения и CI/CD-интеграции: инструменты для автоматизации».

Часто задаваемые вопросы

Что такое предвзятость алгоритмов и как её обнаружить?

Предвзятость — это систематическая ошибка модели, которая приводит к несправедливым результатам для определённых групп. Обнаружить её можно с помощью аудита данных (проверка распределения по группам) и использования метрик справедливости (демографический паритет, равные возможности).

Какие атаки на ИИ-модели самые опасные?

Состязательные атаки (незаметные возмущения), отравление данных (внедрение бэкдоров) и инверсия модели (восстановление приватных данных). Каждая опасна по-своему: состязательные — для систем реального времени, отравление — для долгосрочной надёжности, инверсия — для конфиденциальности.

Может ли ИИ полностью заменить человека в принятии решений?

Нет, из-за фундаментальных ограничений: отсутствия понимания, здравого смысла и способности к абстракции. ИИ — инструмент для поддержки решений, а не замена.

Какие инструменты помогают обеспечить этичность ИИ?

AI Fairness 360 (IBM), What-If Tool (Google), Adversarial Robustness Toolbox (IBM). Они помогают обнаруживать предвзятость и тестировать безопасность.

Что такое XAI и зачем он нужен?

XAI (Explainable AI) — методы, которые делают решения модели понятными для человека. Это необходимо для аудита, соблюдения регуляций (GDPR) и доверия пользователей.