Сегодня системы искусственного интеллекта управляют автомобилями, ставят диагнозы, одобряют кредиты и даже пишут код. Но чем глубже ИИ проникает в критическую инфраструктуру, тем острее становится вопрос: насколько мы можем доверять алгоритмам?

В этой статье разберём, какие риски несут нейросети, как злоумышленники атакуют модели и — главное — как построить надёжную защиту. Материал будет полезен разработчикам, инженерам по безопасности, продакт-менеджерам и всем, кто отвечает за внедрение ИИ в бизнес-процессы.

Введение: почему безопасность алгоритмов ИИ — критическая проблема

За последние пять лет количество инцидентов, связанных с атаками на системы ИИ, выросло в разы. По оценкам экспертов, ущерб от таких атак уже исчисляется миллиардами долларов. И речь не только о деньгах: под угрозой оказываются жизни людей, когда атакуют беспилотные автомобили или медицинские диагностические системы.

Проблема усугубляется тем, что классические методы кибербезопасности часто не работают против атак на машинное обучение. Здесь нужны специализированные подходы, понимание того, как работают нейронные сети, и готовность внедрять защиту на всех этапах жизненного цикла модели.

Важно: безопасность алгоритмов — не только техническая, но и этическая и правовая задача. Игнорирование рисков может привести к судебным искам, штрафам и потере доверия клиентов.

Масштаб угроз: как атаки на ИИ влияют на бизнес и общество

Последствия атак на системы ИИ могут быть самыми разными — от финансовых потерь до физического вреда. Рассмотрим основные категории рисков.

Финансовые риски

Злоумышленники могут манипулировать алгоритмами, чтобы получить выгоду. Например, атака на модель ценообразования в интернет-магазине способна привести к убыткам в миллионы рублей. Или взлом кредитного скоринга — мошенники получают одобрение на заведомо невозвратные кредиты.

Репутационные риски

Если модель начинает выдавать предвзятые или оскорбительные результаты, это мгновенно становится публичным скандалом. Примеры дискриминации при найме или отказе в кредите уже были в новостях. Репутационный ущерб может быть необратимым.

Риски для безопасности жизни

Самый опасный сценарий — атака на системы, управляющие физическими процессами. Беспилотный автомобиль, который перестаёт распознавать знаки из-за состязательной атаки, или медицинский диагност, пропускающий опухоль — это уже не гипотетические угрозы, а documented кейсы.

Целевая аудитория статьи: кому нужно знать о безопасности ИИ

Тема безопасности алгоритмов касается многих специалистов. Разберём, кому и зачем это нужно.

Разработчики и Data Scientists

Вы создаёте модели и отвечаете за их корректную работу. Понимание рисков поможет закладывать защиту на этапе проектирования, а не исправлять уязвимости после атаки.

Специалисты по кибербезопасности

Классические методы защиты не всегда применимы к ML-системам. Вам нужно освоить новые инструменты и методологии — от adversarial training до мониторинга дрейфа данных.

Руководители и менеджеры

Вы принимаете решения о внедрении ИИ в бизнес-процессы. Без понимания рисков невозможно адекватно оценить бюджет на безопасность и выбрать правильную стратегию.

Регуляторы и юристы

Законодательство в сфере ИИ активно развивается. Чтобы соответствовать требованиям GDPR, AI Act и другим нормам, нужно разбираться в технических аспектах безопасности.

Типы рисков и угроз для систем искусственного интеллекта

Все угрозы для систем ИИ можно разделить на три большие категории: атаки на целостность, атаки на конфиденциальность и атаки на доступность. Кроме того, есть скрытые риски, связанные с предвзятостью алгоритмов. Понимание этих типов — первый шаг к построению защиты.

| Тип атаки | Цель | Пример |

|---|---|---|

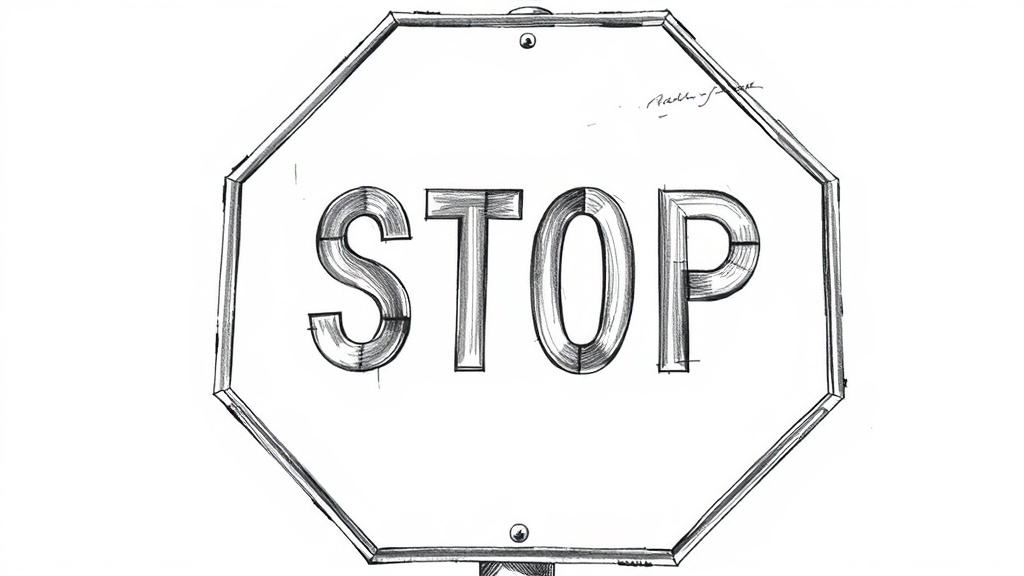

| Состязательные атаки | Заставить модель ошибиться | Наклейка на знак «Стоп» превращает его в «50 км/ч» |

| Атаки членства | Узнать, использовались ли данные конкретного человека | Восстановление медицинских записей из модели |

| Отравление данных | Внедрить вредоносные данные в обучающий набор | Подмена меток в тренировочном датасете |

| DoS-атаки | Перегрузить модель запросами | Массовый вызов API для замедления работы |

| Предвзятость | Дискриминация по признаку пола, расы и т.д. | Модель найма отказывает женщинам |

Атаки на целостность модели: состязательные атаки

Состязательные атаки — один из самых известных классов угроз. Суть в том, что злоумышленник вносит минимальные, незаметные для человека изменения во входные данные, чтобы модель приняла неверное решение.

Например, на изображение панды накладывается небольшой шум. Человек по-прежнему видит панду, а нейросеть с высокой уверенностью классифицирует объект как гиббона. Такие атаки особенно опасны для систем распознавания лиц, автономного вождения и диагностики.

Методы генерации состязательных примеров

Существует несколько алгоритмов создания состязательных примеров: Fast Gradient Sign Method (FGSM), Projected Gradient Descent (PGD), Carlini & Wagner. Все они основаны на вычислении градиента функции потерь по входным данным.

Защита: adversarial training, defensive distillation

Adversarial training — это обучение модели на состязательных примерах. Модель учится распознавать атаки и становится более устойчивой. Defensive distillation — техника, при которой модель обучается на «смягчённых» выходах другой модели, что делает её менее чувствительной к малым искажениям.

Атаки на конфиденциальность: извлечение данных и инверсия модели

Модели машинного обучения могут запоминать часть обучающих данных. Злоумышленники используют это для извлечения конфиденциальной информации.

Атака членства (membership inference)

Атакующий пытается определить, использовались ли данные конкретного человека для обучения модели. Например, по ответам модели можно понять, был ли пациент в обучающем наборе, что нарушает врачебную тайну.

Атака инверсии модели (model inversion)

Более опасная техника — восстановление исходных данных по выходам модели. В одном известном эксперименте исследователи восстановили фотографии лиц из модели распознавания, используя только её ответы.

Защита: дифференциальная приватность

Дифференциальная приватность — математический метод, который добавляет шум в процесс обучения. Это делает невозможным точное определение, участвовали ли конкретные данные в обучении. Подробнее о методах защиты данных мы поговорим в соответствующем разделе.

Атаки на доступность: отравление данных и denial of service

Эти атаки направлены на нарушение работы модели — либо на этапе обучения, либо в процессе эксплуатации.

Отравление данных (data poisoning)

Злоумышленник внедряет вредоносные примеры в обучающий набор. После обучения модель может вести себя непредсказуемо: например, открывать заднюю дверь для определённого триггера. Такие атаки особенно опасны, если данные собираются из ненадёжных источников.

DoS-атаки на API модели

Как и любые веб-сервисы, API моделей могут быть перегружены запросами. Если модель используется в реальном времени (например, для управления транспортом), DoS может привести к аварии.

Защита: валидация данных, rate limiting

На этапе обучения необходима тщательная валидация данных — проверка меток, поиск выбросов. Для production-среды — ограничение частоты запросов, фильтрация подозрительных входов.

Предвзятость и дискриминация как скрытые риски

Предвзятость алгоритмов — не всегда результат злого умысла. Часто модель просто отражает предубеждения, заложенные в обучающих данных. Но последствия могут быть катастрофическими: отказ в кредите по расовому признаку, несправедливые приговоры в судах.

Источники предвзятости

Дисбаланс классов, нерепрезентативная выборка, исторические предрассудки — всё это приводит к тому, что модель учится дискриминировать определённые группы.

Методы выявления и устранения предвзятости

Существуют инструменты для аудита моделей на предвзятость: AI Fairness 360 от IBM, What-If Tool от Google. Они позволяют оценить, как модель ведёт себя на разных подгруппах данных, и скорректировать обучение.

Регуляторные требования

Во многих юрисдикциях (например, в Европейском союзе) закон требует, чтобы алгоритмы, принимающие важные решения, были справедливыми и объяснимыми. Несоблюдение грозит крупными штрафами.

Совет: проводите аудит на предвзятость на ранних этапах разработки. Лучше потратить время на исправление данных, чем потом переделывать всю модель.

Методологии и фреймворки для обеспечения безопасности ИИ

Для систематизации работы с рисками разработаны специализированные фреймворки. Они помогают не упустить важные аспекты и соответствовать лучшим практикам.

| Фреймворк | Фокус | Ключевые этапы |

|---|---|---|

| NIST AI RMF | Управление рисками | Govern, Map, Measure, Manage |

| OWASP AI Security | Топ-10 угроз | Идентификация, оценка, mitigation |

| ISO/IEC 42001 | Система управления ИИ | Планирование, внедрение, аудит |

| IEEE 7010 | Этические аспекты | Прозрачность, подотчётность |

NIST AI Risk Management Framework

Национальный институт стандартов и технологий США (NIST) выпустил один из самых авторитетных фреймворков для управления рисками ИИ. Он состоит из четырёх функций.

Govern: управление рисками

Организация должна создать структуру управления рисками: назначить ответственных, определить политики, установить процедуры эскалации.

Map: картирование контекста

На этом этапе описывается система: её назначение, данные, окружение, заинтересованные стороны. Важно понять, какие риски могут возникнуть в конкретном контексте.

Measure: измерение рисков

Проводится количественная и качественная оценка рисков. Используются метрики: точность модели, устойчивость к атакам, уровень предвзятости.

Manage: управление рисками

На основе оценки принимаются меры: дообучение модели, внедрение защиты, мониторинг. Результаты документируются.

OWASP AI Security и другие отраслевые стандарты

OWASP (Open Web Application Security Project) известен своим топ-10 уязвимостей веб-приложений. Теперь они выпустили аналогичный список для ИИ.

OWASP AI Security Top 10

Список включает такие угрозы, как отравление данных, состязательные атаки, утечка модели, атаки на цепочку поставок. Каждая угроза описана с примерами и рекомендациями по защите.

ISO/IEC 42001: система управления ИИ

Это международный стандарт, который задаёт требования к системе управления ИИ в организации. Он охватывает все аспекты: от разработки до вывода из эксплуатации.

IEEE 7010: этические аспекты

Стандарт фокусируется на этических принципах: прозрачность, подотчётность, справедливость. Он помогает компаниям внедрить ответственный ИИ.

DevSecOps и MLSecOps: интеграция безопасности в жизненный цикл ИИ

Безопасность должна быть встроена в процесс разработки, а не быть отдельным этапом. Для ИИ это особенно важно, потому что модель может быть уязвима на любом этапе.

Безопасность на этапе разработки

Внедряйте code review для ML-кода, используйте статический анализ (SAST) для поиска уязвимостей в пайплайнах. Проверяйте данные на наличие вредоносных примеров.

Безопасность на этапе развертывания

Используйте контейнеризацию (Docker, Kubernetes) с ограниченными правами. Проводите тестирование на проникновение (penetration testing) для API модели.

Безопасность на этапе эксплуатации

Настройте мониторинг аномалий: резкое изменение метрик, необычные запросы. Реагируйте на инциденты по заранее утверждённому плану.

Подробнее о том, как автоматизировать тестирование и интегрировать безопасность в CI/CD, читайте в статье Автоматизация тестирования с помощью плагинов и CI/CD-интеграций.

Практические инструменты и техники защиты алгоритмов

Теперь перейдём к конкретным инструментам и методам, которые помогут защитить вашу ИИ-систему. Важно понимать: ни один инструмент не даёт 100% гарантии, только комплексный подход.

Adversarial training и defensive distillation

Эти методы направлены на повышение устойчивости модели к состязательным атакам.

Adversarial training: процесс и примеры

Суть проста: на каждом шаге обучения мы генерируем состязательные примеры и добавляем их в обучающий набор. Модель учится распознавать атаки и становится более робастной. Минус — обучение может замедлиться, а точность на чистых данных немного упасть.

Defensive distillation: принцип и реализация

Сначала обучается «учитель» — модель с высокой точностью. Затем её выходы сглаживаются (например, с помощью температуры softmax), и на этих сглаженных выходах обучается «студент». Студент менее чувствителен к малым искажениям.

Дифференциальная приватность и федеративное обучение

Эти техники защищают конфиденциальность данных.

Дифференциальная приватность: математическая основа

Идея в том, чтобы добавить шум в процесс обучения так, чтобы невозможно было определить, участвовал ли конкретный объект в обучении. Параметр ε (эпсилон) контролирует уровень приватности: чем меньше ε, тем сильнее защита.

Федеративное обучение: архитектура и безопасность

Федеративное обучение позволяет обучать модель на данных, которые не покидают устройство пользователя. На сервер отправляются только обновления весов, а не сами данные. Это снижает риск утечки, но требует дополнительных мер защиты от атак на агрегацию.

Мониторинг и обнаружение аномалий в работе модели

Даже самая защищённая модель может быть атакована. Мониторинг помогает вовремя обнаружить проблему.

Мониторинг дрейфа данных

Со временем распределение входных данных может измениться. Модель, обученная на старых данных, начинает ошибаться. Инструменты вроде Evidently AI позволяют отслеживать дрейф и сигнализировать о необходимости переобучения.

Мониторинг дрейфа концепций

Если меняется сама суть задачи (например, после пандемии изменилось поведение покупателей), модель перестаёт быть релевантной. Это сложнее обнаружить, но существуют методы на основе отслеживания метрик качества.

Обнаружение аномалий запросов

Злоумышленники часто отправляют необычные запросы, чтобы найти уязвимости. Система обнаружения аномалий (например, на основе Isolation Forest) может блокировать такие запросы до того, как они достигнут модели.

Шифрование моделей и безопасное хранение данных

Защита данных и моделей на уровне инфраструктуры.

Шифрование моделей

Модель можно зашифровать при хранении и передаче. Однако при выполнении вывода модель должна быть расшифрована, что создаёт окно уязвимости.

Trusted Execution Environments

TEE (например, Intel SGX) — это аппаратные изолированные области, где код и данные защищены даже от операционной системы. Модель выполняется внутри TEE, и злоумышленник не может получить к ней доступ.

Гомоморфное шифрование

Позволяет выполнять вычисления на зашифрованных данных без их расшифровки. Это идеально для конфиденциальности, но пока слишком медленно для production-нагрузок.

Частая ошибка: полагаться только на один метод защиты. Например, шифрование модели не защитит от состязательных атак. Используйте комбинацию техник.

Этические и правовые аспекты безопасности алгоритмов ИИ

Безопасность алгоритмов — это не только техническая задача. Этика и право играют ключевую роль.

Принципы ответственного ИИ

Ответственный ИИ строится на нескольких принципах.

Прозрачность алгоритмов

Пользователи должны понимать, как работает модель и на каких данных она обучена. Это особенно важно для систем, принимающих решения, влияющие на жизнь людей.

Объяснимость решений

Модель должна уметь объяснить, почему она приняла то или иное решение. Инструменты LIME, SHAP помогают интерпретировать предсказания.

Подотчётность разработчиков

Если модель ошиблась, должен быть понятен ответственный. Это требует документирования всех этапов разработки и развёртывания.

Регуляторные требования: GDPR, AI Act и другие

Законодательство в сфере ИИ активно развивается.

GDPR: права субъектов данных

GDPR требует, чтобы пользователи могли получить доступ к своим данным, требовать их удаления и знать, как они используются. Для ИИ это означает необходимость механизмов forget (забывание данных).

AI Act: классификация и требования

Европейский AI Act делит системы ИИ на категории риска: неприемлемый, высокий, ограниченный, минимальный. Для high-risk систем (медицина, транспорт, кредитование) предъявляются строгие требования: документирование, тестирование, человеческий контроль.

Региональные особенности регулирования

В Китае действуют свои законы об алгоритмах, в США — отраслевые стандарты. Компаниям, работающим глобально, нужно учитывать все юрисдикции.

Роль аудита и сертификации в обеспечении безопасности ИИ

Независимая проверка — важный элемент доверия.

Внутренний аудит

Регулярные проверки со стороны внутренней команды безопасности. Оценка модели на соответствие политикам и стандартам.

Независимая сертификация

Сертификация по стандартам ISO, IEEE или другим даёт внешнее подтверждение безопасности. Это особенно важно для B2B-продуктов.

Примеры сертификационных схем

Например, сертификация по ISO/IEC 42001 подтверждает, что организация внедрила систему управления ИИ, соответствующую международным требованиям.

Кейсы и практические рекомендации по предотвращению рисков

Теория хороша, но практика — лучше. Разберём реальные кейсы атак и меры защиты.

Кейс 1: Атака на систему распознавания лиц

В одном из проектов система распознавания лиц использовалась для контроля доступа. Злоумышленники распечатали состязательный патч — небольшую наклейку с определённым узором. Когда человек с такой наклейкой подходил к камере, система не распознавала его или ошибочно идентифицировала как другого сотрудника.

Описание атаки

Патч был оптимизирован так, чтобы вводить модель в заблуждение. Он занимал всего 10% площади лица, но этого хватило для успешной атаки.

Примененные меры защиты

Команда внедрила adversarial training: добавила в обучающий набор тысячи состязательных патчей. Также был добавлен мониторинг: система фиксировала необычные паттерны на изображениях (например, резкие перепады яркости) и отправляла их на проверку оператору.

Результаты и выводы

После дообучения точность модели на атакованных изображениях выросла с 30% до 95%. Однако полностью исключить риск не удалось — злоумышленники могут генерировать новые патчи.

Кейс 2: Утечка данных через модель рекомендательной системы

Рекомендательная система интернет-магазина использовала историю покупок пользователей. Исследователи провели атаку членства: отправляя специально сформированные запросы, они смогли определить, какие товары покупал конкретный пользователь.

Описание атаки

Атака членства основана на том, что модель по-разному реагирует на данные, которые были в обучающем наборе, и на новые данные. Сравнивая ответы модели на разные запросы, можно сделать вывод о присутствии пользователя.

Примененные меры защиты

Была внедрена дифференциальная приватность с ε = 1.0. Это добавило шум в процесс обучения, сделав атаку членства практически невозможной. Дополнительно были ограничены права API: теперь модель возвращает только топ-10 рекомендаций, а не полные вероятности.

Результаты и выводы

Атака членства перестала работать. Точность рекомендаций снизилась на 2%, что было приемлемо для бизнеса. Пользователи не заметили изменений.

Пошаговый план обеспечения безопасности ИИ-системы

На основе лучших практик и фреймворков предлагаем чек-лист действий для каждого этапа.

Этап 1: Оценка рисков и threat modeling

- Определите критичность системы (high-risk или нет).

- Проведите threat modeling: какие атаки возможны? Кто может быть атакующим?

- Оцените потенциальный ущерб.

Этап 2: Безопасная разработка и тестирование

- Используйте безопасные источники данных.

- Проверяйте данные на отравление.

- Внедрите adversarial training для критических моделей.

- Проведите тестирование на проникновение (red teaming).

Этап 3: Безопасное развертывание

- Используйте контейнеризацию с минимальными правами.

- Шифруйте модель и данные при передаче.

- Настройте rate limiting и фильтрацию запросов.

Этап 4: Непрерывный мониторинг и реагирование

- Отслеживайте метрики: точность, дрейф данных, аномалии.

- Настройте оповещения при отклонениях.

- Разработайте план реагирования на инциденты.

Подробнее о том, как автоматизировать тестирование и интегрировать безопасность в CI/CD, читайте в статье Автоматизация тестирования с помощью плагинов и CI/CD-интеграций.

Совет: начните с малого — выберите одну критическую модель и примените к ней хотя бы три метода защиты из списка. Результаты вдохновят на дальнейшие шаги.

Заключение: будущее безопасности алгоритмов ИИ

Безопасность алгоритмов — это не разовая акция, а непрерывный процесс. Угрозы эволюционируют, появляются новые методы атак, меняется регуляторика. Но базовые принципы остаются неизменными: понимание рисков, интеграция защиты в жизненный цикл, соблюдение этических норм.

Основные выводы

- Комплексный подход к безопасности: ни один метод не даёт 100% защиты, только комбинация техник.

- Интеграция безопасности в жизненный цикл: защита должна быть встроена с этапа проектирования, а не добавлена постфактум.

- Этические и правовые аспекты: соблюдение законов и принципов ответственного ИИ — не только обязанность, но и конкурентное преимущество.

Тренды и прогнозы

- Автоматизация безопасности: инструменты для автоматического обнаружения атак и генерации защит будут развиваться.

- ИИ для защиты ИИ: модели будут использоваться для обнаружения аномалий и генерации состязательных примеров для тестирования.

- Развитие регулирования: ожидается появление новых законов и стандартов, особенно в сфере high-risk ИИ.

Начните внедрять меры безопасности уже сегодня. Даже небольшие шаги — аудит данных, настройка мониторинга, обучение команды — существенно снизят риски. И помните: безопасность алгоритмов — это инвестиция в доверие пользователей и устойчивость бизнеса.

Подробнее о том, как автоматизировать тестирование и интегрировать безопасность в CI/CD, читайте в статье Автоматизация тестирования с помощью плагинов и CI/CD-интеграций.

Часто задаваемые вопросы

Какие основные угрозы для систем ИИ?

Основные угрозы включают состязательные атаки (манипуляция входными данными), атаки на конфиденциальность (извлечение данных), отравление данных, DoS-атаки и предвзятость алгоритмов.

Что такое состязательная атака?

Это внесение минимальных, незаметных для человека изменений во входные данные, чтобы модель приняла неверное решение. Например, наклейка на дорожный знак, которая заставляет беспилотник неправильно его интерпретировать.

Как защитить модель от атак?

Используйте комбинацию методов: adversarial training, дифференциальную приватность, мониторинг аномалий, шифрование данных, а также следуйте фреймворкам вроде NIST AI RMF.

Что такое дифференциальная приватность?

Это математический метод, который добавляет шум в процесс обучения, чтобы невозможно было определить, участвовали ли конкретные данные в обучении. Это защищает конфиденциальность пользователей.

Какие есть стандарты безопасности ИИ?

Наиболее известные: NIST AI Risk Management Framework, OWASP AI Security Top 10, ISO/IEC 42001, IEEE 7010. Они помогают систематизировать работу с рисками.

Как часто нужно проводить аудит модели?

Рекомендуется проводить аудит не реже одного раза в квартал, а также после каждого значительного обновления модели или изменения данных.

Что делать, если модель уже атакована?

Немедленно остановите использование модели, зафиксируйте все данные об атаке, проведите расследование, устраните уязвимость и переобучите модель. Сообщите об инциденте регулирующим органам, если это требуется по закону.