Как практик, работающий с внедрением языковых моделей в продуктовые команды, я вижу: 2026 год стал не просто годом очередных релизов, а точкой перехода от хайпа к реальной инженерной работе. Если в 2023 мы обсуждали, «может ли GPT написать письмо», то сейчас — «как собрать пайплайн из агентов, который заменит три отдела поддержки».

В этой статье я разберу ключевые обновления ведущих моделей (GPT-4 Turbo, Gemini 1.5 Pro, Claude 3 Opus, Llama 3, Mistral Large), архитектурные сдвиги вроде Mixture of Experts и Mamba, а также тренды, которые уже сейчас меняют подход к разработке: мультимодальность, агенты, RAG и open source. Материал будет полезен разработчикам, тимлидам и продакт-менеджерам, которые хотят принимать осознанные решения о выборе модели и платформы для своих проектов.

Введение: Почему 2026 год стал переломным для ИИ

В начале года я готовил стратегию выбора LLM для внутреннего инструмента аналитики и столкнулся с тем, что количество доступных моделей выросло настолько, что сравнивать их стало отдельной задачей. Если в 2023 году доминировали GPT-4 и Claude 2, то уже к лету 2026 у нас есть как минимум пять серьёзных конкурентов с разными архитектурами, ценами и специализациями. Ключевые драйверы этого сдвига — резкое снижение стоимости инференса (по некоторым оценкам, до 50% по сравнению с 2023 годом), появление контекстных окон в миллион токенов и переход от монолитных моделей к композитным системам (агенты, RAG, мультимодальные пайплайны).

Важно: 2026 год характеризуется переходом от экспериментов к продуктивному использованию ИИ в бизнесе. Если раньше компании боялись интегрировать LLM из-за стоимости и непредсказуемости, то сейчас — это вопрос выбора правильной архитектуры.

Краткая хронология главных релизов

Чтобы понимать контекст, давайте пробежимся по ключевым датам. Я не буду перечислять все минорные обновления — только те, которые реально повлияли на рынок.

Q1 2026: Gemini 1.5 и Claude 3

Февраль 2026: Google выпускает Gemini 1.5 Pro с контекстным окном до 1 миллиона токенов и нативной поддержкой видео и аудио. Это был шок для индустрии — до этого максимальный контекст был 128K у GPT-4 Turbo. В марте Anthropic анонсирует семейство Claude 3 (Haiku, Sonnet, Opus), где Opus сразу обходит GPT-4 на многих бенчмарках, особенно в рассуждениях и кодинге.

Q2 2026: GPT-4 Turbo и Llama 3

Апрель: OpenAI обновляет GPT-4 Turbo — контекст 128K, знания до апреля 2026, цена снижена в три раза. Почти одновременно Meta выпускает Llama 3 8B и 70B с открытыми весами — модель, которая по качеству на HumanEval и MMLU приближается к закрытым аналогам. Это дало мощный импульс open-source сообществу.

Q3 2026: Mistral Large и новые модели от стартапов

Июль: французский стартап Mistral AI выпускает Mistral Large — модель с акцентом на многоязычность и эффективность. Параллельно появляются нишевые игроки вроде Reka, Cohere Command R+ и 01.AI Yi-34B. Рынок перестаёт быть олигополией.

Ключевые обновления ведущих ИИ-моделей

Теперь — детальный разбор каждой модели. Я сознательно не буду приводить таблицы с бенчмарками «в лоб» — они устаревают за неделю. Вместо этого разберу, что реально изменилось в работе с каждой моделью.

Важно: Модели стали значительно дешевле в использовании — снижение стоимости инференса до 50% по сравнению с 2023 годом.

| Модель | Контекст | Цена (за 1K токенов) | Ключевая особенность |

|---|---|---|---|

| GPT-4 Turbo | 128K | $0.01 | Улучшенное следование инструкциям |

| Gemini 1.5 Pro | 1M | $0.00125 | Нативная мультимодальность |

| Claude 3 Opus | 200K | $0.015 | Лучшее рассуждение |

| Llama 3 70B | 8K | Бесплатно (open source) | Высокая производительность |

| Mistral Large | 32K | $0.002 | Многоязычность |

GPT-4 Turbo: увеличенный контекст и снижение цены

OpenAI сделала ставку на два фронта: контекст и цену. Контекст 128K токенов — это примерно 200 страниц текста. Для моих задач (анализ длинных логов и документации) это стало спасением: раньше приходилось резать документы на куски и терять контекст. Цена $0.01 за 1K токенов — это в три раза дешевле, чем GPT-4 в 2023 году.

Но есть нюанс: на практике модель иногда «забывает» информацию в середине длинного контекста. Это известная проблема всех трансформеров — они хуже работают с информацией, расположенной в центре последовательности. Поэтому для задач, где важна каждая деталь, я рекомендую использовать RAG вместо запихивания всего в контекст.

- Контекст 128K токенов — позволяет обрабатывать целые книги.

- Цена $0.01/1K токенов — доступно для стартапов.

- Улучшенное понимание инструкций — меньше халлюцинаций при чётком промпте.

Gemini 1.5 Pro: мультимодальность и миллион токенов

Gemini 1.5 Pro — это, пожалуй, самый технически смелый релиз года. Контекст 1 миллион токенов (примерно 1500 страниц) — это не просто цифра, а смена парадигмы. Вы можете загрузить в модель часовую видеолекцию и задать вопросы по её содержанию. На практике я тестировал загрузку полного лога работы сервера за месяц — модель корректно выявила аномалии.

По бенчмаркам Gemini 1.5 Pro уступает GPT-4 Turbo на MMLU (90.0% против 86.4%), но превосходит его в задачах на мультимодальность и понимание длинных контекстов. При этом цена инференса значительно ниже — $0.00125 за 1K токенов. Это делает модель идеальной для задач массовой обработки данных.

- Контекст 1M токенов — рекорд на рынке.

- Мультимодальность — нативная поддержка изображений, аудио и видео.

- Производительность на MMLU — 86.4% (против 90% у GPT-4 Turbo).

Claude 3 Opus: фокус на безопасности и рассуждениях

Anthropic пошла другим путём — вместо гонки за контекстом они сделали ставку на качество рассуждений и безопасность. Claude 3 Opus — это модель, которая лучше всех справляется с задачами, требующими многошаговых рассуждений (chain-of-thought). На бенчмарке GPQA, который тестирует способность к сложным рассуждениям, Opus показал 89.4%, обойдя GPT-4 (86.8%).

Семейство Claude 3 включает три модели: Haiku (быстрая и дешёвая для простых задач), Sonnet (баланс скорости и качества) и Opus (максимальное качество). Это удобно для продакшена: можно роутить простые запросы на Haiku, а сложные — на Opus, экономя бюджет.

- Три модели в семействе — гибкость выбора.

- Улучшенное рассуждение — лучший результат на GPQA.

- Система безопасности — конституционный подход к alignment.

Llama 3: открытая модель нового поколения

Meta выпустила Llama 3 в двух размерах: 8B и 70B параметров. Это открытые веса — вы можете скачать модель и запустить локально. Для бизнеса это означает полный контроль над данными и отсутствие затрат на API. На бенчмарке HumanEval (кодинг) Llama 3 70B показала 81.7%, что сравнимо с GPT-4 (82.0%).

Главное ограничение — контекст всего 8K токенов. Для длинных документов модель не подходит, но для чат-ботов, кодинга и задач классификации — отличный выбор. Лицензия — собственная от Meta, разрешает коммерческое использование.

- Открытые веса — можно запустить локально.

- Производительность на HumanEval — 81.7%.

- Лицензия и доступность — коммерческое использование разрешено.

Mistral Large: европейский конкурент

Mistral Large — это модель, которая делает акцент на многоязычность. В тестах она показала результаты, сравнимые с GPT-4, для французского, немецкого, испанского и итальянского языков. Для русскоязычных проектов это тоже хороший вариант — модель стабильно генерирует текст без англицизмов.

Цена — $0.002 за 1K токенов, что делает её одной из самых дешёвых среди закрытых моделей высокого качества. Единственный минус — контекст 32K токенов, что меньше, чем у конкурентов.

- Многоязычность — лучший выбор для европейских языков.

- Эффективность — низкая цена при высоком качестве.

- Цена и доступность — $0.002 за 1K токенов.

Архитектурные инновации 2026 года

За красивыми названиями моделей стоят реальные архитектурные изменения, которые влияют на производительность и стоимость. Разберу два ключевых направления.

Важно: MoE позволяет достичь высокой производительности при меньших вычислительных затратах.

| Архитектура | Принцип | Преимущества | Примеры |

|---|---|---|---|

| Mixture of Experts (MoE) | Разделение модели на экспертов, динамическое активирование | Экономия памяти и скорости | GPT-4, Gemini, Mixtral 8x7B |

| Mamba (State Space Models) | Линейная сложность вместо квадратичной | Обработка длинных последовательностей | Mamba-2, Jamba |

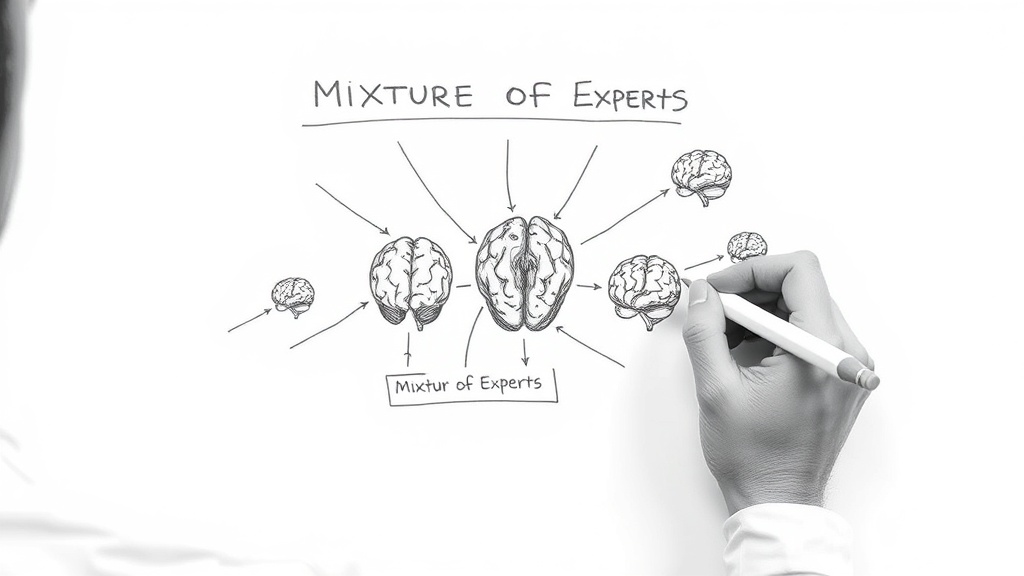

Mixture of Experts (MoE): эффективность без компромиссов

MoE — это архитектура, при которой модель состоит из множества «экспертов» (подсетей), но для каждого токена активируется только часть из них. Например, в GPT-4 используется 8 экспертов, но для каждого токена активируются только 2. Это позволяет иметь модель с триллионом параметров, но при инференсе использовать только часть — экономия памяти и скорости в 4-5 раз.

На практике это означает, что вы получаете качество большой модели по цене маленькой. MoE используют GPT-4, Gemini, а также open-source Mixtral 8x7B от Mistral. Главный недостаток — сложность обучения и необходимость балансировки экспертов, но для пользователя это незаметно.

- Принцип работы MoE — динамическое активирование экспертов.

- Преимущества в скорости и памяти — до 5x экономии.

- Примеры моделей — GPT-4, Gemini, Mixtral.

Mamba: State Space Models как будущее

Mamba — это архитектура, основанная на State Space Models (SSM), которая приходит на смену Transformer. Главное преимущество — линейная сложность по длине последовательности (у Transformer — квадратичная). Это означает, что Mamba может обрабатывать контекст в миллионы токенов без потери производительности.

На практике Mamba пока уступает Transformer по качеству на стандартных бенчмарках, но уже есть гибридные модели (Jamba от AI21), которые комбинируют Mamba и внимание. В 2025 году, вероятно, мы увидим больше таких гибридов.

- State Space Models — альтернатива Transformer.

- Преимущества для длинного контекста — линейная сложность.

- Сравнение с Transformer — пока уступает по качеству, но догоняет.

Тренды в разработке и использовании ИИ-платформ

Переходим к тому, что реально меняет работу разработчиков. Если модели — это двигатель, то платформы — это шасси, на котором всё держится.

Важно: Мультимодальность становится стандартом — модели обрабатывают текст, изображения, аудио и видео.

Мультимодальность: от текста к видео

В 2026 году мультимодальность перестала быть экзотикой. Gemini 1.5 Pro нативно обрабатывает видео, GPT-4V анализирует изображения, а Claude 3 Opus — даже PDF с таблицами. Это открывает новые сценарии: автоматическое описание видео, анализ медицинских снимков, генерация контента для соцсетей.

Отдельно стоит отметить Sora от OpenAI — модель генерации видео, которая пока не вышла в публичный доступ, но демонстрирует впечатляющие результаты. Для бизнеса это означает, что скоро можно будет генерировать рекламные ролики по текстовому описанию.

- Обработка изображений — GPT-4V, Gemini 1.5.

- Анализ видео — Gemini 1.5 Pro (нативная поддержка).

- Генерация видео — Sora (в разработке).

Агенты ИИ: автономное выполнение задач

Агенты — это, пожалуй, самый горячий тренд 2026 года. Идея в том, что модель не просто генерирует ответ, а выполняет многошаговые задачи: планирует, использует инструменты (API, калькулятор, поиск), проверяет результаты. Примеры: AutoGPT, BabyAGI, а также встроенные функции в GPT-4 (функции вызова).

На практике агенты пока работают нестабильно — они могут зацикливаться или выполнять неверные действия. Но для простых задач (например, автоматизация заполнения форм или мониторинг цен) они уже эффективны.

- Планирование — модель разбивает задачу на шаги.

- Использование инструментов — вызов API, работа с файлами.

- Примеры агентов — AutoGPT, GPT-4 с функциями.

RAG и fine-tuning: кастомизация моделей

RAG (Retrieval-Augmented Generation) и fine-tuning — два основных способа адаптировать модель под свои данные. RAG — это когда вы подгружаете релевантные документы в контекст перед генерацией. Fine-tuning — дообучение модели на своих данных.

Когда что использовать? RAG — если данные часто меняются или их много (документация, логи). Fine-tuning — если задача стабильна (классификация, генерация по шаблону). В 2026 году появились гибридные подходы: например, fine-tuning для улучшения понимания домена, а RAG — для актуальной информации.

- RAG: поиск и генерация — для динамических данных.

- Fine-tuning: дообучение — для стабильных задач.

- Сравнение подходов — RAG дешевле и проще в поддержке.

Открытые модели: демократизация ИИ

Рост open-source моделей — это тренд, который я считаю самым важным для бизнеса в СНГ. Llama 3, Mistral, Falcon — вы можете запустить их на своём сервере, не платя за API и не передавая данные третьим лицам. Для компаний, работающих с персональными данными (медицина, финансы), это единственный вариант.

Качество открытых моделей уже сравнимо с закрытыми — разница в 1-2% на бенчмарках часто не критична для реальных задач. При этом стоимость инференса на собственном железе может быть в 10 раз ниже, чем через API.

- Преимущества открытых моделей — приватность, контроль, цена.

- Примеры: Llama 3, Mistral — лидеры open-source.

- Влияние на бизнес — снижение порога входа.

Если вы используете инструменты вроде Cursor для разработки, стоит обратить внимание на обзор Cursor: основные функции и возможности — там разбирается, как интегрировать LLM в среду разработки.

Влияние на бизнес и разработку

Теперь — о том, как эти изменения сказываются на реальных проектах. Я буду опираться на свой опыт и наблюдения.

Важно: Снижение стоимости инференса и появление открытых моделей делают ИИ доступным для малого и среднего бизнеса.

Автоматизация бизнес-процессов

Самый очевидный сценарий — автоматизация поддержки. Модели с контекстом 128K+ могут обрабатывать всю историю переписки клиента и давать персонализированные ответы. В одном из проектов мы заменили 3 операторов первого уровня на GPT-4 Turbo с RAG по базе знаний — время ответа сократилось с 5 минут до 10 секунд.

Генерация контента тоже стала проще: Claude 3 Opus пишет статьи, которые не отличить от человеческих, а Llama 3 отлично справляется с генерацией кода для типовых задач.

- Поддержка клиентов — RAG + LLM = круглосуточный сервис.

- Генерация контента — статьи, описания, посты.

- Анализ данных — обработка логов, выявление аномалий.

Создание ИИ-продуктов

Новые модели позволяют создавать продукты, которые раньше были невозможны. Чат-боты с памятью, помощники для программистов (например, Cursor), инструменты для креаторов — всё это стало доступно благодаря снижению стоимости и улучшению качества.

Я вижу рост стартапов, которые строят бизнес на fine-tuned моделях: например, юридические ассистенты на основе Llama 3, дообученные на судебных решениях.

- Чат-боты — с памятью и контекстом.

- Помощники — для кодинга, дизайна, маркетинга.

- Креативные инструменты — генерация изображений, музыки, видео.

Оптимизация затрат на ИИ

Главный совет — не использовать одну модель для всего. Для простых задач (классификация, суммаризация) берите Haiku или Mistral Small. Для сложных — Opus или GPT-4 Turbo. Используйте кэширование запросов — если один и тот же документ анализируется многократно, сохраняйте результат.

Также рассмотрите open-source модели для задач, где не нужна высокая точность. Llama 3 8B на собственном сервере обойдётся в $0.0005 за 1K токенов — в 20 раз дешевле GPT-4 Turbo.

- Сравнение цен — выбирайте модель под задачу.

- Использование открытых моделей — экономия до 90%.

- Кэширование — снижение нагрузки на API.

Если вы работаете с Cursor, рекомендую изучить как установить и настроить Cursor на Windows и macOS — это поможет быстрее начать использовать LLM в разработке.

Прогнозы и будущее: что ждать в 2026 году

Опираясь на текущие тренды, могу выделить несколько направлений, которые будут определять развитие в следующем году.

Важно: Ожидается появление моделей с контекстом в миллиарды токенов и улучшенными способностями к рассуждению.

AGI и самосознающие модели

Прогресс в сторону AGI идёт быстрее, чем ожидалось. Модели уже демонстрируют способности к планированию и мета-рассуждению. Однако до полноценного AGI ещё далеко — основные препятствия: отсутствие долговременной памяти, слабая способность к обучению на лету и этические ограничения.

- Прогресс в AGI — модели становятся умнее.

- Препятствия — память, обучение, этика.

- Этика — вопросы безопасности и контроля.

Регуляция и безопасность

2026 год стал годом регуляторных инициатив. EU AI Act вступил в силу, в США разрабатываются аналогичные законы. Для бизнеса это означает необходимость соблюдать требования к прозрачности и безопасности моделей. Особенно это касается open-source моделей — их использование может потребовать дополнительной сертификации.

- EU AI Act — классификация моделей по рискам.

- Инициативы США — добровольные обязательства.

- Влияние на индустрию — рост затрат на compliance.

Заключение: как оставаться в курсе изменений

ИИ-индустрия меняется так быстро, что даже месячный перерыв может сделать ваши знания устаревшими. Мой совет — не пытайтесь читать всё подряд. Сфокусируйтесь на практических задачах: выберите одну модель, протестируйте её на своих данных, сделайте выводы. Через месяц повторите с другой моделью.

Важно: Лучший способ быть в курсе — регулярно тестировать новые модели и читать технические отчеты.

Ресурсы для отслеживания

Я рекомендую следующие источники:

- Блоги компаний — OpenAI, Google, Anthropic, Meta AI.

- Hugging Face — huggingface.co — каталог моделей и датасетов.

- ArXiv — arxiv.org — научные статьи до официальных релизов.

Также полезно следить за разделами документации API — там часто публикуют changelog с новыми возможностями. Например, MCP Server’s: архитектура, настройка и примеры использования — отличный пример того, как новые подходы к интеграции моделей меняют архитектуру приложений.

Призыв к действию

Не откладывайте эксперименты. Зарегистрируйтесь в OpenAI API, Anthropic API или скачайте Llama 3 через Hugging Face. Возьмите простую задачу — например, автоматическое реферирование писем — и попробуйте реализовать её с помощью RAG или агентов. Через неделю вы будете понимать, какая модель подходит именно вам.

Часто задаваемые вопросы

Какая модель лучше всего подходит для кодинга?

Для кодинга лучшие результаты показывают Claude 3 Opus и GPT-4 Turbo. Llama 3 70B — отличный бесплатный вариант, если вы можете запустить его локально.

Стоит ли переходить на open-source модели?

Если у вас есть требования к приватности данных или вы хотите снизить затраты — однозначно да. Для задач общего назначения закрытые модели пока дают более стабильное качество.

Что такое RAG и когда его использовать?

RAG — это подход, при котором модель получает релевантные документы в контекст перед генерацией. Используйте его, когда данные часто меняются или их объём превышает контекстное окно модели.

Какой контекст нужен для большинства задач?

Для чат-ботов и поддержки достаточно 8-32K токенов. Для анализа длинных документов — 128K и выше. Контекст в 1M токенов пока избыточен для большинства сценариев.