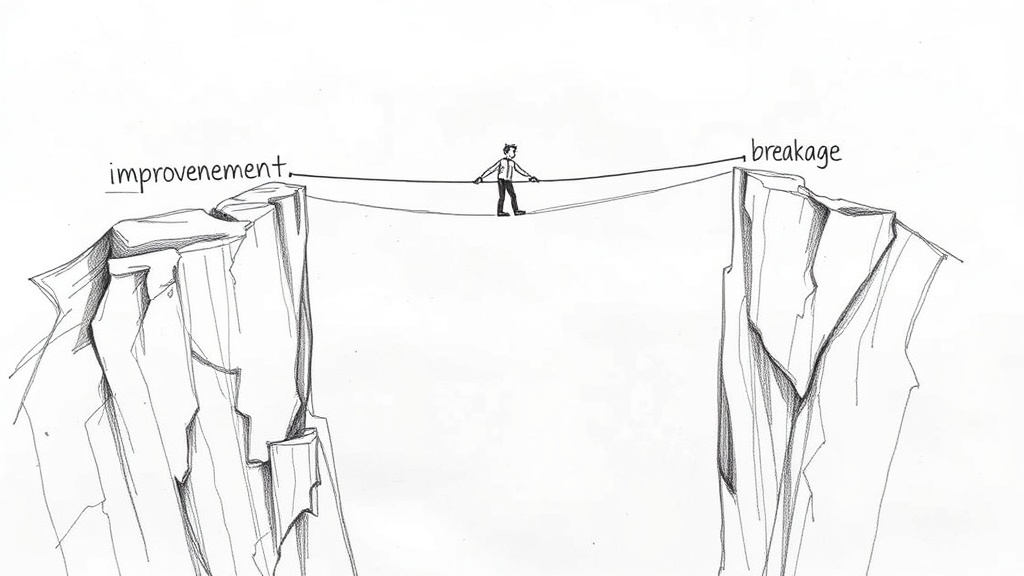

Как практик, работающий с внедрением языковых моделей в продуктовые команды, я вижу регулярную картину: команда радостно обновляет версию модели, а через неделю падает NPS — ответы стали «какими-то другими». Обновления ИИ-моделей — это не просто багфиксы. Это сдвиг распределения вероятностей, изменение поведения, которое может как улучшить продукт, так и сломать тонко настроенные промпты.

В этой статье разберу, как устроен цикл обновлений, какие тренды доминируют в 2024–2025 годах и что делать разработчику, чтобы не оказаться застигнутым врасплох.

Введение: почему обновления ИИ-моделей — это не просто багфиксы

Когда вы обновляете обычное приложение, вы получаете фикс бага или новую фичу. Поведение предсказуемо. С ИИ-моделью всё иначе: вы меняете нейросеть, и она начинает «думать» по-другому. Примеры резонансных обновлений — GPT-4 → GPT-4o, Claude 3 → 3.5 — показывали кардинальные изменения в стиле ответов, точности и даже безопасности. Для бизнеса это означает, что каждое обновление — это риск и одновременно возможность.

Важно: обновление модели может кардинально изменить результаты вашего приложения — тестируйте каждую версию перед развертыванием.

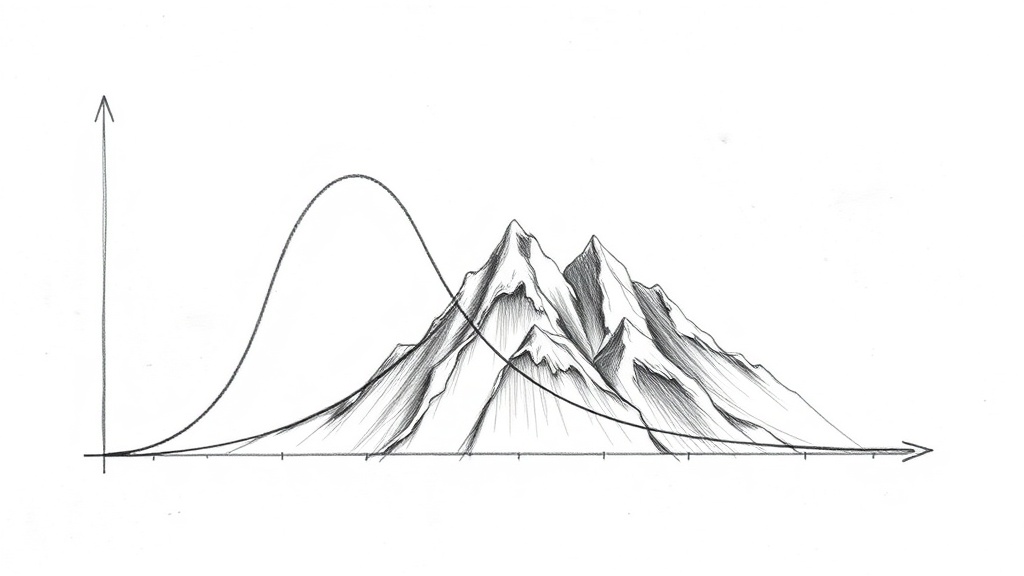

Отличие обновлений ИИ от традиционного ПО

В традиционном ПО вы фиксите баг — поведение становится более корректным. В ИИ вы меняете распределение вероятностей: модель может начать лучше отвечать на вопросы по математике, но хуже — на юридические запросы. Это называется дрейф модели. Концепция версионирования здесь сложнее: модель — это не просто бинарник, а набор весов, токенизатор, гиперпараметры. Совместимость API часто нарушается: новый эндпоинт может ожидать другие форматы или выдавать иную структуру ответа. Обратная совместимость — редкий зверь.

Версионирование

Провайдеры используют даты релиза (gpt-4-turbo-2024-04-09) или семантические метки (claude-3-5-sonnet-20241022). Всегда указывайте точную версию в запросе.

Совместимость API

Новая версия может изменить формат streaming, добавить новые поля или удалить старые. Читайте changelog.

Обратная совместимость

Редко гарантируется. Если вы не зафиксируете версию, провайдер может обновить модель «под капотом» без вашего ведома.

Когда и зачем обновляют ИИ-модели: драйверы и триггеры

Обновления происходят по нескольким причинам: улучшение качества (бенчмарки, снижение галлюцинаций), расширение возможностей (мультимодальность, длинный контекст), исправление уязвимостей (джеллбрейки, утечки), снижение стоимости и задержки, соответствие регуляциям. Иногда обновления бывают «тихими» — без анонса, только в changelog API.

| Драйвер | Пример триггера | Влияние на бизнес |

|---|---|---|

| Качество | Низкие показатели на MMLU, HumanEval | Улучшение точности ответов, снижение ошибок |

| Безопасность | Новый jailbreak-метод, утечка данных | Снижение репутационных рисков, соответствие регуляциям |

| Экономика | Высокая стоимость инференса | Снижение TCO, возможность масштабирования |

| Регуляции | EU AI Act, локальные законы | Штрафы, блокировки, обязательное тестирование |

Частая ошибка: некоторые обновления могут быть ‘тихими’ — без анонса, только в changelog API. Не пропускайте их.

Качество и бенчмарки

Ключевые бенчмарки — MMLU (понимание языка), HumanEval (генерация кода), GSM8K (математические рассуждения). Обновления часто анонсируются с улучшением на 5-10% по этим метрикам. Но бенчмарки не всегда отражают реальный UX: модель может отлично решать задачи из тестовой выборки, но хуже работать с реальными запросами пользователей. Всегда проверяйте на своих данных.

MMLU

Измеряет знания в 57 предметных областях. Высокий балл — признак широкой эрудиции модели.

HumanEval

Проверяет способность генерировать корректный код по описанию. Критично для разработчиков.

GSM8K

Оценивает математические рассуждения. Важно для финансовых и образовательных приложений.

Безопасность и этика

Триггеры — выявление уязвимостей, новые jailbreak-атаки, требования регуляторов (EU AI Act). Провайдеры используют RLHF (reinforcement learning from human feedback) и красные команды (red-teaming) для выявления слабых мест. Обновления безопасности часто выходят экстренно.

Jailbreak

Методы обхода ограничений модели. Каждое обновление закрывает известные векторы атак.

RLHF

Обучение с подкреплением на основе человеческого фидбека. Помогает выровнять поведение модели с ожиданиями.

Красные команды

Группы специалистов, которые целенаправленно ищут уязвимости. Результаты их работы часто приводят к срочным обновлениям.

Экономическая эффективность

Снижение стоимости инференса — один из главных драйверов. Квантование (снижение точности весов) и дистилляция (обучение меньшей модели на выходах большой) позволяют уменьшить задержку и стоимость токенов. Это напрямую влияет на TCO (total cost of ownership) для бизнеса.

Квантование

Снижение битности весов (например, с FP16 до INT8) уменьшает размер модели и ускоряет инференс.

Дистилляция

Меньшая модель учится имитировать большую, сохраняя качество при меньших затратах.

TCO

Совокупная стоимость владения: обучение, инференс, инфраструктура, персонал. Экономичные модели снижают TCO.

Как выглядит процесс обновления: от идеи до продакшна

Процесс включает несколько стадий: исследование (новые архитектуры, данные), обучение (дообучение, fine-tuning), тестирование (внутреннее, A/B, канареечное), релиз (постепенный rollout), мониторинг и откат. Ключевую роль играют MLOps и CI/CD.

«Критично: всегда имейте план отката — в ИИ ошибки могут быть неочевидны и проявиться только в бою.»

Этап исследования и разработки

Сбор данных, выбор архитектуры, эксперименты с гиперпараметрами. Эффективные методы дообучения — LoRA (Low-Rank Adaptation) и его вариации. Они позволяют адаптировать модель под конкретную задачу без полного переобучения. Используются синтетические данные для расширения обучающей выборки.

LoRA

Метод, который добавляет небольшое количество обучаемых параметров к замороженной модели. Экономит ресурсы и время.

Гиперпараметры

Скорость обучения, размер батча, количество эпох. Подбор — искусство, часто требующее множества экспериментов.

Синтетические данные

Данные, сгенерированные другой моделью. Используются для обучения, когда реальных данных недостаточно.

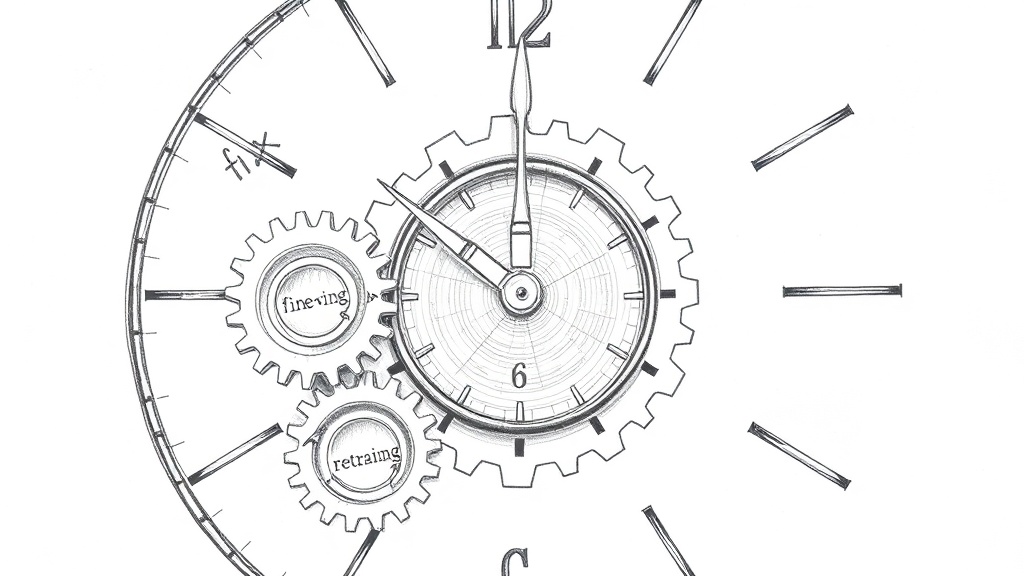

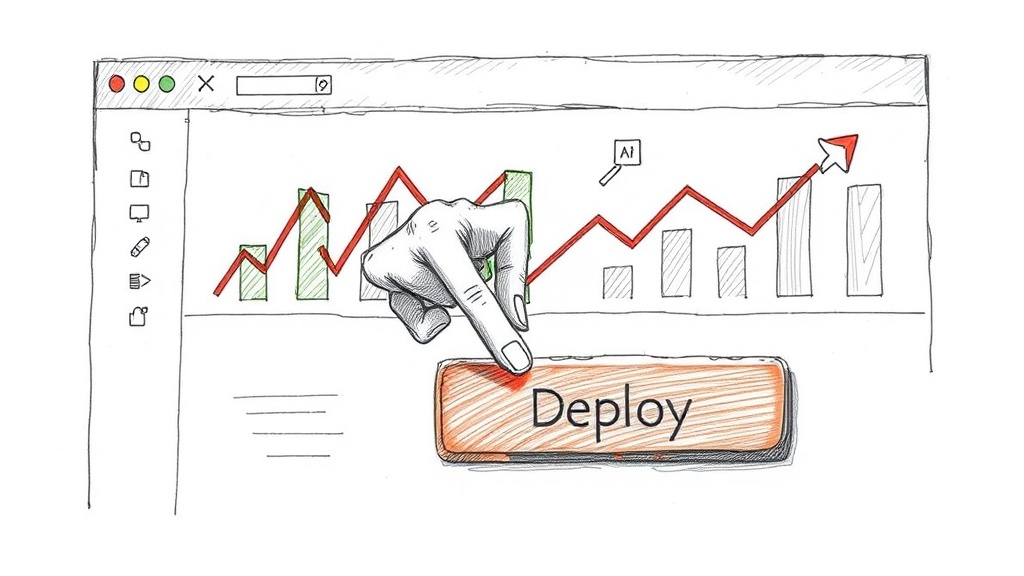

Тестирование и валидация

Внутренние тесты на офлайн-метриках (перплексия, точность). Затем A/B-тесты на реальных пользователях: часть трафика направляется на новую модель, часть — на старую. Канареечные релизы (canary releases) — постепенное увеличение доли трафика на новую версию с мониторингом ключевых метрик.

A/B тест

Разделение трафика для сравнения старой и новой модели. Важно: убедитесь, что выборка репрезентативна.

Канареечный релиз

Постепенное развёртывание: 1% трафика, затем 5%, 10% и т.д. При ухудшении метрик — откат.

Метрики

Задержка, количество ошибок, конверсия, удовлетворённость пользователей (CSAT).

Релиз и мониторинг

Постепенное развертывание. Мониторинг задержки, ошибок, дрейфа. Инструменты: MLflow, Weights & Biases, Prometheus. Важно настроить алерты на аномалии.

MLflow

Платформа для управления жизненным циклом машинного обучения: отслеживание экспериментов, версионирование моделей.

Weights & Biases

Инструмент для визуализации метрик обучения и сравнения экспериментов.

Prometheus

Система мониторинга и алертинга. Используется для сбора метрик инференса в реальном времени.

Ключевые тренды в обновлениях ИИ-моделей (2024–2025)

Тренды формируют то, как мы будем работать с ИИ в ближайшие годы. Мультимодальность, агентные системы, open-source, эффективность, безопасность и объяснимость — вот ключевые направления.

Совет: мультимодальные модели становятся стандартом — если вы не используете изображения/аудио, вы отстаете.

| Тренд | Описание | Примеры моделей |

|---|---|---|

| Мультимодальность | Текст + изображения + аудио | GPT-4o, Gemini, Claude 3.5 Vision |

| Агентные системы | Автономные действия, вызов функций | ChatGPT Plugins, AutoGPT |

| Open-source | Открытые модели для кастомизации | Llama 3, Mistral, Qwen |

| Эффективность | Меньшие модели с высокой производительностью | Mistral 7B, Phi-3 |

Мультимодальность и кросс-модальность

Модели учатся работать с разными типами данных: текст, изображения, аудио, видео. Примеры — GPT-4o (OpenAI), Gemini (Google), Claude 3.5 Vision (Anthropic). Обновления добавляют новые модальности и улучшают их взаимодействие. Например, модель может анализировать изображение и генерировать текстовое описание или отвечать на вопросы по картинке.

GPT-4o

Мультимодальная модель от OpenAI, работающая с текстом, изображениями и аудио.

Gemini

Модель Google, изначально спроектированная как мультимодальная.

Claude 3.5 Vision

Версия Claude с поддержкой изображений. Используется для анализа документов, схем, фотографий.

Агентные системы и инструментальное использование

Обновления дают моделям возможность вызывать функции (function calling), планировать последовательность действий, использовать внешние инструменты (калькуляторы, базы данных, API). Это превращает модель из «болванки» в агента, способного решать комплексные задачи. Примеры — ChatGPT Plugins, AutoGPT.

Function calling

Возможность модели вызывать заранее определённые функции. Ключевая фича для интеграции с внешними системами.

Планирование

Способность разбивать сложную задачу на подзадачи и выполнять их последовательно.

Инструменты

Внешние сервисы (поиск, калькулятор, база знаний), которые модель может использовать для выполнения задачи.

Open-source и демократизация

Тренд на открытые модели (Llama 3, Mistral, Qwen) позволяет компаниям развёртывать ИИ на своей инфраструктуре, кастомизировать и контролировать. Обновления в open-source влияют на рынок: появляются более эффективные архитектуры, снижается порог входа.

Llama 3

Открытая модель от Meta. Доступна в нескольких размерах (8B, 70B, 405B).

Mistral

Французский стартап, выпускающий эффективные открытые модели (Mistral 7B, Mixtral 8x7B).

Qwen

Серия моделей от Alibaba. Поддерживает мультимодальность и длинный контекст.

Что меняется в платформах и API при обновлении моделей

Обновления затрагивают не только саму модель, но и платформу: новые эндпоинты, параметры, форматы, версионирование API, политики использования, ценообразование. Примеры — OpenAI API, Anthropic API, Google AI Studio.

«Совет: всегда указывайте версию модели в API-запросе, чтобы избежать неожиданных изменений.»

Версионирование и совместимость

Провайдеры управляют версиями через даты релиза и точки заморозки. OpenAI с GPT-4-turbo, Anthropic с Claude 3.5 Sonnet. Важно: если не указать версию, провайдер может автоматически обновить модель до последней стабильной, что может сломать ваш код.

Заморозка версии

Фиксация конкретной версии модели в API-запросе. Защита от неожиданных изменений.

Дата релиза

Версии часто именуются по дате (gpt-4-turbo-2024-04-09). Используйте их для точной идентификации.

Совместимость

Проверяйте документацию на предмет breaking changes при каждом обновлении.

Изменения в ценообразовании и лимитах

Обновления часто сопровождаются изменением стоимости токенов, лимитов RPM (requests per minute) и TPM (tokens per minute). Пример: снижение цены на GPT-4o сделало его доступнее для массового использования. Следите за обновлениями на страницах ценообразования провайдеров.

Стоимость токенов

Цена за 1K токенов (входных и выходных). Снижение — ключевой тренд.

RPM

Количество запросов в минуту. Лимиты могут быть увеличены для новых версий.

TPM

Количество токенов в минуту. Важно для приложений с высоким трафиком.

Новые возможности API

Добавление модальностей (vision, audio), улучшение streaming, новые параметры (temperature, top_p, JSON mode). Примеры: JSON mode (гарантированный вывод в JSON), vision API (передача изображений).

Streaming

Постепенная выдача токенов. Улучшения в streaming снижают воспринимаемую задержку.

JSON mode

Режим, при котором модель гарантированно возвращает валидный JSON. Упрощает интеграцию.

Vision API

Эндпоинты для работы с изображениями. Позволяют передавать картинки в запросе.

Как подготовиться к обновлению: чек-лист для разработчика

Практические рекомендации, которые помогут избежать проблем. Следите за changelog, тестируйте на песочнице, используйте версионирование, мониторьте метрики после обновления, имейте план отката, обновляйте документацию.

Частая ошибка: даже минорное обновление может сломать ваш промпт — всегда перепроверяйте на тестовом датасете.

Мониторинг и алерты

Настройка метрик (задержка, ошибки, качество ответов) и алертов на их изменение. Инструменты: Datadog, Grafana, собственные логи. Важно отслеживать не только технические, но и бизнес-метрики (конверсия, NPS).

Datadog

Платформа для мониторинга инфраструктуры и приложений. Позволяет отслеживать задержки и ошибки API.

Grafana

Инструмент для визуализации метрик. Интегрируется с Prometheus и другими источниками.

Логи

Собирайте логи запросов и ответов. Они помогут диагностировать проблемы после обновления.

A/B тестирование новых версий

Методика: разделить трафик, сравнить ключевые метрики (конверсия, удовлетворенность). Примеры инструментов: LaunchDarkly, собственные эксперименты. Важно: тестируйте на репрезентативной выборке и в течение достаточного времени.

LaunchDarkly

Платформа для управления фича-флагами и A/B-тестирования. Позволяет постепенно rollout.

Эксперименты

Собственная система A/B-тестов. Требует разработки, но даёт полный контроль.

Метрики

Определите ключевые метрики до начала теста. Не меняйте их в процессе.

Обновление документации и промптов

Важность актуализации промптов, примеров, инструкций. Как изменения модели могут потребовать переписывания промптов. Пример: новая модель может лучше понимать контекст, но хуже следовать сложным инструкциям — придётся адаптировать промпты.

Промпт-инжиниринг

Искусство составления промптов. После обновления модели промпты могут потребовать корректировки.

Документация

Обновляйте внутреннюю документацию по промптам и интеграции. Это сэкономит время команде.

Примеры

Подготовьте тестовые промпты для каждой версии модели. Сравнивайте результаты.

Будущее обновлений ИИ: что нас ждет

Прогнозы: непрерывное обучение (online learning), персонализированные модели для каждого пользователя, автоматическое A/B-тестирование и откат, квантовые вычисления, полная интеграция с облачными платформами.

«Будущее: модели будут обновляться незаметно для пользователя, адаптируясь под его поведение в реальном времени.»

Непрерывное обучение и адаптация

Концепция моделей, которые учатся на лету, без полного переобучения. Примеры: онлайн-обучение, мета-обучение. Это позволит моделям адаптироваться к изменениям в данных и поведении пользователей без даунтайма.

Онлайн-обучение

Обновление модели на каждом новом примере данных. Требует стабильной инфраструктуры.

Мета-обучение

Обучение модели «учиться» — быстро адаптироваться к новым задачам.

Адаптация

Модель подстраивается под конкретного пользователя или сценарий использования.

Автоматизация тестирования и развертывания

CI/CD для ИИ, автоматические регрессионные тесты, умные системы отката. Роль MLOps будет расти. Инструменты вроде плагинов и CI/CD-интеграций станут стандартом.

CI/CD

Непрерывная интеграция и развертывание для моделей. Автоматизация тестирования и деплоя.

Регрессия

Автоматические тесты на ключевых сценариях. Выявляют ухудшение качества после обновления.

MLOps

Практика объединения ML и DevOps. Включает управление экспериментами, мониторинг, CI/CD.

Регуляторное влияние

Как законы (EU AI Act, AI Bill of Rights) повлияют на процесс обновлений: обязательное тестирование, прозрачность, объяснимость. Компании будут обязаны документировать изменения и оценивать риски.

EU AI Act

Закон ЕС, классифицирующий ИИ-системы по уровню риска. Вводит обязательные требования для систем высокого риска.

Объяснимость

Способность модели объяснить свои решения. Станет обязательной для многих сценариев.

Прозрачность

Требование раскрывать информацию о модели: данные обучения, метрики, ограничения.

Заключение: ключевые выводы

Обновления ИИ — это непрерывный процесс, требующий внимания и подготовки. Ключевые тренды — мультимодальность, агентность, open-source. Разработчикам нужно внедрять MLOps и тестирование. Будущее за непрерывным обучением и автоматизацией. Не бойтесь обновлений — бойтесь отсутствия подготовки к ним.

Совет: не бойтесь обновлений — бойтесь отсутствия подготовки к ним.

Основные рекомендации

- Мониторить changelog провайдеров.

- Тестировать новые версии на песочнице.

- Использовать версионирование в API-запросах.

- Иметь план отката.

- Инвестировать в MLOps.

- Обновлять документацию и промпты.

- Проводить A/B-тесты перед полным rollout.

- Настроить алерты на ключевые метрики.

Для углублённого понимания этических и безопасностных аспектов рекомендую ознакомиться со статьёй «Этика, безопасность и ограничения ИИ-кода: вызовы», а для выбора подходящей среды разработки — «Обзор IDE с AI-интеграцией: сравнение инструментов 2026».

Часто задаваемые вопросы

Как часто обновляются ИИ-модели?

Частота варьируется: крупные провайдеры (OpenAI, Anthropic) выпускают мажорные обновления раз в несколько месяцев, минорные — еженедельно. Open-source модели обновляются реже, но сообщество выпускает дообученные версии постоянно.

Что делать, если после обновления модель стала хуже отвечать?

Первое — откатиться на предыдущую версию (если есть план отката). Второе — проанализировать, какие именно ответы ухудшились, и адаптировать промпты. Третье — сообщить провайдеру о проблеме.

Нужно ли переписывать промпты после каждого обновления?

Не всегда, но желательно тестировать. Даже минорное обновление может изменить распределение вероятностей, и промпты, которые работали раньше, могут стать менее эффективными.

Как узнать о предстоящем обновлении модели?

Следите за официальными блогами провайдеров (OpenAI Blog, Anthropic Blog), changelog API, рассылками. Также полезно подписаться на репозитории open-source моделей на GitHub.

Что такое «тихое» обновление?

Это обновление модели без официального анонса. Провайдер может изменить модель «под капотом», и вы узнаете об этом только по изменению поведения. Чтобы избежать сюрпризов, всегда фиксируйте версию модели в запросе.