Разработка и внедрение искусственного интеллекта перестали быть уделом лабораторий — ИИ-код сегодня управляет рекомендациями, кредитными скорингами, диагностикой и даже судебными решениями. Но с ростом влияния пришли и риски: предвзятые алгоритмы, утечки данных, атаки на модели и правовая неопределённость.

Эта статья — полный разбор того, как этика, безопасность и регулирование ИИ-кода влияют на реальную разработку, и что нужно знать каждому, кто создаёт или использует такие системы.

Введение: почему этика и безопасность ИИ-кода стали критически важными

Ещё пять лет назад обсуждение этики ИИ казалось академической роскошью. Сегодня это вопрос выживания бизнеса. Инциденты с предвзятыми чат-ботами, утечки данных через модели и внезапные блокировки регуляторов заставили компании пересмотреть подходы. По данным Gartner, к 2025 году 30% крупных организаций будут иметь специальный комитет по этике ИИ.

Важно: Регуляторы уже не ждут добровольных шагов — они вводят обязательные требования. AI Act Европейского Союза и GDPR задают жёсткие рамки, а их нарушение грозит многомиллионными штрафами.

В этой статье мы разберём ключевые этические дилеммы, угрозы безопасности, регуляторные рамки и практические рекомендации. Вы узнаете, как внедрить ответственный ИИ без потери эффективности.

Эволюция регулирования ИИ: от рекомендаций к законам

Путь от добровольных принципов до юридически обязательных норм занял всего несколько лет. В 2017 году Азиломарские принципы заложили основы ответственного ИИ, но они были лишь моральным ориентиром. В 2019 году ЕС опубликовал этические руководства, а уже в 2024 году вступил в силу AI Act — первый в мире комплексный закон об ИИ.

Азиломарские принципы (2017)

Эти 23 принципа охватывали безопасность, справедливость и прозрачность. Они стали отправной точкой для многих корпоративных политик, но не имели механизмов принуждения.

Этические руководства ЕС (2019)

Документ выделил семь ключевых требований: человеческий контроль, техническая надёжность, приватность, прозрачность, недискриминация, благополучие и подотчётность. На их основе позже строился AI Act.

AI Act (2024)

Этот закон классифицирует ИИ-системы по уровню риска: неприемлемый (запрет), высокий (жёсткие требования), ограниченный (прозрачность) и минимальный (кодекс поведения). Для разработчиков это означает необходимость документирования, оценки рисков и человеческого надзора.

Этические дилеммы при разработке и использовании ИИ-кода

Этика ИИ — не абстрактная философия, а конкретные проблемы, с которыми сталкиваются разработчики и бизнес. Основные дилеммы: предвзятость, справедливость, прозрачность, объяснимость, конфиденциальность и автономия. Рассмотрим каждую.

Частая ошибка: Считать, что если данные нейтральны, то и модель будет справедливой. На самом деле даже нейтральные данные могут содержать историческую предвзятость — например, если в прошлом решения принимались дискриминационно.

Предвзятость и дискриминация в алгоритмах

Предвзятость возникает на всех этапах: от сбора данных (нерепрезентативная выборка) до выбора признаков (использование чувствительных атрибутов) и разметки (субъективные метки). Примеры: системы найма, которые отсеивают женщин, или кредитные скоринги, дискриминирующие по расовому признаку.

Методы борьбы включают ресэмплинг, корректировку весов и использование метрик справедливости. Например, demographic parity требует, чтобы процент положительных решений был одинаков для всех групп, а equal opportunity — чтобы точность для положительного класса была равной.

Источники предвзятости

- Нерепрезентативные данные: если обучающая выборка не отражает реальное разнообразие, модель будет смещена.

- Выбор признаков: использование косвенных прокси (например, почтовый индекс вместо расы) может воспроизводить дискриминацию.

- Разметка: если эксперты имеют неосознанные предубеждения, метки будут их отражать.

Метрики справедливости

- Demographic parity: P(прогноз=1 | группа A) = P(прогноз=1 | группа B).

- Equal opportunity: P(прогноз=1 | истина=1, группа A) = P(прогноз=1 | истина=1, группа B).

- Equalized odds: равенство и для истинных, и для ложных срабатываний.

Инструменты детекции

- IBM AI Fairness 360: библиотека с метриками и алгоритмами смягчения предвзятости.

- Google What-If Tool: визуальный инструмент для анализа поведения модели.

Прозрачность и объяснимость моделей

Проблема «чёрного ящика» — модели глубокого обучения часто необъяснимы. Это критично для высокорисковых систем, где требуется право на объяснение (ст. 22 GDPR). XAI (explainable AI) предлагает методы: LIME (локальные аппроксимации), SHAP (теоретико-игровые значения) и attention maps.

LIME

LIME строит локальную линейную модель вокруг конкретного предсказания, показывая, какие признаки повлияли на результат. Простой и интерпретируемый метод.

SHAP

SHAP вычисляет вклад каждого признака на основе теории игр Шепли. Он даёт глобальные и локальные объяснения, но вычислительно дорог для больших моделей.

Интерпретируемые модели vs. пост-хок объяснения

Иногда лучше использовать изначально интерпретируемые модели (линейная регрессия, деревья решений), чем пытаться объяснить сложную нейросеть. Выбор зависит от требований к точности и объяснимости.

Конфиденциальность данных и приватность

Модели могут «запоминать» обучающие данные и раскрывать их через атаки инверсии (model inversion) или membership inference (определение, был ли образец в обучающей выборке). Решения: дифференциальная приватность, федеративное обучение и гомоморфное шифрование.

Дифференциальная приватность (ε-параметр)

Добавляет шум в данные или градиенты так, что присутствие или отсутствие одного образца незначительно меняет результат. Параметр ε контролирует уровень приватности: меньший ε — больше приватности, но ниже точность.

Федеративное обучение

Модель обучается на устройствах пользователей без передачи данных на сервер. Это снижает риск утечек, но требует координации и защиты от атак на агрегацию.

Гомоморфное шифрование

Позволяет выполнять вычисления на зашифрованных данных. Результат расшифровывается только владельцем ключа. Высокая вычислительная стоимость ограничивает применение.

Безопасность ИИ-систем: угрозы и меры защиты

ИИ-системы уязвимы для атак на всех этапах жизненного цикла. Основные категории: состязательные атаки, атаки отравления и атаки на конфиденциальность. Безопасность должна быть встроена с самого начала.

Важно: Безопасность должна быть встроена на всех этапах жизненного цикла ИИ — от сбора данных до развёртывания и мониторинга.

Состязательные атаки (adversarial attacks)

Небольшие, незаметные для человека искажения входных данных могут полностью изменить классификацию модели. Например, наклейка на знак «Стоп» заставляет модель распознать его как «Ограничение скорости 80». Методы: FGSM (Fast Gradient Sign Method) и PGD (Projected Gradient Descent).

Защита: adversarial training (обучение на состязательных примерах), defensive distillation (сглаживание выходов) и градиентная маскировка (скрытие градиентов).

FGSM

Простой метод: добавляет шум в направлении градиента функции потерь. Быстро, но не всегда эффективно против сложных атак.

PGD

Итеративный метод, который на каждом шаге делает маленький шаг в направлении градиента и проецирует результат на допустимую область. Считается одним из самых сильных состязательных атак.

Adversarial training

Добавление состязательных примеров в обучающую выборку. Это повышает устойчивость, но может снижать точность на чистых данных и требует значительных вычислительных ресурсов.

Атаки отравления (poisoning attacks)

Вредоносные данные внедряются в обучающую выборку, чтобы модель вела себя определённым образом (backdoor attacks) или ухудшала общую производительность. Защита: фильтрация выбросов, robust statistics и дифференциальная приватность.

Backdoor attacks

Атакующий добавляет образцы с триггером (например, жёлтый квадрат) и целевой меткой. Модель обучается распознавать триггер, и при его появлении выдаёт заданный результат.

Data sanitization

Очистка данных от выбросов и подозрительных образцов. Методы: статистические тесты, кластеризация, проверка на соответствие распределению.

Robust aggregation

При федеративном обучении агрегация градиентов может быть атакована. Методы Krum, Trimmed Mean и Median устойчивы к выбросам.

Атаки на конфиденциальность (privacy attacks)

Membership inference определяет, использовался ли конкретный образец в обучении. Model inversion восстанавливает обучающие данные из модели. Защита: дифференциальная приватность, ограничение числа запросов к API и аудит приватности.

Membership inference attack

Атакующий проверяет, насколько уверенно модель предсказывает для данного образца. Если уверенность высока, образец, вероятно, был в обучающей выборке.

Model inversion attack

Атакующий оптимизирует входные данные так, чтобы максимизировать уверенность модели для целевого класса. Результат — изображение, похожее на обучающие образцы.

Аудит приватности

Регулярная проверка модели на уязвимости к атакам приватности. Инструменты: TensorFlow Privacy, Opacus.

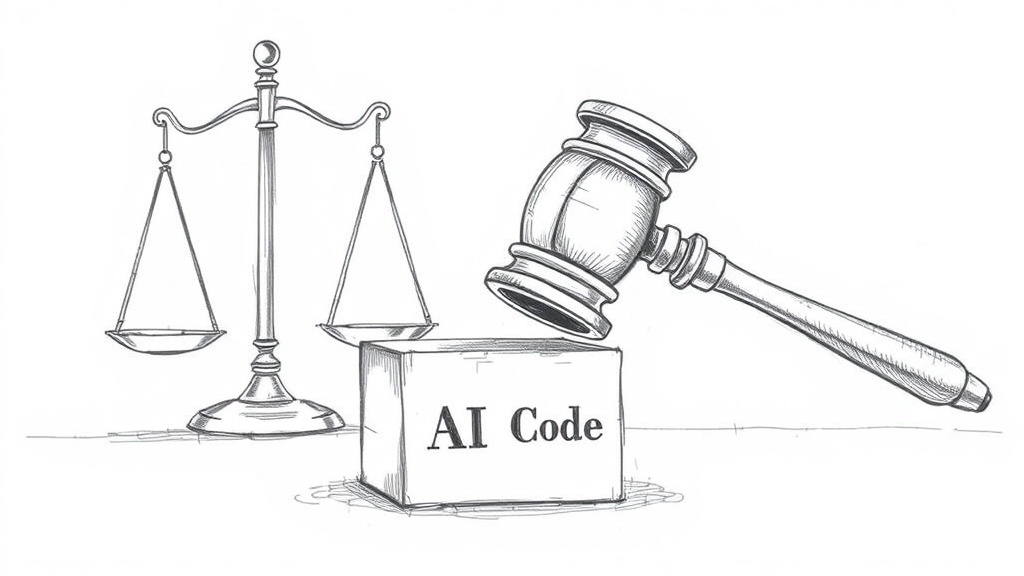

Регуляторные рамки и стандарты для ИИ-кода

Регулирование ИИ быстро развивается. Основные игроки: ЕС (AI Act, GDPR), США (Blueprint for an AI Bill of Rights), Китай (законы об алгоритмах). Стандарты: ISO/IEC 42001 (менеджмент ИИ), NIST AI RMF (управление рисками).

Важно: AI Act вводит категории риска: неприемлемый, высокий, ограниченный, минимальный. Высокорисковые системы должны соответствовать строгим требованиям, включая техническую документацию и человеческий надзор.

AI Act Европейского Союза

AI Act — первый комплексный закон об ИИ. Он классифицирует системы по риску и накладывает обязательства на поставщиков и пользователей. Высокорисковые системы (например, в здравоохранении, кредитовании, правоохранительной деятельности) должны пройти оценку соответствия.

Неприемлемый риск (запрет)

Запрещены системы социального скоринга, манипулятивные ИИ, системы удалённой биометрической идентификации в реальном времени в публичных местах (с исключениями).

Высокий риск (обязательства)

Требуется: система управления рисками, техническая документация, человеческий надзор, точность и кибербезопасность. Обязательна регистрация в базе ЕС.

Ограниченный риск (прозрачность)

Системы, которые взаимодействуют с людьми (чат-боты), должны уведомлять, что пользователь общается с ИИ. Также требуется маркировка контента, созданного ИИ.

Минимальный риск (кодекс поведения)

Остальные системы могут следовать добровольным кодексам поведения. Большинство современных ИИ-ассистентов, таких как Copilot, попадают в эту категорию.

GDPR и ИИ: обработка персональных данных

GDPR применяется ко всем ИИ-системам, обрабатывающим персональные данные граждан ЕС. Ключевые принципы: минимизация данных, право на забвение, право на объяснение. Особые проблемы: автоматизированное принятие решений (ст. 22) и трансграничная передача.

Автоматизированное принятие решений (ст. 22)

Лицо имеет право не подвергаться решению, основанному исключительно на автоматизированной обработке, если оно влечёт юридические последствия. Исключения: необходимость для договора, разрешение законом, явное согласие.

Оценка воздействия на защиту данных (DPIA)

Для высокорисковых систем требуется DPIA. Она оценивает риски для прав и свобод, описывает меры защиты и минимизации.

Трансграничная передача данных

Передача данных за пределы ЕС возможна только при адекватном уровне защиты (решения об адекватности, SCC, BCR).

Стандарты безопасности и управления рисками ИИ

ISO/IEC 42001 и NIST AI RMF предоставляют фреймворки для управления рисками и соответствия. Они помогают организациям систематически подходить к этике и безопасности.

ISO/IEC 42001: структура и требования

Стандарт определяет требования к системе менеджмента ИИ (AIMS). Включает: контекст организации, лидерство, планирование, поддержка, операционная деятельность, оценка эффективности, улучшение.

NIST AI RMF: функции

Фреймворк состоит из четырёх функций: GOV (управление) — политики и процессы; MAP (карта) — идентификация рисков; MEASURE (измерение) — оценка; MANAGE (управление) — обработка рисков.

Соответствие и сертификация

Сертификация по ISO 42001 или соответствие NIST AI RMF может быть конкурентным преимуществом и требованием для работы с госзаказом.

Ограничения современных ИИ-систем и границы ответственности

Даже самые продвинутые ИИ имеют фундаментальные ограничения: отсутствие понимания, переобучение, неспособность к обобщению. Это порождает вопросы ответственности: кто виноват, если ИИ ошибается?

Важно: ИИ не является юридическим лицом, поэтому ответственность всегда лежит на человеке или организации.

Фундаментальные ограничения ИИ

Современный ИИ — это системы, обученные на данных. Они не понимают смысла, не обладают здравым смыслом и хрупки к изменениям. Примеры: переобучение (модель запоминает шум), концептуальный дрейф (данные меняются со временем), неспособность к обобщению на новые сценарии.

Переобучение и недообучение

Переобучение — модель слишком точно подстраивается под обучающие данные, теряя обобщающую способность. Недообучение — модель слишком проста и не улавливает закономерности.

Концептуальный дрейф

Распределение данных меняется со временем, и модель, обученная на старых данных, начинает ошибаться. Требуется постоянный мониторинг и переобучение.

Неспособность к здравому смыслу

ИИ может давать абсурдные ответы, если контекст выходит за рамки обучающих данных. Это особенно опасно в критических приложениях.

Юридическая ответственность за действия ИИ

Ответственность может лежать на производителе (дефектный продукт), операторе (неправильное использование) или пользователе (сознательное нарушение). Концепция «агента» и «инструмента» различает, действует ли ИИ автономно или как инструмент.

Ответственность производителя

Если ИИ-система имеет дефект (например, предвзятый алгоритм), производитель может быть привлечён к ответственности по директиве о дефектных продуктах. AI Liability Directive уточняет эти правила.

Ответственность оператора

Оператор (компания, использующая ИИ) несёт ответственность за последствия, если не обеспечил надлежащий контроль и оценку рисков.

AI Liability Directive

Эта директива ЕС облегчает доказывание причинно-следственной связи между действием ИИ и ущербом. Она вводит презумпцию причинности в некоторых случаях.

Практические рекомендации по внедрению этичного и безопасного ИИ

Теория важна, но без практики она бесполезна. Вот конкретные шаги для организаций, которые хотят внедрить ответственный ИИ.

Совет: Начните с оценки рисков и классификации ИИ-систем по уровню воздействия. Это позволит расставить приоритеты и не пытаться объять необъятное.

Создание системы управления этикой ИИ

Этический комитет, политики и процедуры — основа ответственного ИИ. Комитет должен включать представителей разных отделов: юристов, разработчиков, продуктовых менеджеров и специалистов по этике.

Формирование этического комитета

Комитет рассматривает спорные случаи, утверждает политики и проводит аудит. Важно, чтобы он имел реальные полномочия, а не был формальным органом.

Разработка внутренних политик

Политики должны охватывать: сбор и использование данных, разработку моделей, тестирование, развёртывание, мониторинг и реагирование на инциденты. Они должны быть доступны всем сотрудникам.

Обучение и повышение осведомлённости

Все, кто работает с ИИ, должны понимать основы этики и безопасности. Регулярные тренинги и воркшопы помогают сформировать культуру ответственного ИИ.

Технические меры безопасности и приватности

Применяйте технические методы защиты на всех этапах. Используйте adversarial training для устойчивости, федеративное обучение для чувствительных данных и MLOps для мониторинга.

Adversarial training в production

Включайте состязательные примеры в процесс обучения. Для production используйте автоматическую генерацию таких примеров и валидацию.

Федеративное обучение для чувствительных данных

Если данные нельзя передавать на сервер (медицина, финансы), используйте федеративное обучение. Оно снижает риски утечек, но требует защиты от атак на агрегацию.

MLOps: мониторинг и валидация моделей

Внедрите CI/CD для моделей. Мониторинг дрейфа данных, производительности и безопасности. Автоматические оповещения при отклонениях.

Юридический комплаенс и документирование

Подготовьтесь к проверкам заранее. Ведите техническую документацию, журналы и оценки воздействия. Это сэкономит время и деньги при аудите.

Техническая документация по AI Act

Для высокорисковых систем требуется описание: назначения, архитектуры, данных, метрик, процедур тестирования и мер безопасности. Шаблоны можно найти в стандартах.

Оценка воздействия на защиту данных (DPIA)

Проводите DPIA для всех систем, обрабатывающих персональные данные. Документируйте риски и меры. Обновляйте при изменениях.

Аудит и сертификация

Периодически проводите внутренние и внешние аудиты. Сертификация по ISO 42001 или соответствие NIST AI RMF повышает доверие клиентов и партнёров.

Заключение: будущее регулирования ИИ-кода

Регулирование ИИ будет только ужесточаться. Глобальная гармонизация законов, развитие стандартов и общественное давление заставят компании интегрировать этику и безопасность в процессы разработки. Ответственный ИИ — это не ограничение, а конкурентное преимущество.

Важно: Ответственный ИИ — это не ограничение, а конкурентное преимущество. Компании, которые внедряют этику и безопасность раньше других, получают доверие клиентов и избегают штрафов.

Тренды и вызовы

Гармонизация законов между юрисдикциями — сложная задача, но без неё глобальный бизнес столкнётся с фрагментацией. Развитие методов верификации и валидации сделает ИИ более надёжным. Этический ИИ становится брендом — компании, которые демонстрируют приверженность ответственным практикам, выигрывают в конкурентной борьбе.

Гармонизация законов между юрисдикциями

Разные страны вводят свои законы, что создаёт сложности для международных компаний. Ожидается появление общих принципов и взаимного признания сертификатов.

Развитие методов верификации и валидации

Инструменты для проверки моделей на предвзятость, безопасность и соответствие станут стандартом. Формальная верификация (доказательство свойств) может стать обязательной для высокорисковых систем.

Этический ИИ как бренд

Потребители всё больше обращают внимание на этичность продуктов. Компании, которые публично отчитываются о своих практиках и получают сертификаты, получают лояльность клиентов.

Для тех, кто хочет глубже разобраться в инструментах разработки ИИ, рекомендуем прочитать статью Cursor: что это такое и как работает инструмент для работы с базами данных. А если вас интересует, как стиль программирования влияет на качество кода, обратите внимание на Особенности вайб-кодинга: от рабочего настроя до стиля программирования.

Часто задаваемые вопросы

Что такое этичный ИИ?

Этичный ИИ — это подход к разработке и использованию искусственного интеллекта, который учитывает принципы справедливости, прозрачности, конфиденциальности, безопасности и подотчётности. Он направлен на минимизацию вреда и максимизацию пользы для общества.

Какие основные риски безопасности ИИ-систем?

Основные риски: состязательные атаки (искажение входных данных), атаки отравления (вредоносные данные в обучении), атаки на конфиденциальность (утечка данных через модель), а также концептуальный дрейф и переобучение.

Что такое AI Act и как он влияет на разработчиков?

AI Act — закон ЕС, классифицирующий ИИ-системы по уровню риска. Для высокорисковых систем он требует управления рисками, технической документации, человеческого надзора и соответствия стандартам. Разработчики должны учитывать эти требования на этапе проектирования.

Как GDPR применяется к ИИ?

GDPR требует минимизации данных, права на объяснение, оценки воздействия (DPIA) и ограничений на автоматизированное принятие решений (ст. 22). ИИ-системы, обрабатывающие персональные данные, должны соответствовать этим принципам.

Кто несёт ответственность за ошибки ИИ?

Ответственность может лежать на производителе (дефектный продукт), операторе (неправильное использование) или пользователе (сознательное нарушение). AI Liability Directive облегчает доказывание причинно-следственной связи. ИИ не является юридическим лицом, поэтому ответственность всегда на человеке или организации.

Какие стандарты помогают управлять рисками ИИ?

Основные стандарты: ISO/IEC 42001 (система менеджмента ИИ) и NIST AI Risk Management Framework (управление рисками). Они предоставляют структурированный подход к идентификации, оценке и обработке рисков.

Что такое дифференциальная приватность и зачем она нужна?

Дифференциальная приватность — это метод, который добавляет шум в данные или градиенты, чтобы защитить конфиденциальность отдельных записей. Она нужна, чтобы предотвратить утечку данных через модели и атаки membership inference.

Как бороться с предвзятостью в алгоритмах?

Методы: ресэмплинг данных, корректировка весов, использование метрик справедливости (demographic parity, equal opportunity), инструменты детекции (IBM AI Fairness 360, Google What-If Tool) и регулярный аудит моделей.

Какие ограничения у современных ИИ-систем?

Фундаментальные ограничения: отсутствие понимания и здравого смысла, переобучение, концептуальный дрейф, хрупкость к состязательным атакам, зависимость от данных. ИИ не способен к обобщению за пределами обучающего распределения.

С чего начать внедрение ответственного ИИ в компании?

Начните с оценки рисков и классификации ИИ-систем. Создайте этический комитет, разработайте внутренние политики, обучите персонал. Внедрите технические меры (adversarial training, федеративное обучение) и юридический комплаенс (документация, DPIA).