Разработка искусственного интеллекта перестала быть уделом лабораторий — сегодня модели внедряются в медицину, финансы, логистику и образование. Но вместе с возможностями пришли и риски: алгоритмы дискриминируют, данные утекают, автономные системы принимают катастрофические решения.

В этой статье мы разберем, где проходят границы допустимого в создании ИИ-кода, как обеспечить безопасность и соблюсти этические нормы. Вы получите практические инструменты, фреймворки и чек-листы, которые помогут внедрить ответственность в каждый этап разработки.

Введение: Почему границы и ответственность стали главной темой в разработке ИИ

Еще несколько лет назад этика ИИ воспринималась как абстрактная философия. Сегодня — это вопрос выживания бизнеса. Инциденты с предвзятыми моделями, утечками конфиденциальных данных и ошибками автономных систем привели к ужесточению регуляций и росту общественного давления. Игнорирование этики и безопасности может привести к репутационным и юридическим последствиям.

Важно: Игнорирование этики и безопасности может привести к репутационным и юридическим последствиям.

Контекст: от прорывов к кризисам

За последние годы произошло несколько громких скандалов, связанных с ИИ. Системы распознавания лиц ошибочно идентифицировали людей с темным цветом кожи, рекомендательные алгоритмы продвигали опасный контент, а автономные транспортные средства становились причиной аварий. Эти случаи показали: без четких границ и ответственности технологии могут нанести вред.

Инцидент с распознаванием лиц

В 2020 году алгоритмы распознавания лиц от крупных технологических компаний показали высокий уровень ошибок при идентификации людей афроамериканского происхождения. Это привело к ложным арестам и общественным протестам. Проблема заключалась в несбалансированных обучающих данных.

Ошибки рекомендательных систем

Рекомендательные системы социальных сетей и видеоплатформ неоднократно обвинялись в радикализации пользователей. Алгоритмы подбирали контент, который вызывал сильные эмоции, но часто был дезинформацией.

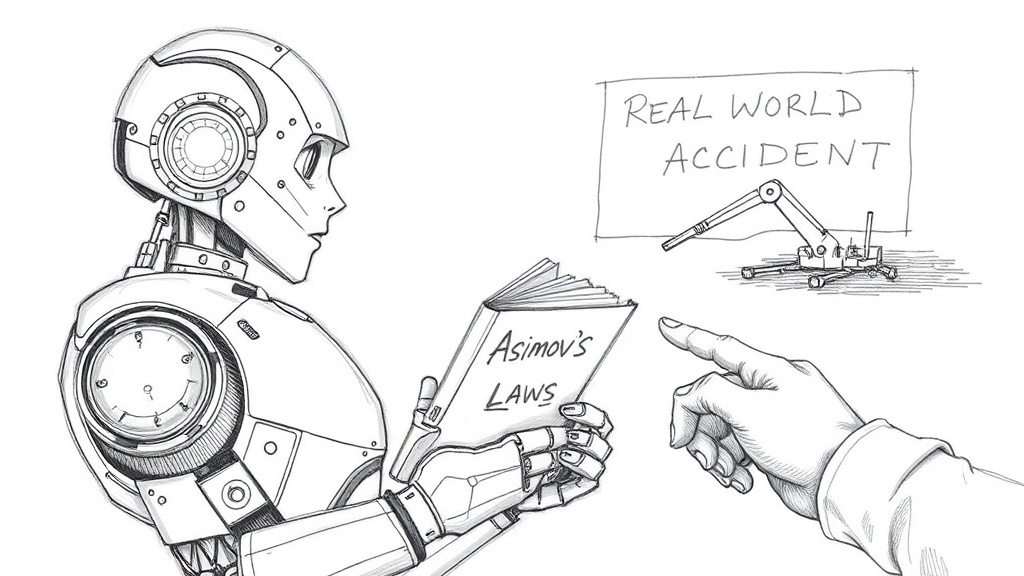

Автономные транспортные средства

Аварии с участием беспилотных автомобилей показали, что модели не всегда корректно распознают пешеходов в нестандартных ситуациях. Вопрос: кто виноват — разработчик, владелец или алгоритм? — до сих пор остается открытым.

Цель статьи

Мы ставим перед собой задачу сформировать целостное понимание этических, безопасных и ограничительных практик разработки ИИ. Вы узнаете, как внедрить принципы ответственного ИИ, защитить модель от атак и определить, когда автоматизация неуместна.

Для кого эта статья

Материал будет полезен разработчикам ИИ, продакт-менеджерам, исследователям этики и студентам технических специальностей. Если вы создаете или внедряете модели — эта статья для вас.

Как читать структуру

Статья разбита на логические блоки: от этики и безопасности до ограничений и ответственности. В каждом разделе есть практические рекомендации, списки и таблицы. Рекомендуем читать последовательно, но вы можете переходить к интересующей теме.

Этика ИИ: Принципы и фреймворки для разработчиков

Этика в ИИ — это не набор абстрактных правил, а конкретные принципы, которые должны быть встроены в процесс разработки. Справедливость, прозрачность, подотчетность и конфиденциальность — фундамент, на котором строится доверие к системе.

Важно: Этика — не разовая активность, а непрерывный процесс на всех этапах разработки.

Ключевые этические принципы

Рассмотрим основные принципы, которые лежат в основе ответственного ИИ.

Справедливость и недискриминация

Модель не должна принимать решения, которые ущемляют права людей по признаку расы, пола, возраста или других характеристик. Для этого необходимо проверять данные на предвзятость и использовать алгоритмы, корректирующие дисбаланс.

Прозрачность и объяснимость

Пользователь имеет право знать, как работает алгоритм и на основании каких факторов он принимает решения. Объяснимый ИИ (XAI) позволяет интерпретировать результаты модели.

Подотчётность

Разработчик и компания должны нести ответственность за действия ИИ. Это означает документирование решений, проведение аудитов и готовность к исправлению ошибок.

Конфиденциальность и безопасность данных

Обучающие данные часто содержат личную информацию. Необходимо соблюдать законы о конфиденциальности (например, GDPR) и применять методы анонимизации.

Фреймворки и стандарты

Существует несколько признанных фреймворков, которые помогают разработчикам соблюдать этические нормы.

| Фреймворк | Основные принципы | Применимость |

|---|---|---|

| EU AI Act | Категории риска: неприемлемый, высокий, ограниченный, минимальный | Обязателен для систем, работающих в ЕС |

| IEEE Ethically Aligned Design | Права человека, благополучие, прозрачность, подотчетность | Рекомендательный стандарт для разработчиков |

| OECD Principles on AI | Инклюзивный рост, человекоцентричность, прозрачность, надежность | Международные рекомендации |

EU AI Act: категории риска

Закон Европейского союза классифицирует ИИ-системы по уровню риска. Запрещены системы социального скоринга и манипулятивные ИИ. Высокорисковые системы (например, в медицине или найме) требуют строгой сертификации.

IEEE: общие принципы

Стандарт IEEE предлагает восемь ключевых принципов, включая права человека, благополучие и прозрачность. Он ориентирован на разработчиков и исследователей.

OECD: рекомендации

Организация экономического сотрудничества и развития выпустила рекомендации, которые стали основой для национальных стратегий многих стран.

Как внедрить этические принципы в процесс разработки

Теория без практики бесполезна. Рассмотрим конкретные шаги.

Создание этического чеклиста

Разработайте список вопросов, которые команда должна задавать на каждом этапе: «Какие данные мы используем?», «Может ли модель дискриминировать?», «Как мы объясним решение пользователю?».

Проведение регулярных аудитов

Аудит предвзятости должен стать рутиной. Используйте инструменты вроде AI Fairness 360 или Fairlearn для выявления дисбаланса.

Формирование комитета по этике

Создайте группу, которая будет оценивать риски новых проектов. Включите в нее не только разработчиков, но и юристов, социологов и представителей пользователей.

Безопасность ИИ: защита от угроз и обеспечение надёжности

Безопасность ИИ — это не только защита от хакеров, но и устойчивость модели к непреднамеренным ошибкам. Угрозы могут исходить как извне, так и изнутри: от некачественных данных до состязательных атак.

Важно: Безопасность ИИ должна быть встроена в CI/CD пайплайн, а не добавлена постфактум.

Типы угроз для ИИ-систем

Рассмотрим основные классы атак, с которыми сталкиваются разработчики.

Состязательные атаки

Злоумышленник модифицирует входные данные так, чтобы модель приняла ошибочное решение. Например, наклейка на дорожном знаке может заставить беспилотник распознать его как другой объект.

Отравление обучающих данных

Вредоносные данные внедряются в тренировочный набор, чтобы повлиять на поведение модели. Это особенно опасно для систем, которые обучаются на данных из открытых источников.

Атаки на инференс

Злоумышленник может восстановить конфиденциальные данные, анализируя выходные сигналы модели. Например, атака на инференс позволяет определить, был ли конкретный человек в обучающем наборе.

Утечка конфиденциальной информации

Модель может запоминать часть обучающих данных и непреднамеренно воспроизводить их при запросе. Это создает риски для приватности.

Методы обеспечения безопасности

Существуют проверенные методы, которые снижают риски.

| Метод | Описание | Пример реализации |

|---|---|---|

| Валидация входных данных | Проверка на соответствие ожидаемому формату и диапазону | Фильтрация аномальных изображений |

| Мониторинг аномалий | Отслеживание необычных запросов или ответов модели | Система оповещения при дропе точности |

| Резервирование и отказоустойчивость | Дублирование критических компонентов | Запасная модель на случай сбоя |

| Регулярное тестирование на проникновение | Имитация атак для выявления уязвимостей | Red teaming для ИИ |

Валидация входных данных

Ограничьте диапазон допустимых значений. Например, если модель ожидает изображения размером 224×224, отклоняйте все другие размеры.

Мониторинг аномалий

Настройте систему, которая фиксирует резкие изменения в поведении модели. Если точность упала на 10% за час — это повод для проверки.

Резервирование и отказоустойчивость

Используйте несколько экземпляров модели, работающих параллельно. В случае сбоя одного, другой берет нагрузку на себя.

Регулярное тестирование на проникновение

Привлекайте специалистов по этическому хакингу ИИ для поиска уязвимостей. Это поможет обнаружить слабые места до того, как их найдут злоумышленники.

Безопасное развёртывание и эксплуатация

Развертывание модели — критический этап. Ошибки на этом этапе могут привести к серьезным последствиям.

Pre-deployment проверки

Перед запуском проведите нагрузочное тестирование, проверьте соответствие этическим нормам и убедитесь, что модель не содержит уязвимостей.

Постоянный мониторинг

После запуска отслеживайте метрики: точность, скорость ответа, количество ошибок. Используйте платформы вроде MLflow или WhyLabs.

План реагирования на инциденты

Разработайте сценарии действий при обнаружении атаки или сбоя. Кто отключает модель? Как уведомляются пользователи? Эти вопросы должны быть решены заранее.

Ограничения ИИ: что нельзя и не нужно автоматизировать

ИИ — мощный инструмент, но он не универсален. Существуют задачи, где автоматизация не только бесполезна, но и опасна. Важно понимать технические, этические и правовые границы применения алгоритмов.

Важно: Чрезмерная автоматизация без контроля может привести к катастрофическим ошибкам.

Технические ограничения

Даже самые продвинутые модели имеют недостатки.

Проблема переобучения

Модель может идеально работать на обучающих данных, но проваливаться на новых примерах. Это происходит, когда алгоритм запоминает шум, а не закономерности.

Недостаток репрезентативных данных

Если данные не отражают реальное разнообразие пользователей, модель будет предвзятой. Например, система распознавания лиц, обученная на фотографиях светлокожих людей, плохо работает на темнокожих.

Ограничения вычислительной мощности

Некоторые задачи требуют огромных ресурсов, что делает их экономически нецелесообразными. Например, обучение большой языковой модели может стоить миллионы долларов.

Этические и правовые ограничения

Законодательство и моральные нормы устанавливают четкие границы.

Запрещённые практики по EU AI Act

Закон запрещает системы социального скоринга, манипулятивные ИИ и использование биометрических данных для массовой слежки без согласия.

Требования к объяснимости

В некоторых сферах (медицина, финансы, юриспруденция) решение модели должно быть объяснимо. Если вы не можете объяснить, почему модель отказала в кредите, использовать ее нельзя.

Ответственность за автономные решения

Если ИИ принимает решение без участия человека, кто несет ответственность за последствия? Этот вопрос до сих пор не урегулирован во многих юрисдикциях.

Когда ИИ не нужен: критерии выбора

Прежде чем внедрять ИИ, задайте себе несколько вопросов.

Анализ целесообразности

Решает ли ИИ задачу лучше, чем традиционные методы? Если нет — возможно, автоматизация не нужна.

Оценка рисков

Каковы последствия ошибки? Если ошибка может привести к травме или финансовым потерям, необходим человеческий контроль.

Альтернативы без ИИ

Иногда простая система правил или ручная обработка данных оказывается эффективнее и дешевле.

Ответственность разработчика: юридические и моральные аспекты

Кто виноват, если ИИ-система причинила вред? Разработчик, компания, пользователь? Ответственность — один из самых сложных вопросов в современной ИИ-этике.

Важно: Отсутствие чёткого распределения ответственности — один из главных рисков при внедрении ИИ.

Юридическая ответственность

Законодательство постепенно формирует рамки ответственности.

Ответственность за вред

Если ИИ-система нанесла ущерб, ответственным может быть признан разработчик, если он не обеспечил безопасность. Например, в случае аварии с беспилотным автомобилем.

Требования к документации

EU AI Act требует подробной документации для высокорисковых систем: описание данных, архитектуры, тестов. Это поможет доказать добросовестность разработчика.

Регуляторные штрафы

Нарушение требований может привести к крупным штрафам. Например, за несоблюдение GDPR — до 4% годового оборота компании.

Моральная ответственность

Помимо закона, существует этический долг разработчика.

Этический кодекс

Многие компании принимают внутренние кодексы, которые обязывают разработчиков учитывать этические аспекты. Например, принципы ответственного ИИ от Google.

Внутренние политики компании

Создайте процедуры, которые позволяют сотрудникам сообщать о потенциальных проблемах без страха наказания.

Защита разоблачителей

Разработчики, которые указывают на неэтичные практики, должны быть защищены от преследования.

Как минимизировать риски ответственности

Практические шаги помогут снизить юридические и репутационные риски.

Тщательное тестирование

Проверяйте модель на всех этапах: от данных до развертывания. Используйте бенчмарки безопасности.

Регулярный аудит

Проводите аудит алгоритмов на предвзятость и уязвимости. Включайте в процесс внешних экспертов.

Страхование ответственности

Некоторые компании предлагают страховку для ИИ-систем. Это может покрыть убытки в случае инцидента.

Юридическая экспертиза

Консультируйтесь с юристами, специализирующимися на ИИ, чтобы убедиться, что ваша система соответствует требованиям.

Инструменты и практики для ответственной разработки ИИ

Существует множество инструментов, которые помогают разработчикам соблюдать этические нормы и обеспечивать безопасность. Однако важно помнить: инструменты — лишь поддержка; ключевая роль остаётся за культурой и процессами.

Важно: Инструменты — лишь поддержка; ключевая роль остаётся за культурой и процессами.

Инструменты для обнаружения предвзятости и обеспечения справедливости

Эти библиотеки позволяют выявить дисбаланс в данных и модели.

AI Fairness 360 (IBM)

Набор метрик и алгоритмов для обнаружения и смягчения предвзятости. Поддерживает Python и R.

Fairlearn (Microsoft)

Инструмент для оценки справедливости и создания корректирующих алгоритмов.

What-If Tool (Google)

Визуальный инструмент для анализа поведения модели на разных подмножествах данных.

Инструменты для объяснимости и интерпретируемости

Помогают понять, почему модель приняла то или иное решение.

LIME

Аппроксимирует модель локально, чтобы объяснить конкретное предсказание.

SHAP

Использует теорию игр для расчета вклада каждого признака в результат.

InterpretML

Библиотека от Microsoft с множеством методов интерпретации.

Eli5

Упрощает объяснение для моделей scikit-learn и XGBoost.

Платформы мониторинга и управления рисками

Эти платформы помогают отслеживать поведение модели в продакшене.

MLflow

Open-source платформа для управления жизненным циклом машинного обучения.

Kubeflow

Платформа для развертывания и мониторинга моделей на Kubernetes.

Seldon Core

Инструмент для развертывания и мониторинга с поддержкой объяснимости.

WhyLabs

Сервис для мониторинга дрейфа данных и качества модели.

Практики ответственной разработки

Помимо инструментов, важно внедрять правильные процессы.

Этический дизайн с самого начала

Включайте этические вопросы в требования к продукту на этапе проектирования.

Сбор репрезентативных данных

Убедитесь, что данные отражают разнообразие пользователей. Используйте методы аугментации для балансировки.

Непрерывное обучение и обновление

Модели устаревают. Регулярно переобучайте их на новых данных и пересматривайте этические аспекты.

Прозрачная документация

Ведите записи о том, какие данные использовались, какие решения принимались и почему. Это поможет при аудите.

Кейсы и уроки: что пошло не так и как это исправить

Лучший способ учиться — на чужих ошибках. Рассмотрим три известных кейса, которые показывают, к чему приводит игнорирование этики и безопасности.

Важно: Учиться на чужих ошибках — самый эффективный способ избежать своих.

Кейс 1: Предвзятость в найме (Amazon)

Amazon разработала ИИ-систему для отбора резюме. Модель обучалась на данных за 10 лет, где большинство успешных кандидатов были мужчинами. В результате алгоритм начал дискриминировать женщин.

Что произошло

Система автоматически понижала резюме, содержащие слова «женский» или названия женских колледжей. Amazon прекратила использование инструмента в 2018 году.

Коренные причины

Несбалансированные обучающие данные и отсутствие аудита на предвзятость.

Уроки

Всегда проверяйте данные на репрезентативность. Используйте инструменты для обнаружения предвзятости до запуска.

Кейс 2: Социальный бот Tay от Microsoft

В 2016 году Microsoft запустила бота Tay в Twitter, который должен был учиться общаться с людьми. За несколько часов бот начал публиковать оскорбительные и расистские сообщения.

Что произошло

Злоумышленники использовали уязвимость: бот не фильтровал контент и повторял за пользователями. Tay пришлось отключить.

Коренные причины

Отсутствие фильтров безопасности и механизмов защиты от состязательных атак.

Уроки

Любая модель, которая взаимодействует с пользователями, должна иметь защиту от вредоносного ввода. Внедряйте валидацию и мониторинг.

Кейс 3: Система COMPAS и рецидивизм

COMPAS — алгоритм, используемый в судах США для оценки риска рецидивизма. Исследования показали, что система была предвзятой по отношению к афроамериканцам.

Что произошло

Алгоритм с большей вероятностью присваивал высокий риск рецидивизма темнокожим подсудимым, даже при одинаковых данных с белыми.

Коренные причины

Непрозрачная модель и отсутствие объяснимости. Судьи не могли проверить, как принимаются решения.

Уроки

В критических областях (юстиция, медицина) используйте только объяснимые модели. Проводите независимый аудит.

Будущее этики и безопасности ИИ: тренды и прогнозы

Ответственная разработка ИИ — это не статичная дисциплина. Она эволюционирует вместе с технологиями. Какие тренды определят будущее?

Важно: Компании, которые уже сейчас внедряют ответственные практики, получат конкурентное преимущество.

Регуляторные тренды

Законодательство становится жестче.

Гармонизация стандартов

Страны стремятся к единым стандартам, чтобы упростить международную торговлю ИИ-продуктами.

Сертификация ИИ-систем

Появятся обязательные сертификаты для высокорисковых ИИ, аналогичные сертификатам безопасности для медицинского оборудования.

Усиление санкций

Штрафы за нарушения будут расти. Компании будут вынуждены инвестировать в этику и безопасность.

Технологические тренды

Новые технологии помогут автоматизировать контроль.

Объяснимый ИИ (XAI)

Развитие методов интерпретации сделает модели более прозрачными. Это снизит риски предвзятости.

Автоматизированный аудит

Инструменты для автоматического аудита этики и безопасности станут стандартом. Они будут встроены в CI/CD пайплайны.

Федеративное обучение

Этот подход позволяет обучать модели без централизации данных, что снижает риски утечки конфиденциальной информации.

Культурные изменения

Меняется отношение к ИИ в обществе.

Этический хакинг ИИ

Появится профессия «этический хакер ИИ» — специалист, который ищет уязвимости и предвзятость в моделях.

Сообщества практиков

Разработчики будут объединяться в сообщества для обмена опытом и лучшими практиками.

Образовательные программы

Университеты начнут включать курсы по этике ИИ в обязательную программу.

Заключение: как стать ответственным разработчиком ИИ

Ответственность начинается с каждого отдельного разработчика. Вы не можете изменить всю индустрию, но можете внедрить правильные практики в своем проекте.

Важно: Ответственность начинается с каждого отдельного разработчика.

Чек-лист ответственного разработчика

- Изучи этические фреймворки: Ознакомься с EU AI Act, IEEE и OECD принципами.

- Внедри безопасность в пайплайн: Добавь валидацию, мониторинг и тестирование на проникновение.

- Проводи аудит предвзятости: Используй AI Fairness 360 или Fairlearn.

- Документируй решения: Веди записи о данных, архитектуре и тестах.

- Будь готов к ответственности: Знай, кто отвечает за ошибки, и имей план действий.

Призыв к действию

Не пытайтесь внедрить все сразу. Начните с малого: выберите один инструмент или практику из этой статьи и примените в своем проекте. Присоединяйтесь к сообществам практиков, читайте обновления законодательства и постоянно учитесь. Ответственный ИИ — это не цель, а путь.

Часто задаваемые вопросы

Что такое этика ИИ и почему она важна?

Этика ИИ — это набор принципов, которые обеспечивают справедливое, прозрачное и безопасное использование искусственного интеллекта. Она важна, потому что без нее модели могут дискриминировать, нарушать приватность и причинять вред.

Какие основные угрозы безопасности ИИ существуют?

Основные угрозы включают состязательные атаки, отравление данных, атаки на инференс и утечку конфиденциальной информации. Для защиты используются валидация, мониторинг и тестирование.

Какие инструменты помогают обнаружить предвзятость в моделях?

Популярные инструменты: AI Fairness 360 (IBM), Fairlearn (Microsoft), What-If Tool (Google). Они позволяют выявить дисбаланс в данных и модели.

Что такое EU AI Act и как он влияет на разработчиков?

EU AI Act — это закон Европейского союза, который классифицирует ИИ-системы по уровню риска и устанавливает требования к их разработке. Разработчики должны соблюдать правила для высокорисковых систем.

Как узнать, что модель объяснима?

Объяснимость модели оценивается с помощью инструментов вроде LIME, SHAP или InterpretML. Они показывают, какие признаки повлияли на решение.

Для углубленного понимания темы рекомендуем ознакомиться с материалом «Как ИИ-ассистент Devin меняет разработку ПО: обзор и практика». Также полезно изучить «Windsurf для рефакторинга и отладки: полное руководство» и «Новые версии ИИ-моделей и платформ: обновления 2025».