Искусственный интеллект прочно вошел в нашу жизнь: от рекомендаций в соцсетях до диагностики заболеваний. Но за впечатляющими успехами скрываются фундаментальные границы — как технические, так и этические. Эта статья поможет вам разобраться, где проходит черта между возможным и невозможным, допустимым и недопустимым. Вы узнаете, почему даже самый мощный ИИ не может всего, какие риски это несет и как мы можем использовать технологии ответственно.

Введение: почему ИИ не всемогущ?

Каждый день мы слышим о новых прорывах: нейросети пишут тексты, рисуют картины, управляют автомобилями. Создается впечатление, что ИИ может всё. Но это миф. Даже самые продвинутые системы имеют жесткие ограничения, которые делятся на две большие группы: технические (что код не может сделать в принципе) и этические (что код не должен делать по моральным соображениям).

Важно: ИИ — мощный инструмент, но не волшебная палочка. Понимание его ограничений критически важно для ответственного использования.

Миф о всемогущем ИИ

Первый шаг к реалистичному взгляду — развенчать популярные мифы. Нет, ИИ не заменит всех людей. Нет, он не может решить любую задачу. Современные системы — это «узкий ИИ» (narrow AI), обученный для конкретных целей. Они блестяще справляются с распознаванием образов или обработкой языка, но пасуют перед задачами, требующими здравого смысла или настоящего творчества.

Примеры задач, где ИИ бессилен

Попробуйте попросить нейросеть объяснить, почему шутка смешна, или спланировать семейный ужин с учетом настроения гостей. Или возьмите задачу понимания контекста: ИИ может перевести фразу «она закрыла окно» на другой язык, но не поймет, что «окно» — это еще и временной промежуток в расписании. Такие нюансы, очевидные для человека, остаются за гранью возможностей алгоритмов.

Сравнение с человеческим интеллектом

Человеческий интеллект гибок, адаптивен и опирается на жизненный опыт. Мы можем переносить знания из одной области в другую, учиться на единичных примерах, проявлять эмпатию. ИИ же оперирует статистическими закономерностями в данных. Он не понимает смысла, а лишь находит корреляции. Как говорят исследователи, ИИ — это «усилитель интеллекта», а не его замена.

Технические ограничения: что не может код

Технические ограничения — это объективные барьеры, заложенные в самой природе современных алгоритмов. Они не являются «багами» или недоработками, а вытекают из фундаментальных принципов вычислений и математики.

Частая ошибка: Многие думают, что технические ограничения ИИ можно преодолеть простым увеличением вычислительной мощности. На самом деле, многие проблемы (например, интерпретируемость) носят принципиальный характер.

Вычислительная сложность и энергопотребление

Обучение больших языковых моделей, таких как GPT-3, требует колоссальных ресурсов. По оценкам специалистов, на обучение одной такой модели уходят тысячи GPU-часов и миллионы долларов. Это не только дорого, но и наносит вред экологии: выбросы CO2 от обучения крупной модели сопоставимы с выбросами нескольких автомобилей за весь срок их службы (источник: исследование Университета Массачусетса, 2019).

Затраты на обучение и инференс

Но даже после обучения работа модели (инференс) тоже требует энергии. Каждый запрос к ChatGPT потребляет электричество, и при массовом использовании нагрузка на серверы становится огромной. Закон Мура, который долгое время обеспечивал рост производительности чипов, замедляется. Это значит, что мы упираемся в физические пределы кремниевых технологий.

Экологический след ИИ

По данным исследований, выбросы углерода от обучения одной нейросети могут достигать 300 тонн CO2. Это эквивалентно годовому выбросу десятков автомобилей. Крупные компании, такие как Google и Microsoft, уже инвестируют в «зеленые» дата-центры, но проблема остается острой.

Проблема данных: качество, количество и смещение

ИИ учится на данных. Если данные плохие — результат будет плохим. Это аксиома машинного обучения. Основные проблемы с данными включают несбалансированные выборки, шум, отсутствие разметки и устаревшие данные.

Предвзятость данных (data bias)

Самый известный пример — алгоритмы распознавания лиц, которые хуже работают на людях с темным цветом кожи, потому что обучались преимущественно на фотографиях белых людей. Или системы найма, которые дискриминировали женщин, так как исторические данные содержали больше резюме мужчин. Такая предвзятость (bias) может закреплять и усиливать социальное неравенство.

Аугментация и синтетические данные

Чтобы бороться с нехваткой данных, используют аугментацию (искусственное изменение существующих данных, например, поворот изображения) или генерацию синтетических данных. Но это не панацея: синтетические данные могут не отражать реальные закономерности.

Конфиденциальность и GDPR

Сбор данных для обучения ИИ часто вступает в конфликт с правом на приватность. Регуляции, такие как GDPR в Европе, требуют согласия пользователя и права на удаление данных. Это накладывает серьезные ограничения на то, какие данные можно использовать и как их хранить.

Неспособность к обобщению и адаптации

Современные модели глубокого обучения (deep learning) отлично работают на данных, похожих на обучающие. Но стоит изменить распределение данных (out-of-distribution) — и модель может дать сбой. Например, нейросеть, обученная распознавать собак на фотографиях, может не узнать ту же собаку, если ее снять под другим углом или в другой освещенности.

Переобучение и как с ним борются

Переобучение (overfitting) — это когда модель запоминает обучающие данные наизусть, вместо того чтобы выявить общие закономерности. Борются с этим с помощью регуляризации, dropout и увеличения объема данных. Но полностью избежать переобучения сложно.

Transfer learning и few-shot learning

Для улучшения обобщения используют transfer learning (перенос обучения с одной задачи на другую) и few-shot learning (обучение по нескольким примерам). Эти методы помогают, но не решают проблему полностью. ИИ по-прежнему далек от человеческой способности учиться на единичных случаях.

Проблема «черного ящика» и интерпретируемость

Многие мощные модели, особенно глубокие нейросети, работают как «черный ящик»: мы видим вход и выход, но не понимаем, что происходит внутри. Это критично для областей, где решение должно быть объяснимо: медицина, юриспруденция, финансы.

Методы объяснимого ИИ (XAI)

Объяснимый ИИ (XAI) — это направление, которое пытается сделать модели прозрачными. Например, LIME и SHAP — методы, которые показывают, какие признаки входных данных больше всего повлияли на решение. Но они дают лишь приблизительные объяснения и не всегда надежны.

Компромисс между точностью и интерпретируемостью

Часто более точные модели (глубокие нейросети) менее интерпретируемы, а более простые (линейная регрессия, деревья решений) — более прозрачны, но менее точны. Выбор между ними — это всегда компромисс.

Уязвимость к атакам и состязательным примерам

ИИ можно обмануть. Состязательные примеры (adversarial examples) — это небольшие, часто незаметные для человека изменения во входных данных, которые заставляют модель ошибаться. Например, наклейка на дорожном знаке «STOP» может заставить систему распознавания классифицировать его как знак «ограничение скорости».

Типы атак (white-box, black-box)

Атаки бывают white-box (когда злоумышленник знает архитектуру модели) и black-box (когда он может только отправлять запросы и получать ответы). Black-box атаки сложнее, но возможны. Например, можно обмануть систему распознавания лиц, надев специальные очки.

Методы защиты (adversarial training)

Для защиты используют adversarial training — обучение на состязательных примерах, чтобы модель стала устойчивее. Но это не гарантирует полной безопасности: злоумышленники постоянно находят новые уязвимости.

Этические ограничения: что нельзя коду

Этические ограничения — это не технические, а моральные и социальные барьеры. Даже если ИИ технически способен выполнить задачу, это не значит, что его следует использовать. Этические дилеммы ИИ касаются каждого из нас.

«Этические ограничения не менее важны, чем технические. Они определяют, как мы хотим использовать ИИ в обществе.» — из доклада ЮНЕСКО по этике ИИ.

Предвзятость и дискриминация

Алгоритмы могут усиливать существующие предрассудки. Системы найма, кредитные рейтинги, алгоритмы правосудия — все они могут дискриминировать по расовому, половому или возрастному признаку.

Примеры из реальной жизни

Система COMPAS, используемая в судах США для оценки риска рецидива, оказалась предвзятой против афроамериканцев. Алгоритм найма Amazon был настроен против женщин, потому что обучался на резюме мужчин, которые доминировали в технических должностях. Такие случаи подрывают доверие к ИИ.

Fairness metrics и как их применять

Для оценки справедливости (fairness) разработаны метрики: равенство возможностей, демографический паритет и другие. Но выбор метрики — это этическое решение. Не всегда можно удовлетворить все критерии одновременно.

Прозрачность и подотчетность

Кто отвечает за ошибки ИИ? Разработчик, владелец, пользователь? Юридическая и этическая ответственность — сложный вопрос. Если беспилотный автомобиль сбивает пешехода, кто виноват: производитель, программист, владелец или сама система?

Проблема «автономного оружия»

Особенно остро стоит вопрос об автономных системах вооружения. Может ли машина принимать решение о лишении жизни человека? Большинство экспертов выступают за запрет полностью автономного оружия. Ответственность за применение силы должна оставаться за человеком.

Ответственность в беспилотных автомобилях

В случае аварии с участием беспилотного автомобиля, ответственность может лежать на производителе, если доказана ошибка в алгоритме. Но если авария произошла из-за непредвиденных обстоятельств, вопрос остается открытым. Страховые компании и законодатели только начинают вырабатывать правила.

Конфиденциальность и слежка

ИИ требует данных, а данные часто касаются личной жизни. Массовая слежка, профилирование пользователей, утечки данных — все это реальные риски. Системы распознавания лиц в общественных местах вызывают серьезные опасения у правозащитников.

Технологии анонимизации

Для защиты приватности используют анонимизацию (удаление персональных данных) и дифференциальную приватность (добавление шума, чтобы нельзя было выделить конкретного человека). Но полная анонимизация сложна: часто данные можно деанонимизировать, комбинируя их с другими источниками.

Регуляции (GDPR, CCPA)

GDPR в Европе и CCPA в Калифорнии дают пользователям больше контроля над их данными. Компании обязаны получать согласие на сбор данных и предоставлять возможность их удаления. Это накладывает ограничения на использование ИИ, но и защищает права граждан.

Социальное неравенство и автоматизация

Внедрение ИИ может привести к потере рабочих мест. Автоматизация затрагивает не только физический труд, но и интеллектуальный: бухгалтеров, переводчиков, юристов. Это усиливает социальное неравенство, так как выгоды от ИИ получают владельцы технологий, а риски — работники.

Какие профессии под угрозой

По оценкам экспертов, под угрозой автоматизации находятся до 30% рабочих мест в развитых странах. Это водители, кассиры, операторы колл-центров, но также и некоторые профессии в сфере финансов и права. Однако появляются и новые профессии, связанные с разработкой и обслуживанием ИИ.

Безусловный базовый доход как решение?

Некоторые экономисты предлагают ввести безусловный базовый доход (ББД), чтобы компенсировать потерю рабочих мест. Эксперименты в Финляндии и Канаде показали, что ББД может снизить стресс и повысить качество жизни, но вопрос его финансирования остается спорным.

Этический кодекс и регулирование

Для управления рисками разрабатываются этические кодексы и регуляции. EU AI Act — первый в мире закон, регулирующий ИИ по степени риска. Принципы IEEE и Асиломарские принципы задают этические рамки для разработчиков.

Основные принципы ответственного ИИ

Большинство кодексов включают: прозрачность, справедливость, подотчетность, безопасность, приватность и человеческий контроль. Эти принципы должны быть встроены в процесс разработки с самого начала, а не добавляться постфактум.

Проблемы enforcement и compliance

Главная проблема — как обеспечить соблюдение этических норм. Саморегулирование компаний часто неэффективно. Нужны независимые аудиты алгоритмов, сертификация и жесткие санкции за нарушения. Но пока это только формируется.

Граница возможностей: что ИИ никогда не сможет?

Этот раздел — более философский. Есть ли задачи, принципиально не решаемые ИИ? Вопросы сознания, творчества и морали.

«ИИ не сможет полюбить, понять шутку или пожалеть. Эти качества останутся уникально человеческими.» — Джозеф Вейценбаум, создатель ELIZA.

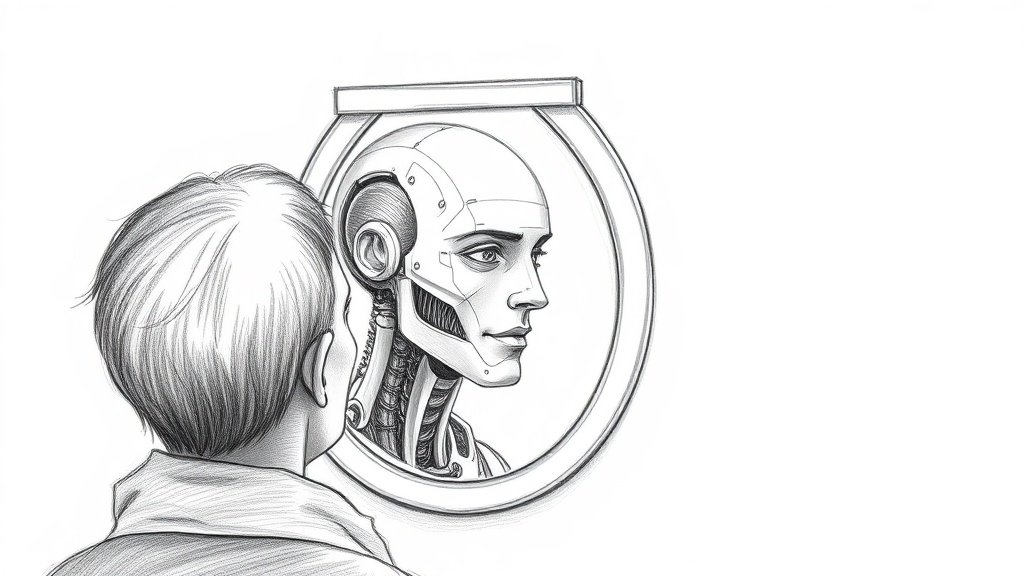

Сознание и субъективный опыт

Может ли ИИ обладать сознанием? Философ Джон Сёрл в мысленном эксперименте «Китайская комната» показал, что следование правилам (даже сложным) не означает понимания. Квалиа — субъективные переживания (боль, цвет, вкус) — возможно, не могут быть воспроизведены машиной.

Аргументы «за» и «против»

Сторонники сильного ИИ (AGI) считают, что сознание может возникнуть из сложности вычислений. Противники указывают, что мозг — не компьютер, а биологическая система с уникальными свойствами. Пока нет научного консенсуса.

Современные исследования машинного сознания

Некоторые исследователи пытаются создать модели, имитирующие аспекты сознания (например, внимание, метапознание). Но до настоящего сознания далеко. Тест Тьюринга, который проверяет, может ли машина имитировать человека, не является тестом на сознание.

Настоящее творчество и интуиция

ИИ может генерировать стихи, музыку, картины. Но есть ли в этом творчество? Нейросети комбинируют существующие элементы, создавая вариации, но не создают принципиально нового. Творчество человека включает интуицию, эмоции, намерение.

Роль случайности и генеративных моделей

Генеративные модели (GAN, VAE) используют случайность для создания разнообразия. Но это не то же самое, что вдохновение. Человек может создать произведение, которое выражает его внутренний мир, чувства. Машина этого не делает.

Человеческое vs машинное творчество

Многие художники используют ИИ как инструмент, но не как замену. Настоящее творчество требует осознания контекста, культурных кодов и личного опыта. ИИ пока не способен на это.

Моральное чувство и эмпатия

Может ли ИИ понимать эмоции и действовать морально? Эмпатия — это способность чувствовать то же, что и другой человек. Машина может распознавать эмоции по лицу или голосу, но не испытывать их. Моральные решения требуют ценностного выбора.

Этические дилеммы (вагонетка) и ИИ

Знаменитая проблема вагонетки: должен ли беспилотный автомобиль пожертвовать одним человеком, чтобы спасти пятерых? Люди принимают такие решения интуитивно, на основе моральных норм. ИИ может быть запрограммирован на утилитарный подход, но это не делает его моральным агентом.

Модели эмоционального ИИ

Создаются системы, которые имитируют эмпатию: например, чат-боты для психологической поддержки. Но это лишь симуляция. Настоящая эмпатия требует субъективного опыта, которого у машин нет.

Как преодолевать ограничения?

Несмотря на все ограничения, исследователи и инженеры активно работают над их преодолением. Это и технические инновации, и этические меры.

Совет: Преодоление ограничений ИИ — это не только технологии, но и этика, регулирование и образование. Каждый из нас может внести вклад, требуя прозрачности и ответственности от разработчиков.

Технические подходы

Разрабатываются новые архитектуры нейросетей (например, трансформеры), нейроморфные чипы, которые имитируют работу мозга, и квантовые вычисления. Эти технологии могут снизить энергопотребление и повысить производительность.

Энергоэффективные модели

Создаются модели, которые требуют меньше ресурсов: дистилляция знаний (обучение маленькой модели на выходе большой), квантизация (снижение точности вычислений). Это позволяет запускать ИИ на мобильных устройствах.

Federated learning и privacy-preserving AI

Федеративное обучение (federated learning) позволяет обучать модель на данных, не покидающих устройство пользователя. Это решает проблему конфиденциальности. Дифференциальная приватность добавляет шум, чтобы защитить индивидуальные данные.

Этические и регуляторные меры

Компании создают этические комитеты, проводят аудит алгоритмов на предвзятость. Разрабатываются стандарты и сертификация. Важно также образование пользователей, чтобы они понимали, как работают алгоритмы и какие риски существуют.

AI ethics boards в компаниях

Крупные компании, такие как Google, Microsoft, IBM, создали внутренние этические советы. Они оценивают проекты на соответствие этическим принципам. Однако эффективность таких советов часто критикуют из-за конфликта интересов.

Инструменты для проверки bias

Разработаны инструменты, такие как IBM AI Fairness 360, Google What-If Tool, которые помогают выявить предвзятость в моделях. Они позволяют разработчикам протестировать модель на разных группах данных и скорректировать ее.

Заключение: будущее в рамках возможного

ИИ — не всемогущ. Его технические и этические границы реальны и значимы. Но они не статичны: технологии развиваются, этические нормы уточняются. Будущее ИИ зависит от нашего выбора: будем ли мы использовать его ответственно и с пониманием ограничений.

Важно: Понимание границ ИИ — первый шаг к тому, чтобы использовать его мудро и безопасно.

Ключевые выводы

- Технические ограничения: вычислительная сложность, качество данных, неспособность к обобщению, проблема черного ящика, уязвимость к атакам.

- Этические ограничения: предвзятость, отсутствие прозрачности, угрозы приватности, социальное неравенство, необходимость регулирования.

- Некоторые задачи (сознание, творчество, эмпатия) остаются за гранью возможностей ИИ.

- Преодоление ограничений требует как технических инноваций, так и этических и регуляторных мер.

Призыв к действию: учитесь, обсуждайте, участвуйте в регулировании. Будущее ИИ — в наших руках.

Часто задаваемые вопросы

Может ли ИИ превзойти человека во всех областях?

Нет. Современный ИИ — это узкий ИИ, который превосходит человека только в конкретных задачах (распознавание образов, игра в шахматы). В задачах, требующих здравого смысла, творчества, эмпатии, человек остается непревзойденным. Создание сильного ИИ (AGI), равного человеку, пока остается гипотетической целью.

Что такое «проблема черного ящика» в ИИ?

Это ситуация, когда мы не можем понять, как модель приняла решение. Особенно это характерно для глубоких нейросетей. Проблема важна в медицине, финансах, юриспруденции, где нужно объяснять решения. Объяснимый ИИ (XAI) пытается решить эту проблему, но пока с ограниченным успехом.

Как предвзятость данных влияет на ИИ?

Если данные для обучения содержат предрассудки (например, исторически сложившуюся дискриминацию), ИИ их усвоит и может усиливать неравенство. Примеры: системы найма, которые отдают предпочтение мужчинам, или системы распознавания лиц, хуже работающие на темнокожих. Борьба с предвзятостью требует тщательного подбора данных и специальных методов обучения.

Кто несет ответственность за ошибки ИИ?

Вопрос сложный. Обычно ответственность лежит на разработчике или владельце системы, но юридическая практика только формируется. В случае беспилотных автомобилей, ответственность может быть распределена между производителем, программистом и владельцем. Важно, чтобы системы были прозрачными и подотчетными.

Может ли ИИ быть творческим?

ИИ может генерировать контент (тексты, музыку, изображения), комбинируя существующие элементы. Но настоящее творчество требует осознания, намерения и эмоционального опыта, чего у машин нет. Поэтому ИИ — это инструмент для творчества, а не творец.

Какие существуют регуляции для ИИ?

Наиболее известный — EU AI Act в Европе, который классифицирует системы ИИ по степени риска и устанавливает требования. Также есть национальные законы (например, в Китае) и международные принципы (ЮНЕСКО, ОЭСР). Регулирование активно развивается, но пока не унифицировано.

Что такое AGI и чем он отличается от современного ИИ?

AGI (Artificial General Intelligence) — это гипотетический ИИ, который обладает интеллектом, сравнимым с человеческим, и может решать любые задачи. Современный ИИ — узкий (narrow AI), он обучен для конкретных задач. AGI пока не создан, и неизвестно, будет ли создан в обозримом будущем.