2026 год стал переломным для генеративного ИИ. Мы увидели не просто очередные версии моделей — произошёл сдвиг парадигмы: мультимодальность стала стандартом, контекстные окна выросли до миллионов токенов, а стоимость API снизилась на порядок. Если вы разработчик, продакт-менеджер или технический специалист, эта статья поможет разобраться в ключевых обновлениях OpenAI, Google, Anthropic и Meta, сравнить их и понять, какую платформу выбрать под свои задачи. Мы разберём практические кейсы, тренды и дадим конкретные рекомендации.

Введение: Почему 2026 год стал переломным для ИИ-моделей

Ещё в начале 2023 года большинство моделей работали только с текстом и имели контекстное окно в 4–8 тысяч токенов. К концу 2026 года ситуация кардинально изменилась. Мультимодальные модели (GPT-4o, Gemini 1.5, Claude 3) умеют анализировать изображения, аудио и видео. Контекстные окна достигли 1–2 миллионов токенов, что позволяет обрабатывать целые книги или часовые записи совещаний. Стоимость инференса снизилась в 5–10 раз по сравнению с началом года, а open-source модели (Llama 3) почти догнали проприетарные по качеству.

«2026 год — это год, когда ИИ перестал быть игрушкой и стал рабочим инструментом. Модели научились рассуждать, видеть и слышать. Теперь вопрос не в том, может ли ИИ это сделать, а в том, как дешевле и быстрее это внедрить.» — из дискуссии на конференции AI Summit 2026.

Важно: акцент на практической применимости, а не только на hype. Мы рассмотрим, какие обновления действительно влияют на разработку продуктов и бизнес-процессы.

Ключевые тренды 2026 года

- Рост мультимодальных возможностей — модели научились обрабатывать текст, изображения, аудио и видео одновременно. Это открыло новые сценарии: анализ скриншотов, распознавание эмоций по голосу, поиск по видео.

- Развитие агентных архитектур — ИИ-агенты, которые могут планировать, использовать инструменты и выполнять многошаговые задачи. Примеры: OpenAI Operator, Claude Computer Use, Gemini Agent.

- Снижение стоимости API и инференса — благодаря оптимизации архитектур (Mixture of Experts, квантование) и конкуренции, цены на токены упали в разы. Это сделало ИИ доступным для стартапов и среднего бизнеса.

- Улучшение рассуждений (reasoning) — модели нового поколения (o1, Gemini 1.5 Pro) демонстрируют способность к сложным логическим выводам, решению математических задач и написанию кода с самопроверкой.

Обновления платформы OpenAI: GPT-4o, o1 и новые инструменты

OpenAI в 2026 году выпустила две ключевые модели: GPT-4o (мультимодальная и быстрая) и o1 (с акцентом на рассуждения). Также появились новые функции: Canvas для совместной работы, улучшенный Voice Mode и API для агентов.

GPT-4o: мультимодальность и скорость

GPT-4o (omni) — это первая модель OpenAI, которая изначально обучалась на тексте, изображениях и аудио. Она работает в 2–3 раза быстрее GPT-4 Turbo и стоит вдвое дешевле. Главные нововведения:

- Генерация изображений на лету — теперь вы можете попросить модель нарисовать график, схему или иллюстрацию прямо в чате, и она это сделает без сторонних инструментов.

- Обработка аудио в реальном времени — Voice Mode позволяет общаться с ИИ голосом, причём модель распознаёт интонации, паузы и эмоции. Задержка минимальна.

- Улучшенное понимание контекста — контекстное окно увеличено до 128K токенов, что позволяет анализировать большие документы или переписки целиком.

Совет: Если вам нужен универсальный ассистент для работы с текстом, изображениями и голосом — GPT-4o лучший выбор. Он доступен бесплатно (с ограничениями) в веб-версии и приложении.

Модель o1: рассуждения нового уровня

Модель o1 (ранее известная как Strawberry) ориентирована на сложные задачи, требующие глубоких рассуждений. Она использует технику Chain-of-Thought (цепочка мыслей), то есть перед ответом «думает» несколько секунд, перебирая варианты. Это дало прорыв в математике (уровень топ-500 олимпиадных задач) и программировании (Codeforces rating выше 1800).

- Цепочка мыслей (Chain-of-Thought) — модель генерирует внутренние рассуждения, которые затем использует для финального ответа. Это снижает количество ошибок в логике и расчётах.

- Применение в науке и кодинге — o1 отлично справляется с дебаггингом, рефакторингом, написанием сложных алгоритмов и анализом научных статей.

- Ограничения и стоимость — o1 медленнее и дороже GPT-4o, поэтому её не стоит использовать для простых запросов. Она нужна для задач, где качество важнее скорости.

| Модель | Скорость | Качество рассуждений | Стоимость (вход/выход за 1M токенов) | Когда выбирать |

|---|---|---|---|---|

| GPT-4o | Высокая | Хорошее | $2.50 / $10 | Чат-боты, генерация контента, мультимодальные задачи |

| GPT-4o mini | Очень высокая | Среднее | $0.15 / $0.60 | Большие объёмы, простые запросы |

| o1 | Низкая | Отличное | $15 / $60 | Научные расчёты, сложный код, аналитика |

| o1-mini | Средняя | Хорошее | $1.10 / $4.40 | Кодинг, математика, логические задачи |

Google Gemini: интеграция и мультимодальность от Alphabet

Google в 2026 году сделала ставку на интеграцию с экосистемой и рекордное контекстное окно. Модели Gemini 1.5 Pro и 1.5 Flash доступны через API и встроены в продукты Google (Gmail, Docs, YouTube).

Gemini 1.5 Pro: рекордное контекстное окно

Gemini 1.5 Pro может обрабатывать до 1 миллиона токенов (примерно 700 000 слов или 1 час видео). Это позволяет загружать в контекст целые книги, кодовые базы или записи встреч.

- Анализ 1000-страничных отчетов — вы можете загрузить PDF с годовым отчётом и задать вопросы по любому разделу. Модель найдёт ответ, даже если он упоминается в середине документа.

- Поиск по видео — загрузите видеозапись лекции или совещания, и Gemini найдёт момент, где обсуждается конкретная тема. Работает без транскрибации.

- Интеграция с Google Workspace — Gemini встроен в Gmail, Docs, Sheets и Meet. Он может написать письмо, составить таблицу или подвести итоги встречи.

Внимание: контекст 1M токенов позволяет обрабатывать целые книги или часовые видео. Но чем длиннее контекст, тем выше задержка и стоимость. Для коротких запросов используйте Gemini 1.5 Flash — он быстрее и дешевле.

Gemini Nano: ИИ на устройстве

Gemini Nano — это лёгкая модель, которая работает прямо на смартфоне (Pixel 8/9, Samsung Galaxy S24). Она не требует интернета и обрабатывает данные локально, что обеспечивает конфиденциальность.

- Работа без интернета — модель может подсказывать слова в Gboard, отвечать на вопросы о документах на устройстве, делать переводы.

- Применение в клавиатуре Gboard — функция Magic Compose использует Nano для генерации ответов в мессенджерах, даже в офлайне.

- Ограничения производительности — Nano не подходит для сложных задач (генерация изображений, длинные тексты). Она заточена на простые, быстрые сценарии.

| Модель | Контекстное окно | Мультимодальность | Стоимость (за 1M токенов, вход/выход) | Особенность |

|---|---|---|---|---|

| Gemini 1.5 Pro | 1 млн токенов | Текст, изображения, аудио, видео | $3.50 / $10.50 | Рекордный контекст, интеграция с Google |

| Gemini 1.5 Flash | 256K токенов | Текст, изображения, аудио, видео | $0.15 / $0.60 | Быстрый и дешёвый для повседневных задач |

| Gemini Nano | 32K токенов | Только текст | Бесплатно (на устройстве) | Офлайн, конфиденциальность |

Anthropic Claude 3: безопасность и точность

Anthropic в 2026 году выпустила семейство Claude 3 (Haiku, Sonnet, Opus) и обновлённую Claude 3.5 Sonnet. Главный фокус — безопасность, минимум галлюцинаций и точность в юридических и медицинских задачах.

Сравнение моделей Claude 3

Claude 3 предлагает три уровня: Haiku — быстрый и дешёвый, Sonnet — баланс скорости и качества, Opus — максимальная точность. В середине года вышла Claude 3.5 Sonnet, которая по качеству почти догнала Opus, но работает быстрее.

- Haiku: быстрый и дешевый — идеален для чат-ботов, обработки коротких запросов, модерации контента. Стоимость минимальна.

- Sonnet: баланс — подходит для большинства бизнес-задач: анализ документов, генерация текстов, поддержка клиентов. Claude 3.5 Sonnet — лучший выбор для enterprise.

- Opus: максимальное качество — для сложных аналитических отчётов, научных исследований, юридических документов. Самый дорогой, но и самый точный.

«Мы тестировали Claude 3.5 Sonnet на задаче извлечения данных из медицинских карт. Ошибок было на 40% меньше, чем у GPT-4o. Для нас это критично.» — CTO финтех-стартапа MedData.

Улучшения в безопасности и конституционном ИИ

Anthropic использует подход Constitutional AI (конституционный ИИ): модель обучается следовать набору принципов, что снижает количество вредных или предвзятых ответов.

- Механизмы самоконтроля — модель может оценить собственный ответ на соответствие правилам и отклонить его, если он нарушает политику.

- Результаты тестов на безопасность — Claude 3 показывает одни из лучших показателей в бенчмарках на предвзятость, токсичность и вредоносность. По данным Anthropic, уровень галлюцинаций снижен на 30% по сравнению с предыдущими версиями.

- Отзывы enterprise-клиентов — компании из финансового и медицинского секторов выбирают Claude из-за прозрачности и возможности аудита решений.

Частая ошибка: считать, что все модели Claude одинаково безопасны. Opus даёт более детальные и взвешенные ответы, но требует больше времени и денег. Для простых задач безопасность Haiku может быть недостаточной — тестируйте на своих данных.

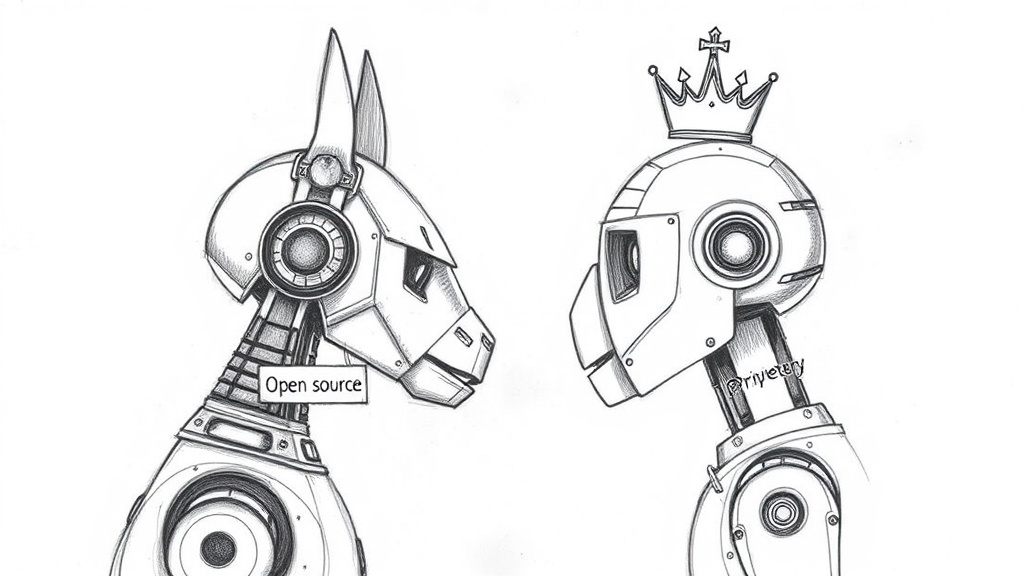

Meta Llama 3: открытые модели и сообщество

Meta в 2026 году выпустила Llama 3 (8B, 70B, 400B) и обновлённую Llama 3.1 с контекстом 128K токенов. Это open-source модели, доступные для коммерческого использования, что сделало их популярными среди разработчиков и исследователей.

Масштабы и производительность Llama 3

Llama 3 — это семейство моделей разного размера. Самая маленькая (8B) работает на ноутбуке, самая большая (400B) требует кластера GPU. По бенчмаркам Llama 3 70B догоняет GPT-3.5, а 400B конкурирует с GPT-4.

- Llama 3 8B: для edge и мобильных — можно запустить на Raspberry Pi или смартфоне. Подходит для простых чат-ботов, классификации текстов, извлечения информации.

- Llama 3 70B: серверный вариант — требует одного GPU (A100 или H100) с 80 ГБ памяти. Используется для генерации контента, анализа данных, RAG-систем.

- Llama 3 400B: корпоративный уровень — нужен кластер из 8+ GPU. По качеству сравнима с GPT-4 и Claude 3 Opus, но с возможностью полного контроля данных.

Экосистема и инструменты

Благодаря открытости Llama 3, вокруг неё сформировалось большое сообщество. Модель доступна на Hugging Face, её можно дообучать (fine-tuning) на своих данных, развёртывать в облаке или on-premise.

- Fine-tuning на кастомных данных — с помощью фреймворков (LLaMA-Factory, Unsloth) можно адаптировать модель под свою предметную область. Например, обучить на медицинских текстах или юридических документах.

- Развертывание в облаке и on-premise — Llama 3 поддерживается всеми облачными провайдерами (AWS, GCP, Azure) и инструментами (vLLM, Ollama, llama.cpp). Можно развернуть на собственном сервере для полной конфиденциальности.

- Примеры успешных проектов — стартапы используют Llama 3 для создания локальных ассистентов, обработки персональных данных (медицина, финансы), где нельзя передавать информацию в облачные API.

Совет: Если вам нужна полная конфиденциальность данных или вы хотите дообучить модель под узкую задачу — выбирайте Llama 3. Для большинства бизнес-сценариев достаточно Llama 3 70B. Она даёт отличное качество при разумных затратах на железо.

Сравнительный анализ платформ: что выбрать?

Выбор модели зависит от ваших задач, бюджета и требований к безопасности. Ниже — сводная таблица и рекомендации.

Критерии выбора модели

- Бюджет и объем запросов — если у вас миллионы запросов в день, выбирайте дешёвые модели (GPT-4o mini, Gemini 1.5 Flash, Claude Haiku) или open-source (Llama 3 8B/70B).

- Требования к конфиденциальности — для работы с персональными данными (медицина, финансы) лучше использовать on-premise развёртывание Llama 3 или Claude с подписанным DPA.

- Необходимость мультимодальности — если нужно анализировать изображения, видео или аудио, выбирайте GPT-4o, Gemini 1.5 или Claude 3 (поддерживает изображения).

- Качество рассуждений — для сложных логических задач (математика, программирование, научные расчёты) лучший выбор — o1 или Gemini 1.5 Pro.

Сводная таблица сравнения

| Параметр | GPT-4o | Gemini 1.5 Pro | Claude 3.5 Sonnet | Llama 3.1 70B |

|---|---|---|---|---|

| Мультимодальность | Текст, изображения, аудио | Текст, изображения, аудио, видео | Текст, изображения | Только текст (через интеграции) |

| Максимальный контекст | 128K токенов | 1 млн токенов | 200K токенов | 128K токенов |

| Стоимость (вход/выход за 1M токенов) | $2.50 / $10 | $3.50 / $10.50 | $3.00 / $15 | Бесплатно (open-source) |

| Open-source | Нет | Нет | Нет | Да |

| Безопасность (галлюцинации) | Средняя | Средняя | Высокая | Средняя (зависит от дообучения) |

| Лучшее применение | Универсальный ассистент | Анализ больших данных, видео | Enterprise, безопасность | Кастомные решения, конфиденциальность |

Для тех, кто хочет глубже разобраться в практическом применении ИИ-ассистентов, рекомендуем прочитать статью «Как работают ИИ-ассистенты Claude: обзор возможностей» — там подробно разобраны кейсы использования Claude в разработке.

Практические кейсы и примеры использования в 2026 году

Новые возможности моделей уже активно применяются в бизнесе. Рассмотрим два популярных сценария.

Автоматизация клиентской поддержки

Компании всё чаще заменяют традиционные чат-боты на ИИ-агентов на базе GPT-4o или Claude. Главное преимущество — понимание контекста и мультимодальность: бот может анализировать скриншоты ошибок, сканы документов и даже голосовые сообщения.

- Обработка скриншотов и документов — пользователь отправляет скриншот ошибки, и бот сразу видит текст, распознаёт кнопки и предлагает решение. Это сокращает время обработки запроса с 5 минут до 30 секунд.

- Снижение времени ответа — по опыту внедрений, среднее время первого ответа снижается с 2 часов до 1 минуты, а уровень удовлетворённости клиентов (CSAT) растёт на 15–20%.

- Примеры метрик — один из крупных e-commerce проектов после внедрения GPT-4o сократил количество эскалаций на 40% и увеличил долю решённых проблем с первого обращения до 75%.

Генерация и анализ кода

Модели o1 и Gemini отлично справляются с задачами программирования: от написания функций до ревью кода и генерации документации.

- Интеграция с IDE — многие разработчики используют GitHub Copilot (на базе GPT-4o) или CodeGemma (на базе Gemini). Они предлагают автодополнение, рефакторинг и даже пишут тесты.

- Автоматическое тестирование — o1 может сгенерировать юнит-тесты для существующего кода, включая пограничные случаи. Это экономит часы работы QA-инженеров.

- Кейсы стартапов — небольшие команды используют o1 для написания бэкенда на Python или Node.js. Например, стартап в сфере FinTech за 2 недели создал MVP с помощью o1, включая интеграцию с платёжным шлюзом.

Если вы хотите узнать, как ИИ-ассистенты упрощают написание кода, прочитайте статью «Как ИИ-ассистенты Cursor упрощают написание кода: обзор функций».

Будущее ИИ-моделей: что нас ждет в 2025 году?

2025 год обещает быть не менее насыщенным. Основные тренды — улучшение рассуждений, появление агентов, способных выполнять сложные многошаговые задачи, и дальнейшее снижение стоимости инференса.

Технологические тренды

- Мультимодальные агенты — модели, которые не только анализируют, но и действуют: заказывают билеты, управляют умным домом, пишут код и развёртывают его. Примеры уже есть (OpenAI Operator, Claude Computer Use), но в 2025 году они станут массовыми.

- Обучение с минимальным количеством данных — новые методы (few-shot learning, meta-learning) позволят дообучать модели на нескольких примерах, а не на тысячах. Это снизит порог входа для кастомизации.

- Edge AI — модели для смартфонов и IoT-устройств станут ещё мощнее. Gemini Nano — только начало. В 2025 году мы увидим модели с 7–10B параметров, работающие на устройствах с 8 ГБ ОЗУ.

Этические и регуляторные аспекты

- AI Act в Европе — с 2025 года вступает в силу первый этап регулирования ИИ в ЕС. Компании обязаны маркировать контент, созданный ИИ, и проводить аудит моделей высокого риска (медицина, финансы, правоохранительные органы).

- Ответственное использование — растёт внимание к предвзятости моделей. Anthropic и OpenAI уже внедряют механизмы самоконтроля, но в 2025 году это станет стандартом для всех платформ.

- Прозрачность алгоритмов — пользователи и регуляторы требуют объяснений, почему модель приняла то или иное решение. Техники explainable AI (XAI) будут активно развиваться.

Часто задаваемые вопросы

Какая модель лучше всего подходит для чат-бота?

Для большинства чат-ботов оптимальный выбор — GPT-4o или Claude 3.5 Sonnet. Если бюджет ограничен, используйте GPT-4o mini или Gemini 1.5 Flash. Для офлайн-сценариев — Llama 3 8B.

Можно ли использовать ИИ-модели для обработки медицинских данных?

Да, но с осторожностью. Лучше всего подходят Claude (высокая безопасность) или Llama 3 (on-premise развёртывание для соблюдения HIPAA/GDPR). Обязательно проводите дополнительное тестирование на галлюцинации.

Что такое мультимодальность и зачем она нужна?

Мультимодальность — это способность модели работать с разными типами данных (текст, изображения, аудио, видео). Это нужно, например, для анализа скриншотов, распознавания голоса, поиска по видео. Модели без мультимодальности (например, Llama 3) могут обрабатывать только текст.

Как выбрать между open-source и проприетарной моделью?

Если вам нужна полная конфиденциальность данных, возможность дообучения и отсутствие зависимости от вендора — выбирайте open-source (Llama 3). Если важны простота использования, мультимодальность и поддержка — проприетарные (GPT-4o, Gemini, Claude).

Почему модель o1 такая дорогая?

o1 использует технику Chain-of-Thought, которая требует дополнительных вычислительных ресурсов на этапе рассуждения. Это увеличивает время ответа и стоимость. Используйте o1 только для сложных задач, где качество важнее цены.

Заключение

2026 год показал, что ИИ-модели стали зрелыми инструментами для бизнеса и разработки. Мультимодальность, огромные контекстные окна и снижение стоимости открыли новые сценарии. Open-source модели почти догнали проприетарные, что даёт выбор: полный контроль или удобство. Главный вывод — не существует универсальной модели. Выбирайте под задачу: GPT-4o для универсальности, Gemini для работы с большими данными, Claude для безопасности, Llama для кастомизации. Тестируйте, экспериментируйте и внедряйте — возможности 2026 года уже доступны.

«Лучшая модель — та, которую вы используете. Не бойтесь пробовать новое и комбинировать разные платформы. ИИ — это не магия, а инструмент, который нужно настраивать под свои нужды.» — из опыта разработчиков.

Если вы хотите узнать больше о том, как концепция вайб-кодинга меняет подход к разработке, прочитайте нашу статью на эту тему.