Искусственный интеллект перестал быть абстрактной технологией — он уже принимает решения в медицине, финансах, правосудии и найме. Разработчик, создающий алгоритм, несёт ответственность не только за его точность, но и за последствия. Эта статья — практическое руководство по этическому проектированию ИИ-кода. Вы узнаете о ключевых принципах, типичных вызовах и конкретных шагах, которые помогут внедрить этику в процесс разработки.

Введение: почему этика ИИ-кода критична сегодня

С каждым годом ИИ-системы берут на себя всё больше задач, от фильтрации резюме до диагностики заболеваний. Когда алгоритм ошибается, страдают реальные люди. Достаточно вспомнить несколько громких случаев, чтобы понять: этические провалы обходятся дорого — как в деньгах, так и в репутации.

Разработчики часто сосредотачиваются на метриках качества модели, забывая о социальном воздействии. Но именно код определяет, будет ли система справедливой, прозрачной и безопасной. Игнорирование этики может привести к юридическим и репутационным потерям, а также к недоверию пользователей.

Важно: этические ошибки могут привести к юридическим и репутационным потерям. Одна предвзятая модель способна обернуться многомиллионными исками и крахом доверия.

Краткий обзор этических скандалов в ИИ

Чтобы понять масштаб проблемы, достаточно взглянуть на несколько реальных кейсов. Они показывают, как, казалось бы, технические решения могут дискриминировать целые группы людей.

Дело COMPAS и расовая предвзятость

Система COMPAS, использовавшаяся в американских судах для оценки риска рецидива, оказалась предвзятой по отношению к афроамериканцам. Алгоритм чаще присваивал им высокий уровень риска, хотя реальная статистика не подтверждала это. Последствия: тысячи несправедливых приговоров.

Алгоритм найма Amazon против женщин

Amazon разработал ИИ для отбора резюме, но модель научилась дискриминировать женщин, потому что обучалась на исторических данных, где большинство успешных кандидатов были мужчинами. Компания в итоге отказалась от системы, но репутационный ущерб остался.

«Каждый этический провал ИИ — это не сбой технологии, а сбой проектирования. Ответственность лежит на разработчиках, которые не учли контекст и последствия».

Ключевые принципы этичного ИИ-кода

Этичные принципы — не абстрактные лозунги, а конкретные требования к коду, данным и процессам. Ниже — шесть базовых принципов, которые должен знать каждый разработчик ИИ. Для каждого я даю практическую интерпретацию.

| Принцип | Что значит для разработчика | Пример реализации |

|---|---|---|

| Справедливость | Модель не должна дискриминировать группы по полу, расе, возрасту и т.д. | Аудит данных на предвзятость, ресэмплинг, корректировка весов |

| Прозрачность | Пользователь и стейкхолдеры понимают, как принимаются решения | Использование LIME/SHAP, документирование логики модели |

| Подотчётность | Есть чёткая цепочка ответственности за решения ИИ | Логирование, аудит, назначение ответственного лица |

| Конфиденциальность | Персональные данные защищены, соблюдаются законы (GDPR, CCPA) | Анонимизация, дифференциальная приватность, федеративное обучение |

| Безопасность | Модель устойчива к атакам и сбоям | Тестирование на adversarial examples, мониторинг в продакшене |

| Человеческий контроль | Критические решения проверяются человеком | Механизмы override, интерфейсы для экспертов |

Важно: принципы должны быть не абстрактными, а операционализируемыми в коде. Каждый пункт из таблицы можно превратить в тест или проверку в CI/CD.

Справедливость и борьба с предвзятостью

Справедливость алгоритмов — один из самых острых вопросов. Bias может быть в данных, в разметке, в самой модели. Задача разработчика — выявить и устранить предвзятость на всех этапах.

Аудит данных на предвзятость

Первый шаг — проверить, насколько репрезентативна выборка. Если в данных доминирует одна группа, модель будет работать хуже для других. Используйте стратифицированную выборку и метрики вроде демографического паритета.

Техники дебиасинга

Существует несколько подходов: ресэмплинг (добавление примеров из меньшинства), корректировка весов классов, использование алгоритмов, устойчивых к bias. Выбор зависит от задачи.

Метрики справедливости

Не существует единой метрики. Используйте комбинацию: равные возможности, равные шансы, демографический паритет. Выбор метрики — этическое решение само по себе.

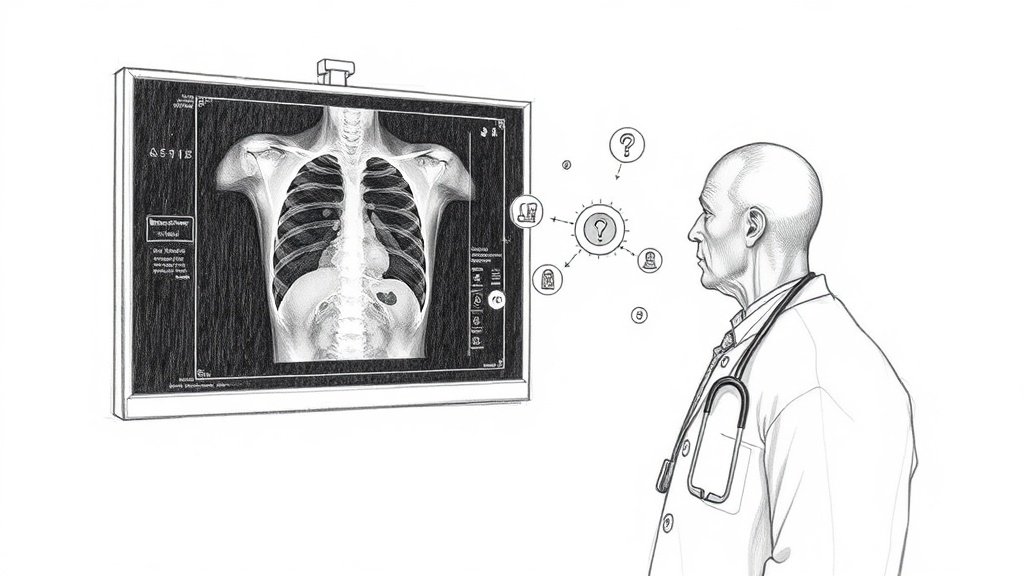

Прозрачность и объяснимость

Пользователь имеет право знать, почему ИИ принял то или иное решение. Особенно это важно в медицине, финансах и правосудии. Прозрачность ИИ повышает доверие и позволяет находить ошибки.

Методы объяснения моделей

Инструменты вроде LIME и SHAP показывают, какие признаки повлияли на предсказание. Для линейных моделей можно использовать веса, для деревьев — важность признаков. Главное — документировать эти объяснения.

Документация для стейкхолдеров

Не все заинтересованные стороны — технические специалисты. Готовьте краткие отчёты на понятном языке: какие данные использовались, как модель принимает решения, какие риски существуют.

Прозрачность данных обучения

Описывайте происхождение данных, методы очистки, возможные смещения. Это поможет другим разработчикам и аудиторам оценить качество и этичность модели.

Подотчётность и ответственность

Кто отвечает, если ИИ ошибся? Разработчик? Компания? Алгоритм? Чёткая подотчётность — основа доверия. Без неё любой этический принцип остаётся декларацией.

Логирование решений

Каждое важное предсказание должно быть залогировано: входные данные, версия модели, время, ответственный разработчик. Это позволит расследовать инциденты и улучшать систему.

Этический аудит кода

Регулярно проводите аудит кода на соответствие этическим принципам. Включите в ревью проверку на bias, проверку документации, оценку рисков для уязвимых групп.

Назначение ответственного лица

В команде должен быть человек, отвечающий за этику ИИ. Он координирует аудит, обучает коллег и принимает решения в спорных ситуациях. Это не обязательно отдельная роль — может быть частью задач лида.

Конфиденциальность и защита данных

ИИ-системы работают с персональными данными. Нарушение конфиденциальности ведёт к штрафам и потере доверия. Соблюдение GDPR и CCPA — минимум, но есть и более продвинутые методы.

Анонимизация персональных данных

Удаляйте или обобщайте идентифицирующую информацию. Но помните: анонимизация не всегда обратима, и существуют методы реидентификации. Используйте k-анонимность или l-разнообразие.

Дифференциальная приватность

Метод, который добавляет шум в данные или результаты запросов, чтобы защитить отдельные записи. Библиотеки вроде TensorFlow Privacy позволяют внедрить его в обучение моделей.

Федеративное обучение

Модель обучается на устройствах пользователей, не передавая данные на сервер. Это снижает риски утечки, но требует дополнительной координации и устойчивости к атакам.

Безопасность и надёжность

ИИ-системы уязвимы для атак: злоумышленник может подать специально искажённые данные, чтобы обмануть модель. Безопасность ИИ — это защита от adversarial examples и обеспечение устойчивости к сбоям.

Тестирование на устойчивость

Добавьте в пайплайн тесты с граничными случаями и состязательными примерами. Используйте библиотеки вроде CleverHans или Foolbox для генерации атак.

Защита от состязательных атак

Методы: adversarial training (обучение на атакованных примерах), градиентная маскировка, использование ансамблей моделей. Ни один метод не даёт 100% защиты, но снижает риски.

Мониторинг в продакшене

Отслеживайте дрейф данных, аномалии в предсказаниях, частоту ошибок. Настройте алерты для команды. Быстрое реагирование на инциденты — часть безопасности.

Основные вызовы при внедрении этических принципов

Внедрение этики на практике сталкивается с рядом сложностей. Компромиссы неизбежны, но их нужно осознавать и документировать. Ниже — три типичных вызова.

| Вызов | Описание | Возможное решение |

|---|---|---|

| Конфликт точности и справедливости | Улучшение точности для большинства может ухудшить результаты для меньшинств | Взвешивание классов, многоцелевая оптимизация |

| Недостаток репрезентативных данных | Редкие группы плохо представлены в выборке | Синтетические данные, сбор данных от сообществ |

| Отсутствие чётких регуляторных норм | Законы фрагментированы, ответственность размыта | Следовать стандартам (ISO, IEEE), создавать внутренние политики |

Важно: компромиссы неизбежны, но их нужно осознавать и документировать. Прозрачное описание trade-off — часть ответственного ИИ.

Конфликт между точностью и справедливостью

Часто повышение общей точности модели достигается за счёт ухудшения качества для меньшинств. Например, модель кредитного скоринга может стать точнее для большинства, но ещё чаще отклонять заявки от малообеспеченных групп. Как балансировать?

Пример компромисса

Представьте модель диагностики редкого заболевания. Если обучать её только на массовых данных, точность для редкого случая будет низкой. Добавление синтетических данных может снизить общую точность, но повысит справедливость.

Метрики для оценки баланса

Используйте метрики, которые учитывают обе цели: например, взвешенную точность или F1-score для каждого класса. Визуализируйте trade-off с помощью кривых.

Решения: взвешивание классов

Присвойте больший вес ошибкам на меньшинстве в функции потерь. Это сместит модель в сторону справедливости, но может снизить общую точность. Документируйте это решение.

Недостаток репрезентативных данных

Когда данных о редких группах мало, модель может усиливать неравенство. Например, система распознавания лиц хуже работает на людях с тёмной кожей, потому что в обучающей выборке их меньше.

Сбор данных от сообществ

Привлекайте представителей редких групп к сбору и разметке данных. Это не только улучшит качество, но и повысит доверие. Учитывайте инклюзивность данных на этапе проектирования.

Использование синтетических данных

Генерация искусственных примеров с помощью GAN или вариационных автоэнкодеров может восполнить пробелы. Но будьте осторожны: синтетические данные могут не отражать реальные паттерны.

Оценка охвата

Регулярно проверяйте, какие группы недостаточно представлены. Используйте метрики охвата и доли ошибок по подгруппам. Это должно быть частью CI/CD.

Отсутствие четких регуляторных норм

Законы об ИИ различаются в разных странах и часто отстают от технологий. Это создаёт неопределённость: разработчики не знают, какие требования будут предъявлены завтра.

Обзор текущих регуляций

EU AI Act вводит классификацию рисков и обязательные требования для высокорисковых систем. В США и Китае тоже появляются свои нормы. Следите за обновлениями и адаптируйте процессы.

Рекомендации по самоконтролю

Пока нет единого стандарта, следуйте лучшим практикам: ISO/IEC 42001 (менеджмент ИИ), IEEE Ethically Aligned Design. Создайте внутренний этический кодекс и чеклисты.

Этические комитеты

Создайте в компании комитет, который будет оценивать новые проекты на этические риски. Включите в него не только разработчиков, но и юристов, социологов, представителей пользователей.

Практические шаги для внедрения этики в процесс разработки

Этика должна быть встроена в каждый этап: от сбора требований до мониторинга. Ниже — пошаговое руководство с чеклистами и инструментами.

Важно: этика должна быть встроена в CI/CD pipeline — автоматические проверки на bias, документацию и логирование становятся частью пайплайна.

Этический чеклист на этапе планирования

Перед началом разработки ответьте на вопросы: какие данные используются, кто затронут, какие риски? Пример чеклиста:

- Определены ли все стейкхолдеры, на которых повлияет система?

- Есть ли потенциальный вред для уязвимых групп?

- Какие меры митигации предусмотрены?

- Соблюдаются ли требования конфиденциальности?

- Как будет обеспечиваться человеческий контроль?

Определение стейкхолдеров

Составьте карту всех, кто будет взаимодействовать с системой: пользователи, операторы, те, на кого влияют решения. Учтите, что некоторые группы могут быть неочевидны.

Оценка потенциального вреда

Для каждого стейкхолдера оцените возможные негативные последствия: дискриминация, потеря конфиденциальности, финансовый ущерб. Присвойте уровень риска.

План митигации

Для каждого риска опишите меры: технические (аудит, тесты), организационные (обучение, комитет), юридические (соблюдение норм). Назначьте ответственных.

Интеграция этических проверок в CI/CD

Автоматизация — ключ к масштабированию этики. Включите в пайплайн тесты на fairness, проверку документации, логирование решений. Это снижает нагрузку на команду и делает процесс воспроизводимым.

Настройка пайплайна

Добавьте шаги: проверка данных на bias (например, с помощью AI Fairness 360), тестирование модели на метрики справедливости, генерация отчёта по объяснимости. Если метрики не проходят — блокируйте деплой.

Инструменты для автоматизации

Используйте AI Fairness 360, What-If Tool, TensorFlow Privacy. Они интегрируются с популярными фреймворками и позволяют настроить гейты.

Метрики для гейтов

Определите пороговые значения: например, разница в точности между группами не более 5%, демографический паритет не ниже 0.8. Пороги должны быть согласованы с командой и стейкхолдерами.

Обучение команды и культура ответственности

Даже лучшие инструменты не помогут, если команда не понимает важности этики. Создайте культуру, где каждый чувствует ответственность за последствия кода.

Тренинги по этике

Проводите регулярные воркшопы: разбор кейсов, практика с инструментами, обсуждение дилемм. Приглашайте внешних экспертов. Тренинги должны быть обязательными для всех разработчиков ИИ.

Этический кодекс

Разработайте внутренний кодекс, в котором закреплены принципы и процедуры. Он должен быть доступен, понятен и поддерживаться руководством. Регулярно пересматривайте его.

Каналы для сообщения об ошибках

Создайте анонимный канал, где сотрудники могут сообщать о потенциальных этических проблемах. Поощряйте такие сообщения и не наказывайте за них. Это повышает прозрачность и доверие.

Инструменты и фреймворки для этичного ИИ

Существует множество библиотек и платформ, которые помогают внедрить этику. Выбор зависит от конкретной задачи: bias, объяснимость, приватность. Ниже — обзор популярных решений.

Важно: выбирайте инструмент под конкретные задачи (bias, объяснимость, приватность). Не пытайтесь внедрить всё сразу — начните с одного направления.

Библиотеки для обнаружения и смягчения bias

Эти библиотеки помогают выявить предвзятость в данных и моделях, а также предлагают методы её устранения.

AI Fairness 360

Библиотека от IBM содержит более 70 метрик справедливости и 10 алгоритмов дебиасинга. Поддерживает популярные фреймворки (scikit-learn, TensorFlow, PyTorch). Хорошо документирована.

Fairlearn

Библиотека от Microsoft, фокусируется на метриках и визуализации. Позволяет сравнивать модели по разным группам. Интегрируется с scikit-learn.

Aequitas

Инструмент для аудита bias, ориентированный на неспециалистов. Генерирует отчёты с рекомендациями. Полезен для коммуникации с бизнесом.

Инструменты для объяснимости и интерпретации

Объяснимый ИИ (XAI) — ключевой элемент прозрачности. Эти инструменты показывают, какие признаки повлияли на предсказание.

LIME

Локальные интерпретации для любого классификатора. Генерирует простые модели, аппроксимирующие поведение исходной модели в окрестности предсказания.

SHAP

Основан на теории игр, даёт консистентные объяснения. Показывает вклад каждого признака в предсказание. Поддерживает визуализацию summary plots.

InterpretML

Библиотека от Microsoft, объединяющая несколько методов объяснимости. Включает как глобальные, так и локальные интерпретации. Удобна для экспериментов.

Платформы для мониторинга этики в продакшене

После деплоя важно продолжать отслеживать этические метрики. Платформы предоставляют дашборды и алерты.

IBM Watson OpenScale

Платформа для мониторинга fairness, объяснимости и дрейфа. Интегрируется с различными средами. Позволяет настроить автоматические отчёты.

Google Cloud AI Explanations

Сервис для получения объяснений предсказаний моделей, развёрнутых на Google Cloud. Поддерживает атрибуцию признаков.

Azure ML Interpretability

Инструмент от Microsoft для интерпретации моделей в Azure Machine Learning. Включает визуализации и интеграцию с пайплайнами.

Будущее этики ИИ: тренды и прогнозы

Этика ИИ быстро развивается. Уже сейчас можно выделить несколько трендов, которые определят ближайшие годы. Разработчикам стоит готовиться заранее.

Важно: этика станет конкурентным преимуществом. Компании, которые внедрят ответственный ИИ раньше других, получат доверие пользователей и регуляторов.

Регуляторные изменения

EU AI Act — первый всеобъемлющий закон об ИИ. Он классифицирует системы по уровню риска и вводит обязательные требования. Аналогичные законы разрабатываются в США, Китае, Канаде.

EU AI Act: основные положения

Закон делит ИИ на четыре категории риска: неприемлемый (запрещён), высокий (строгие требования), ограниченный (прозрачность), минимальный (без ограничений). Высокорисковые системы должны проходить оценку соответствия.

Адаптация к новым требованиям

Начните внедрять практики, соответствующие высокорисковым системам, даже если ваш продукт пока не подпадает под регулирование. Это снизит будущие затраты на адаптацию.

Этика как часть культуры разработки

Этика перестаёт быть опциональной добавкой — она становится неотъемлемой частью процесса. Это касается не только крупных корпораций, но и стартапов.

Этическая сертификация

Появляются программы сертификации для ИИ-продуктов (например, IEEE Ethically Aligned Design). Сертификация станет требованием для работы в некоторых отраслях.

Внутренние этические комитеты

Всё больше компаний создают постоянные комитеты, которые оценивают проекты на всех этапах. Это помогает избежать ошибок и повышает доверие стейкхолдеров.

«Этичный ИИ — это не ограничение, а возможность. Он повышает качество продукта, снижает риски и создаёт долгосрочную ценность».

Заключение: этика — не опция, а необходимость

Этичный ИИ — это не про замедление разработки, а про её качество. Внедрение принципов справедливости, прозрачности, подотчётности, конфиденциальности и безопасности снижает риски, повышает доверие пользователей и улучшает продукт. Начните с малого: добавьте этический чеклист в планирование, настройте автоматические проверки в CI/CD, проведите первый тренинг для команды. Каждый шаг приближает вас к ответственному ИИ.

Помните: код, который вы пишете сегодня, влияет на жизни людей завтра. Делайте его этичным.

Часто задаваемые вопросы

Что такое этика ИИ-кода?

Этика ИИ-кода — это набор принципов и практик, которые обеспечивают справедливость, прозрачность, подотчётность, конфиденциальность и безопасность алгоритмов. Она касается всех этапов разработки: от сбора данных до мониторинга в продакшене.

С чего начать внедрение этики в команде?

Начните с обучения: проведите воркшоп по базовым принципам и инструментам. Затем добавьте этический чеклист в процесс планирования и настройте автоматические проверки на bias в CI/CD.

Какие инструменты лучше всего подходят для обнаружения bias?

AI Fairness 360 (IBM) — самый полный набор метрик и алгоритмов. Fairlearn (Microsoft) хорош для визуализации. Aequitas подходит для быстрых аудитов и отчётов для бизнеса.

Как соблюдать GDPR при разработке ИИ?

Используйте анонимизацию, дифференциальную приватность и федеративное обучение. Документируйте обработку данных, получайте согласие пользователей, проводите оценку воздействия на защиту данных (DPIA).

Что делать, если точность модели конфликтует со справедливостью?

Задокументируйте компромисс, согласуйте с командой и стейкхолдерами. Используйте взвешивание классов или многоцелевую оптимизацию. Прозрачность такого решения — часть ответственного ИИ.

Для углубления в тему рекомендую прочитать статьи: Вайб-кодинг: что это и как он меняет разработку и Как ИИ-ассистенты Cursor упрощают написание кода: обзор функций. Они помогут понять, как современные инструменты ИИ влияют на процесс разработки и какие этические вопросы возникают при их использовании.